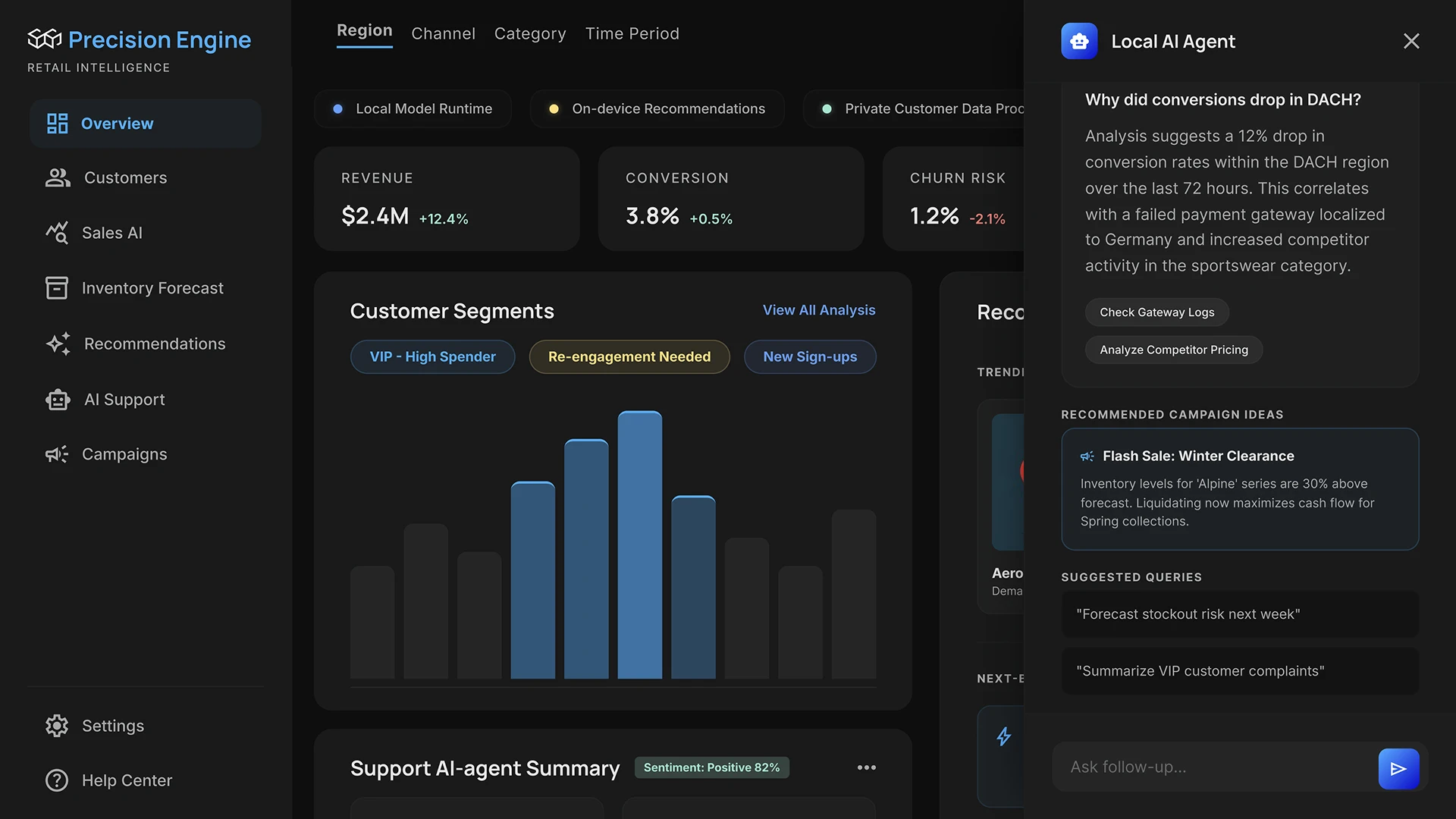

Компании всё активнее внедряют AI в рабочие процессы: обработка документов, анализ данных, внутренние ассистенты, автоматизация поддержки. Но при работе с данными реальных людей и другой чувствительной информацией, возникает вопрос, который не принято задавать вслух: куда именно она уходит?

Когда сотрудник задаёт вопрос GPT-4 о клиентском договоре или отправляет в облако фрагменты внутренней отчётности, данные покидают периметр компании. Облачные модели хранят запросы, используют их для улучшения систем, подчиняются юрисдикции страны размещения серверов. Для бизнеса, работающего с персональными данными, финансовой информацией или коммерческой тайной, это не абстрактный риск – это прямое нарушение политик безопасности или регуляторных требований.

Одновременно с этим облачный AI может стать дорогим при регулярном использовании. Сотни тысяч токенов в месяц на команду – это уже ощутимые расходы без чёткого контроля над тем, что именно тарифицируется.

Отсюда и вырастает запрос, который мы видим всё чаще: нужен локальный AI.

Почему компании переходят на локальный AI

Переход к локальным решениям – это бизнес-решение, которое опирается на несколько конкретных причин.

- Конфиденциальность данных. Внутренние документы, переговоры, клиентская база – всё это должно оставаться внутри. Локальная модель не отправляет запросы на внешние серверы: она работает с данными там же, где они хранятся.

- Работа с корпоративным контекстом. Облачная модель не знает ничего о вашей компании: ни о продуктах, ни о процессах, ни о внутренней документации. Локальная система же строится поверх ваших данных и отвечает именно на ваши вопросы.

- Снижение операционных затрат. Фиксированная стоимость оборудования против нарастающих облачных расходов.

- Контроль над системой. Вы определяете, какая модель используется, как она настроена, какие данные к ней подключены, кто имеет доступ. Никаких изменений условий использования, никаких внезапных обновлений поведения модели.

Практически это выглядит так: компания подключает к локальной AI-системе CRM, базу знаний и внутренние регламенты. Менеджер задаёт вопрос и получает ответ, сформированный на основе реальных корпоративных данных, без единого запроса во внешнюю сеть.

Что такое локальная AI-инфраструктура

Важно понять с самого начала: локальный AI – это не одна программа и не одна модель. Это система из нескольких взаимосвязанных компонентов.

Языковая модель (LLM) – ядро системы. Принимает текстовый запрос, понимает контекст, формирует ответ. Локально можно запустить модели разного масштаба: от компактных (7–13 млрд параметров) до более тяжёлых (70 млрд и выше). Выбор модели зависит от задачи и доступного “железа”.

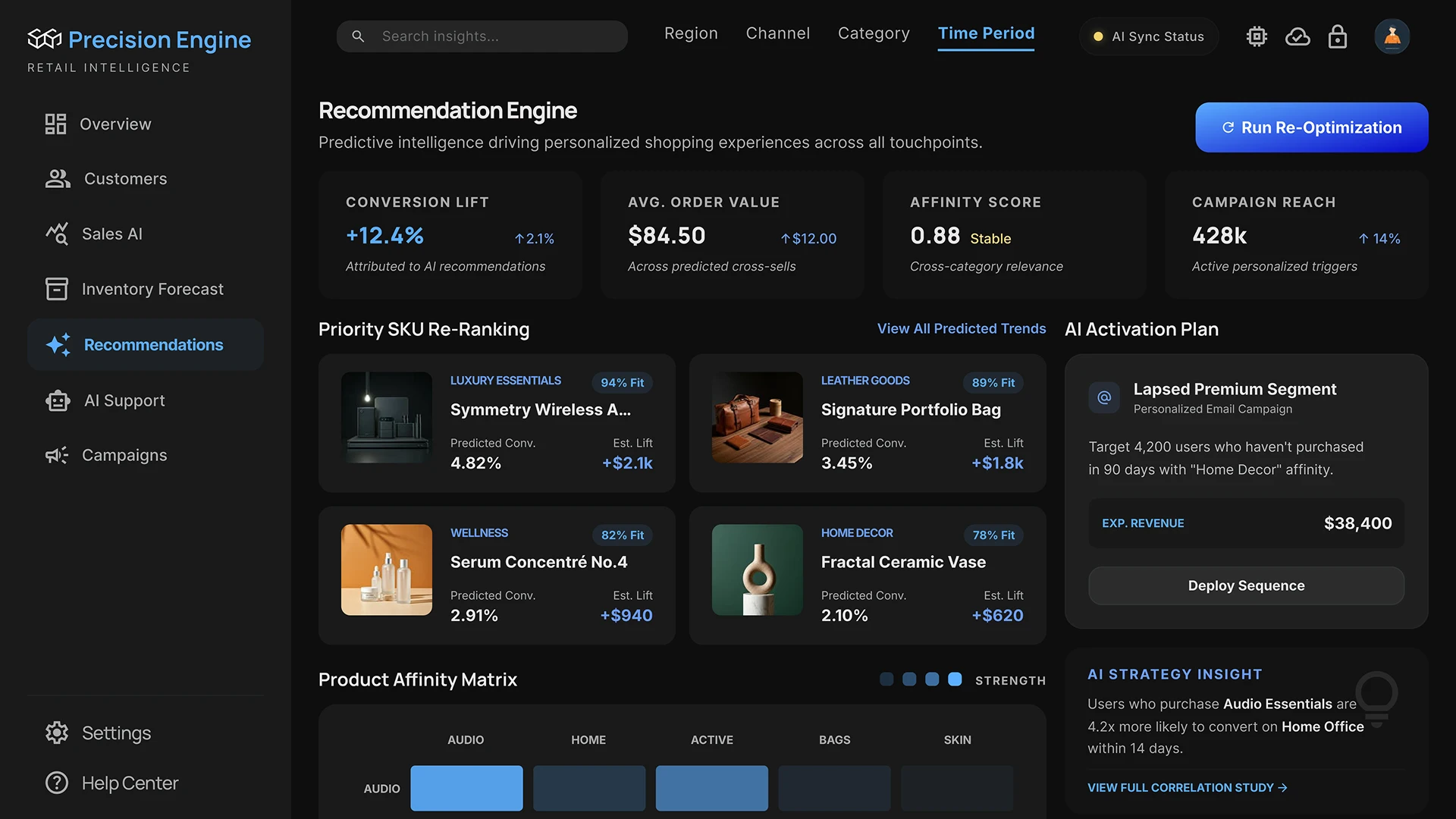

Векторная база данных – хранилище знаний. Документы, регламенты, переписка, данные CRM – всё это преобразуется в числовые представления (векторы) и индексируется. Когда пользователь задаёт вопрос, система ищет релевантные фрагменты и передаёт их в модель вместе с запросом.

RAG (Retrieval-Augmented Generation) – механизм работы с контекстом. Вместо того чтобы модель "выдумывала" ответ из общих знаний, RAG подтягивает конкретные данные из базы и формирует ответ на их основе. Это и есть то, что делает корпоративный AI по-настоящему полезным.

AI-агенты – активные компоненты системы. В отличие от простого чат-бота, агент умеет выполнять действия: искать информацию, вызывать инструменты, обращаться к внешним API, выполнять многошаговые задачи. Агент – это AI, который не просто отвечает, но и делает.

Все четыре компонента в связке – и есть локальный AI.

Почему именно Mac Mini подходит для локальной AI-системы

Обычно, когда говорят о запуске AI локально, представляют дорогие серверы с мощными видеокартами NVIDIA. Такие решения действительно работают, но стоят дорого, требуют охлаждения, шумят и нуждаются в обслуживании.

Mac Mini на Apple Silicon – это более простой и доступный вариант.

Чипы серии M (M1, M2, M3, M4) устроены иначе: процессор и графика используют одну общую память. Благодаря этому модель не нужно “перегонять” между разными компонентами, как в обычных системах с отдельной видеокартой. Всё работает быстрее и эффективнее, без лишних задержек.

Mac Mini M4 Pro с 64 ГБ памяти стоит значительно дешевле профессионального GPU-сервера, потребляет 30–40 Вт в нагрузке, занимает место на столе и работает бесшумно. При этом позволяет запускать модели масштаба 30–70 млрд параметров с приемлемой скоростью для бизнес-задач.

Для стартапа или компании среднего размера это означает полноценный локальный AI-сервер без серверной комнаты и без капитальных затрат уровня enterprise.

Архитектура решения

Это ключевой блок – то, что отличает реально работающую систему от набора случайно установленных инструментов.

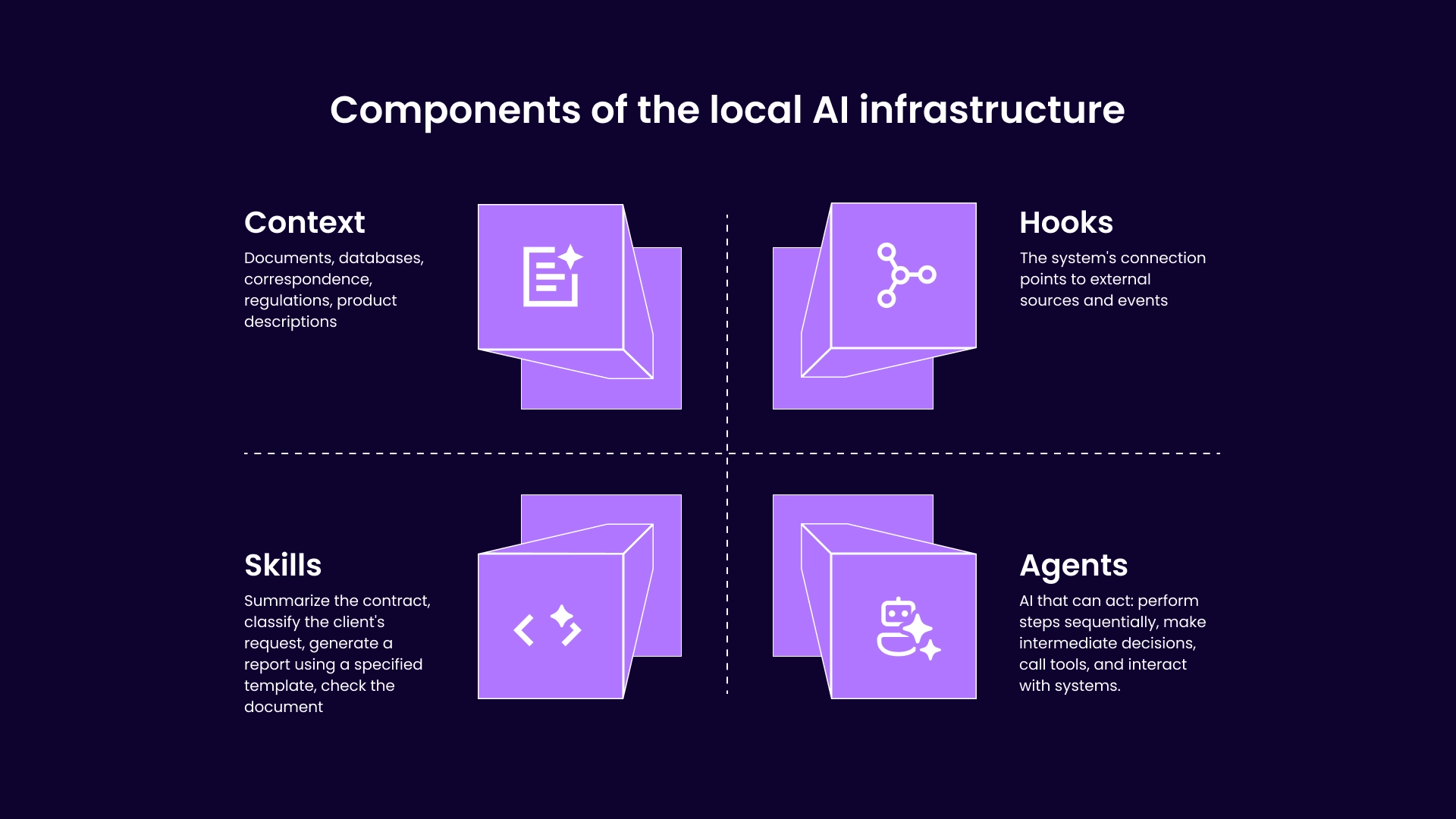

Рабочая локальная AI-инфраструктура строится на четырёх уровнях.

Контекст (Context)

Это то, что модель знает о вашей компании. Документы, базы данных, переписка, регламенты, продуктовые описания – всё, что необходимо, чтобы AI отвечал не абстрактно, а конкретно.

Контекст формируется через RAG-пайплайн: документы загружаются, разбиваются на фрагменты, преобразуются в векторы и индексируются. При каждом запросе система автоматически извлекает релевантные фрагменты и передаёт их модели.

Без правильно выстроенного контекстного слоя модель отвечает на основе общих знаний. С ним – на основе ваших данных.

Навыки (Skills)

Это набор специализированных возможностей, которыми оснащена система: суммировать договор, классифицировать обращение клиента, сформировать отчёт по заданному шаблону, проверить документ на соответствие регламенту.

Каждый навык – это отдельно настроенный модуль: со своим промптом, своей логикой, своими источниками данных. Навыки не универсальны – они заточены под конкретные задачи компании.

Хуки (Hooks)

Это точки подключения системы к внешним источникам и событиям. CRM обновила статус клиента – AI получает уведомление. Поступил новый документ – запускается автоматическая обработка. Сотрудник отправил запрос через Slack – система реагирует.

Хуки превращают AI из инструмента, к которому нужно обращаться вручную, в компонент бизнес-процесса, который работает самостоятельно.

Агенты (Agents)

Верхний уровень архитектуры. Агент – это AI, который умеет не только отвечать, но и действовать: последовательно выполнять шаги, принимать промежуточные решения, вызывать инструменты, взаимодействовать с системами.

Например: агент получает запрос на подготовку отчёта – ищет нужные данные в базе знаний, обращается к CRM через API, формирует структуру, генерирует текст и отправляет результат в нужный канал. Всё это без участия человека.

Четыре уровня работают вместе. Убрать один – и система теряет либо точность, либо гибкость, либо возможность интеграции.

Как это реализуется на практике

Ниже – последовательность шагов, которую можно пройти с нуля, чтобы развернуть локальную AI-систему.

1. Подготовка среды

Сначала убедитесь, что устройство подходит:

- Желательно от 16 ГБ объединённой памяти (лучше 32 ГБ, если планируете работать с большими моделями)

- Достаточно свободного места (минимум 20–50 ГБ под модели и данные)

Далее:

1.1. Обновите macOS до актуальной версии

1.2. Установите Ollama

- скачайте с официального сайта

- установите как обычное приложение

1.3. Проверьте, что всё работает:

- откройте терминал

- выполните команду: ollama run llama3

1.4. Если модель скачалась и отвечает – базовая среда готова.

На этом этапе у вас уже есть локальный AI, но без подключения к вашим данным.

2. Выбор и запуск моделей

Теперь нужно понять, какие модели использовать.

Начните с простого:

Что сделать:

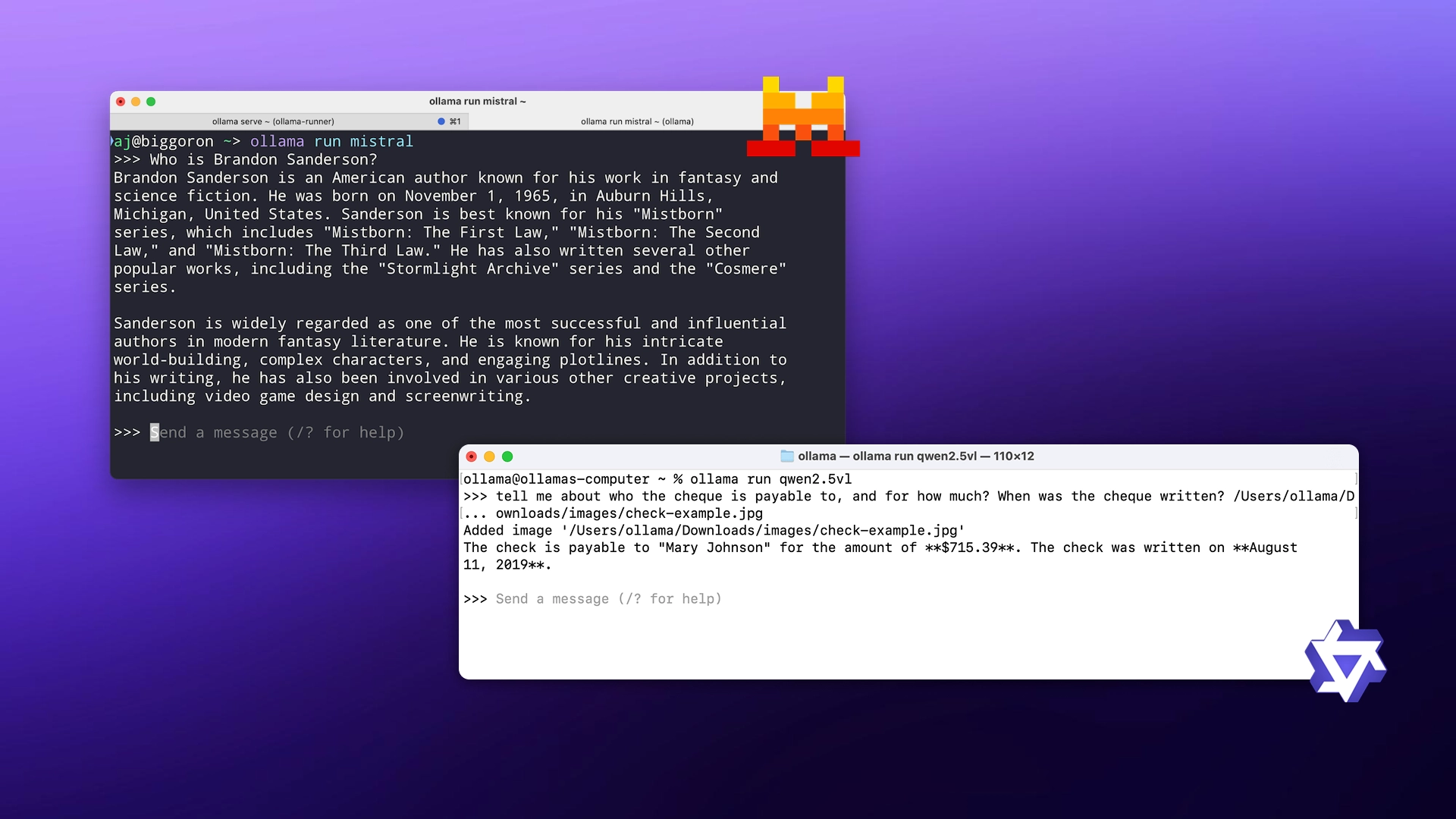

- Скачайте 1–2 модели для теста:

ollama run mistral

ollama run qwen - Протестируйте их на своих задачах:

- задать вопрос

- попросить написать текст

- дать кусок документа

Обратите внимание на:

- скорость ответа

- качество текста

- “понимание” запроса

После этого выберите одну основную модель и, при необходимости, одну дополнительную.

3. Подключение базы знаний

Теперь добавляем ваши данные.

Шаг 1: подготовка документов

Соберите всё, с чем модель должна работать:

- PDF-файлы

- заметки

- инструкции

- переписки (если нужно)

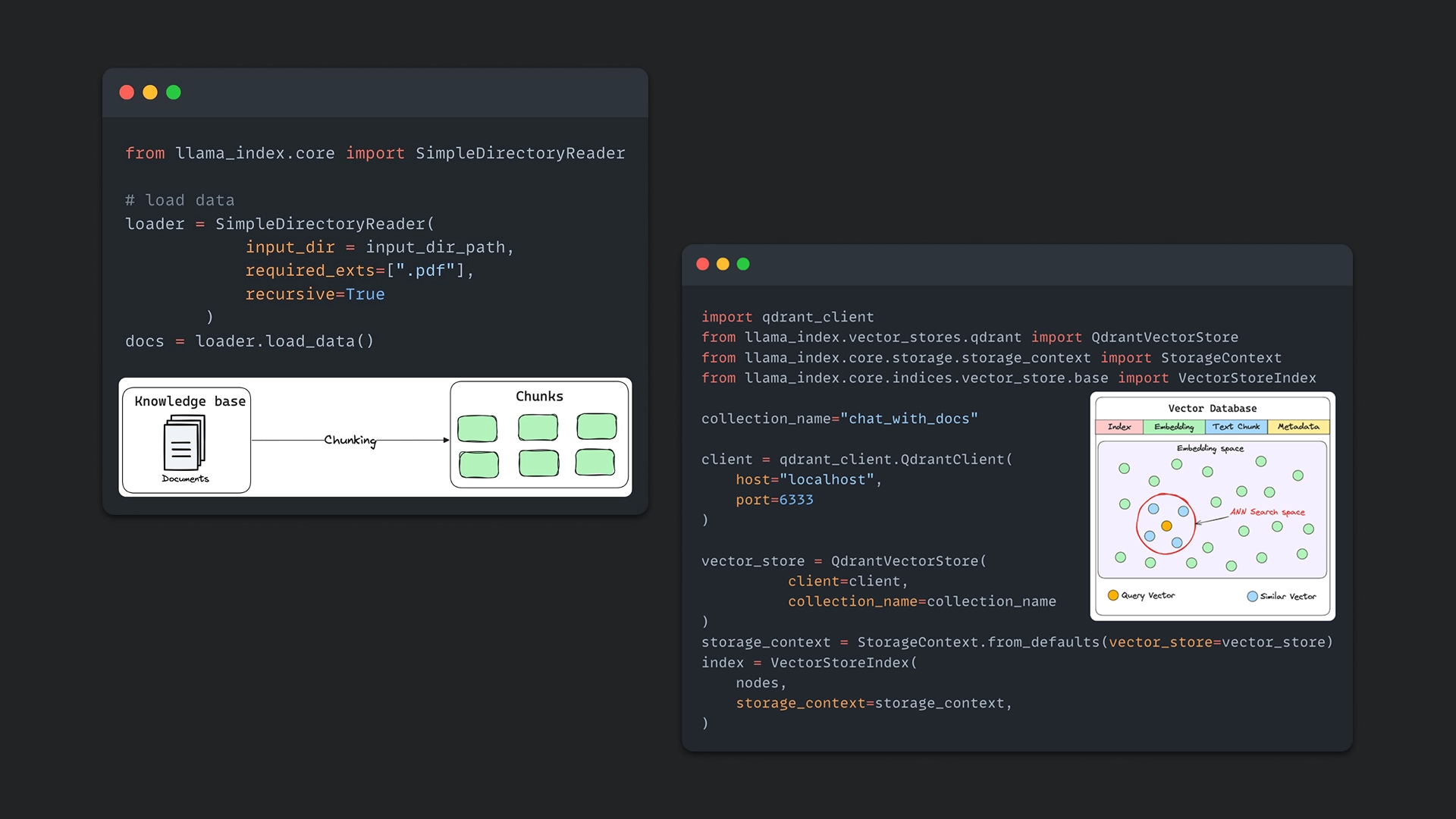

Шаг 2: разбивка на части (chunking)

Документы делятся на небольшие фрагменты (обычно 300–800 слов). Это нужно, чтобы модель могла точно находить нужные куски.

Шаг 3: создание векторной базы

Установите одну из БД:

Далее:

- Преобразуйте текст в эмбеддинги (векторы)

- Сохраните их в базу

- Привяжите каждый фрагмент к исходному документу

На практике это делается через Python или готовые библиотеки (например LangChain или LlamaIndex).

4. Настройка RAG

Теперь нужно “связать” модель и базу. Предполагается, что у вас уже установлен Ollama или настроен доступ к другой LLM через API.

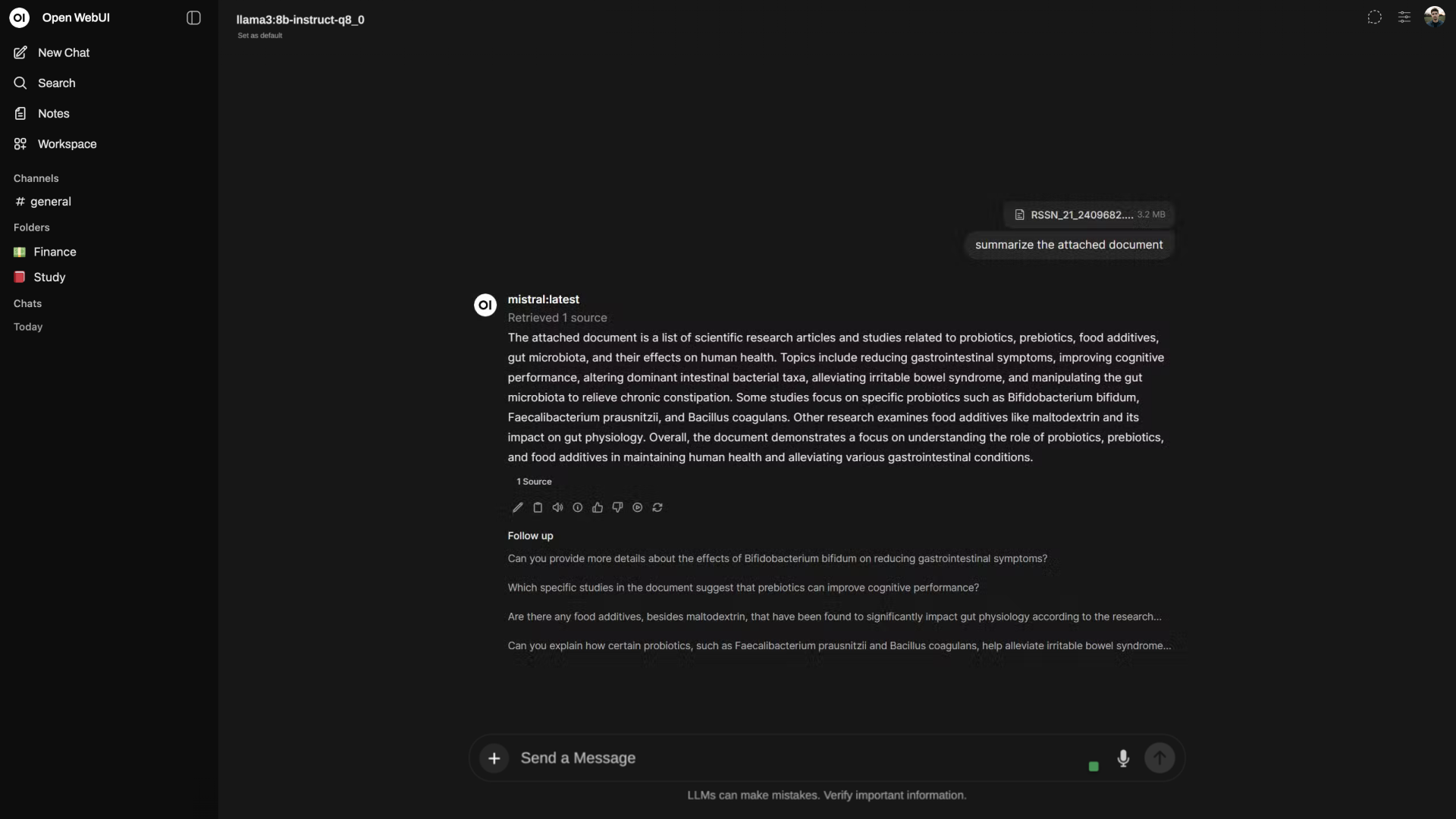

Шаг 1: Установите интерфейс для работы

Чтобы не работать через терминал, нужен интерфейс:

- Open WebUI – более гибкий вариант

- LM Studio – проще для старта

Что сделать:

- Установите выбранный инструмент

- Запустите его

- Убедитесь, что он “видит” вашу модель (через Ollama или API)

Шаг 2: Выберите и активируйте модель

В интерфейсе:

- Откройте список моделей

- Выберите уже установленную (например):

- Mistral

- Llama

- Qwen

- Установите её как основную для чата

Проверьте: модель должна отвечать на обычные вопросы.

Шаг 3: Добавьте документы (база знаний)

В интерфейсе найдите раздел:

- “Knowledge” / “Documents” / “Files”

Далее:

- Загрузите файлы (PDF, DOCX, TXT)

- Дождитесь обработки

Система автоматически:

- разобьёт текст на фрагменты

- создаст векторный индекс (обычно на базе Chroma или аналогов)

Шаг 4: Включите использование базы (RAG)

Теперь важно связать модель и документы:

- Откройте настройки чата / ассистента.

- Найдите параметры:

- “Use knowledge base”

- “Retrieval”

- “Context”

- Включите их.

- Укажите, какие документы использовать.

Без этого шага RAG не будет работать, даже если файлы загружены.

Шаг 5: Задайте правило ответа

В настройках ассистента (System Prompt) добавьте:

Отвечай только на основе загруженных документов. Если информации недостаточно –v сообщи об этом.

Это снижает вероятность выдуманных ответов.

Шаг 6: Настройте параметры поиска

Если интерфейс позволяет, проверьте:

- Top K (количество фрагментов) → 3–5

- Search type → similarity или hybrid

Если таких настроек нет – используйте значения по умолчанию.

Шаг 7: Проверьте работу

Сделайте два теста:

- Вопрос, на который есть ответ в документах

- Вопрос, на который ответа нет

Ожидаемый результат:

- в первом случае – точный ответ по данным

- во втором – честное “информации нет”

5. Запуск агентов

Шаг 1: Откройте интерфейс и перейдите к созданию ассистента

Запустите Open WebUI. В меню найдите раздел “Assistants”, “Agents” или “Workspaces” и нажмите кнопку создания нового ассистента (Create Assistant).

Шаг 2: Определите задачу агента

В поле “Instructions” или “System Prompt” опишите, что он должен делать.

Пример: отвечать на вопросы клиентов, анализировать документы или помогать с отчётами.

Шаг 3: Подключите базу знаний (RAG)

Найдите блок “Knowledge” или “Documents” и выберите загруженные ранее файлы.

Если документы ещё не добавлены – загрузите их здесь же.

Это позволит агенту отвечать на основе ваших данных, а не только “общих знаний”.

Шаг 4: При необходимости добавьте инструменты

В некоторых версиях интерфейса есть раздел “Tools” или “Functions”.

Там можно подключить:

- API

- внешние сервисы

- дополнительные источники данных

Если этого блока нет – можно работать только с базой знаний, этого достаточно для большинства задач.

Шаг 5: Задайте логику работы

Логика прописывается текстом в том же поле “Instructions”.

Пример:

- если вопрос по документам → используй базу знаний

- если информации нет → сообщи об этом

- не придумывай ответы

Шаг 6: Настройте формат ответа

Также через инструкции задайте, как должен выглядеть результат.

Например:

- короткий ответ

- структурированный ответ (пункты)

- JSON (если нужно для интеграций)

Шаг 7: Сохраните ассистента и протестируйте

Сохраните настройки, откройте чат с этим ассистентом и задайте несколько реальных вопросов.

Проверьте:

- использует ли он документы

- не выдумывает ли ответы

- соблюдает ли формат

Шаг 8: При необходимости скорректируйте

Если ответы слабые:

- уточните инструкции

- переформулируйте логику

- проверьте, что база знаний действительно подключена

- при необходимости смените модель в Ollama

Что получается в итоге

После прохождения всех шагов у вас есть:

- локально запущенная модель

- база знаний с вашими данными

- система поиска по этим данным (RAG)

- агенты под конкретные задачи

И всё это работает без облака и без передачи данных наружу.

Если вы не хотите настраивать систему самостоятельно, для масштабирования, интеграции и оптимизации работы модели можно привлечь опытного инженера.

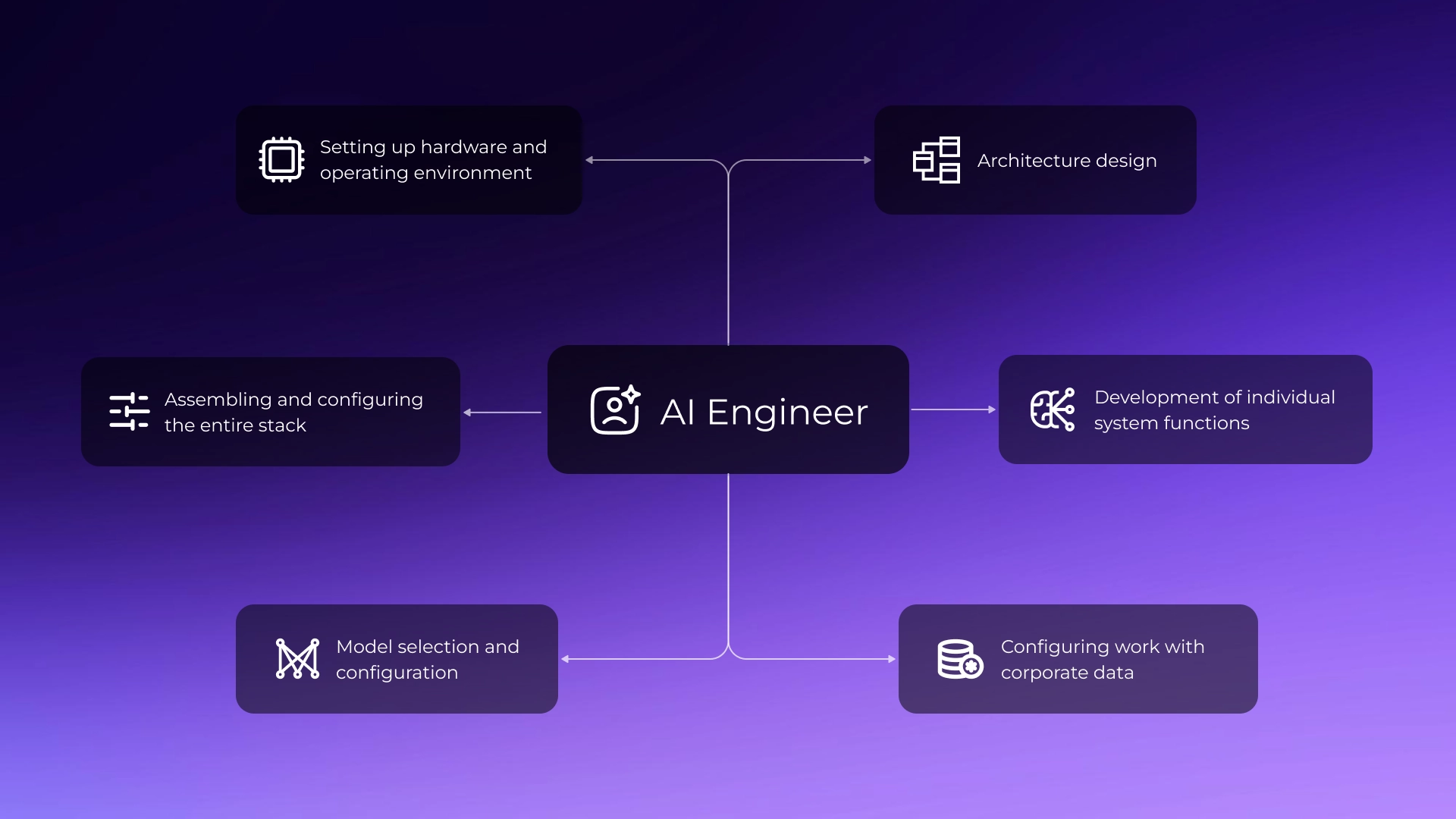

Что делает инженер по локальному AI

Инженер по локальному AI – это не разработчик общего профиля и не специалист по данным. Это человек на пересечении трёх областей: он понимает, как работает железо, как устроены языковые модели и как собрать из набора инструментов работающий бизнес-продукт. Такой специалист встречается редко – именно потому, что каждая из этих областей сама по себе глубокая.

- Настройка железа и операционной среды. Mac Mini в роли AI-сервера требует серьёзной подготовки. Инженер настраивает систему так, чтобы она стабильно работала под постоянной нагрузкой: правильно распределяет память между несколькими моделями, обеспечивает доступ к системе внутри сети компании, настраивает мониторинг температуры и нагрузки, организует резервное копирование. Также прорабатывается автоматический запуск всех сервисов после перезагрузки и ведение системных журналов – чтобы при любой нештатной ситуации было понятно, что произошло.

- Сборка и настройка всего стека. Как вы уже знаете, локальный AI – это не одна программа, а несколько взаимосвязанных компонентов. Инженер разворачивает каждую и связывает их между собой: среду для запуска моделей, интерфейс для обращения к системе из других приложений, базу для хранения корпоративных знаний, при необходимости – инструменты для обработки задач в фоне. Каждый компонент настраивается под конкретную нагрузку, а не запускается с настройками по умолчанию.

- Подбор и настройка моделей. Выбор модели требует проверки, рейтинги и отзывы тут не помогут. Инженер проверяет, как конкретная модель справляется именно с задачами компании: тестирует качество ответов на реальных примерах, замеряет скорость работы на целевом железе, оценивает потребление памяти. При необходимости модель "сжимается" – это позволяет запустить более мощную версию в рамках доступных ресурсов с контролируемой потерей качества.

- Проектирование архитектуры. Это наиболее ответственная часть работы. Инженер продумывает, как данные движутся по всей системе: откуда берутся, как обрабатываются, кто и к чему имеет доступ. Заранее закладывается логика роста: что изменится в системе, если пользователей станет в три раза больше или объём документов вырастет в десять раз. Продумывается и поведение при сбоях – как система восстанавливается, если один из компонентов перестаёт работать.

- Разработка отдельных функций системы. Каждая функция – анализ договора, классификация обращения, генерация отчёта – это отдельно спроектированный модуль. Инженер определяет, какие данные нужны для работы каждой функции, как именно она должна обрабатывать запрос и в каком формате возвращать результат.

- Настройка работы с корпоративными данными. Качество ответов системы напрямую зависит от того, как настроен поиск по базе знаний. Инженер подбирает оптимальный способ разбивки документов на фрагменты, настраивает логику поиска релевантных частей и определяет, как найденная информация включается в запрос к модели. Именно здесь чаще всего возникают проблемы у тех, кто пытается собрать систему самостоятельно: технически всё запускается, но ответы получаются неточными или не по теме.

- Доработка после запуска. Система не выходит на рабочее качество сразу. После запуска начинается цикл тестирования на реальных сценариях: фиксируются ошибки, корректируются настройки, дорабатывается логика. Инженер выстраивает процесс оценки качества ответов – часть проверок автоматизируется, часть требует участия людей, которые хорошо знают предметную область. Это итерационная работа, и она является частью внедрения, а не его последствием.

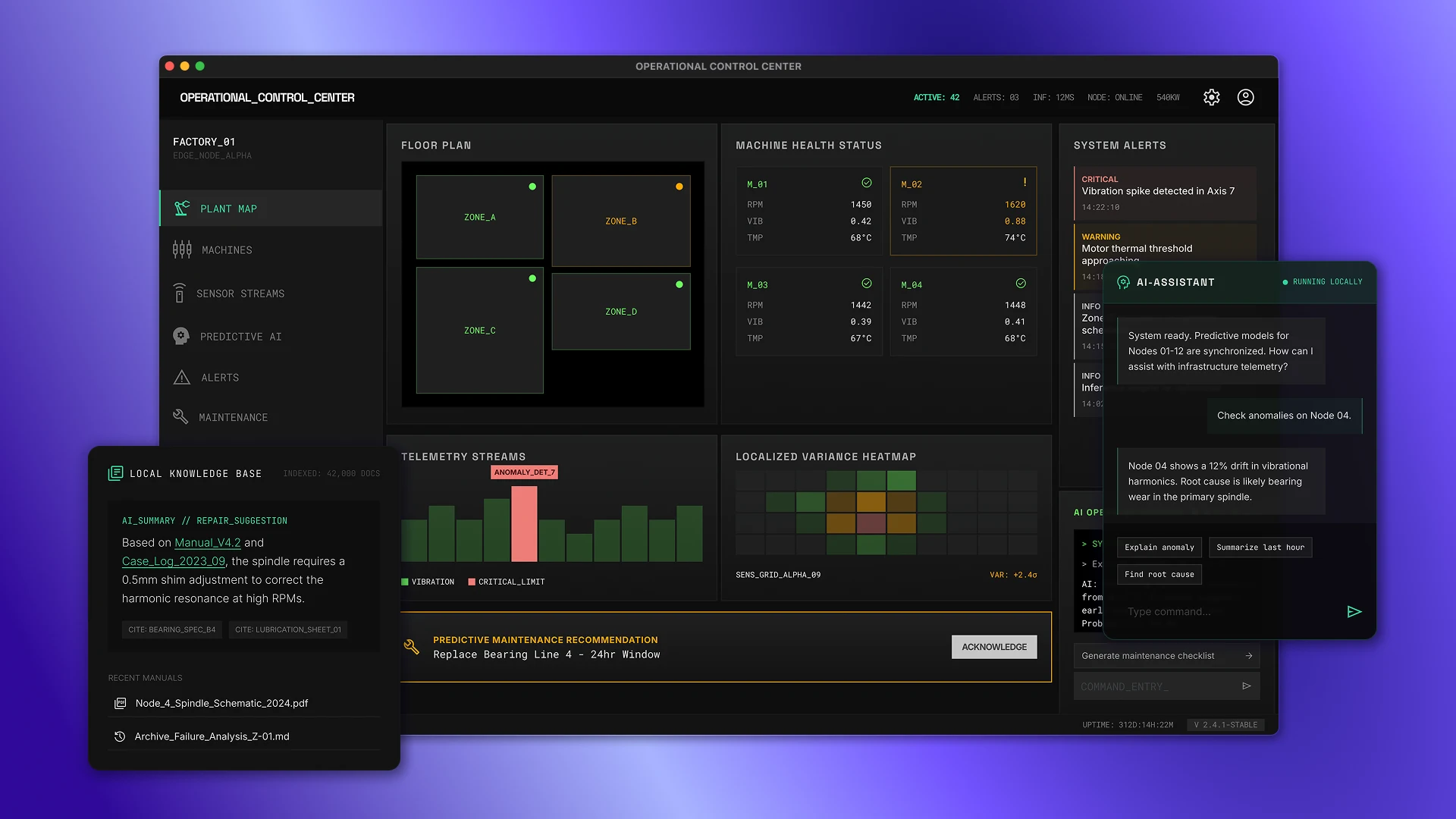

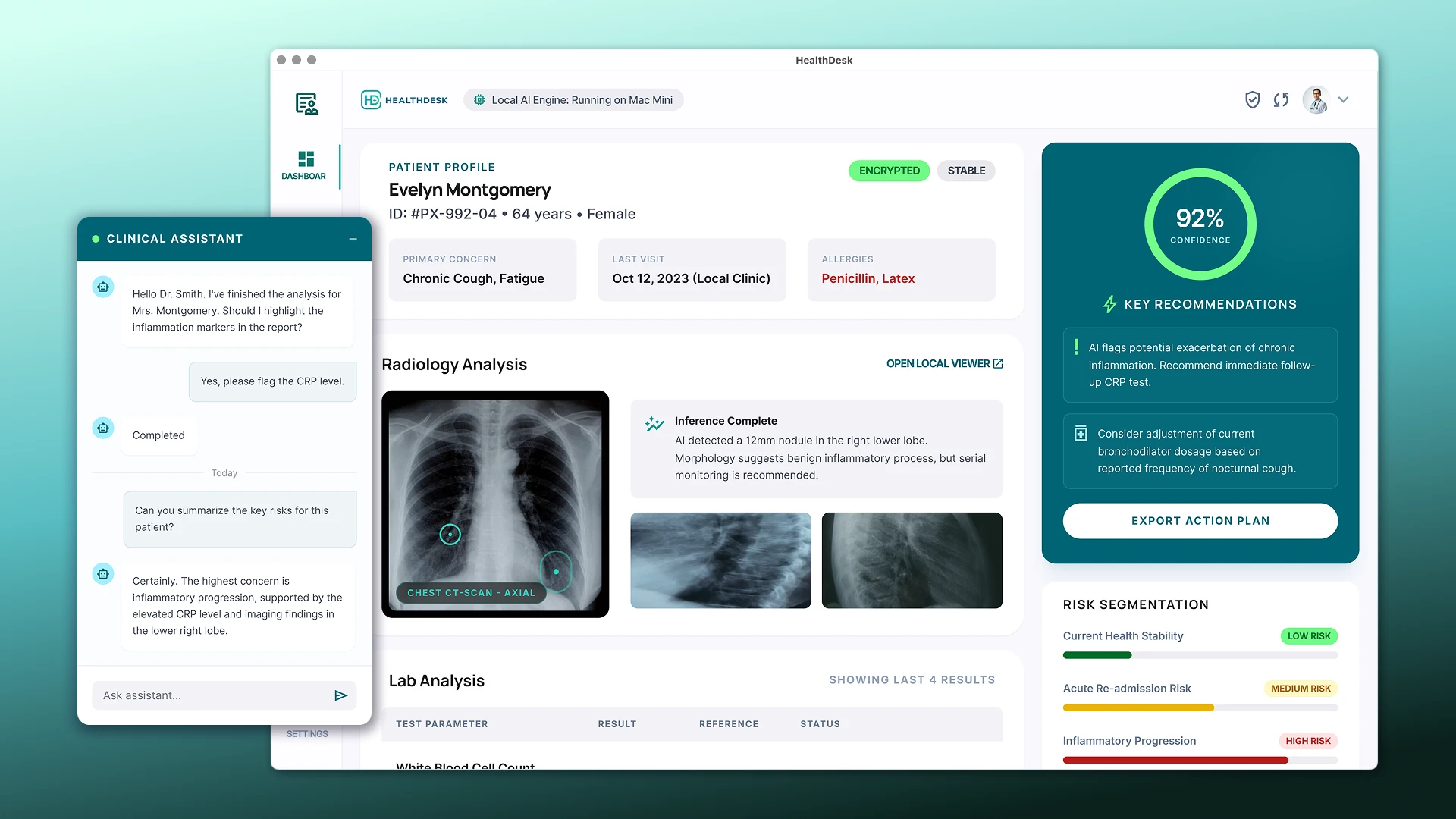

Примеры использования

AI-ассистент для внутренней поддержки

Отрасль: IT-компания, SaaS

Размер: 300–350 сотрудников

Проблема: HR и IT тратили до 30% рабочего времени на однотипные вопросы от сотрудников – по регламентам, процессам согласования, внутренним инструкциям. Информация существовала в документах, но найти её самостоятельно было неудобно.

Решение: На Mac Mini развёрнут локальный AI-ассистент, подключённый к внутренней базе документов компании. Сотрудники обращаются к нему через Slack на естественном языке и получают точные ответы со ссылкой на источник. Данные не покидают периметр компании. Нагрузка на HR и IT сократилась, скорость онбординга новых сотрудников выросла.

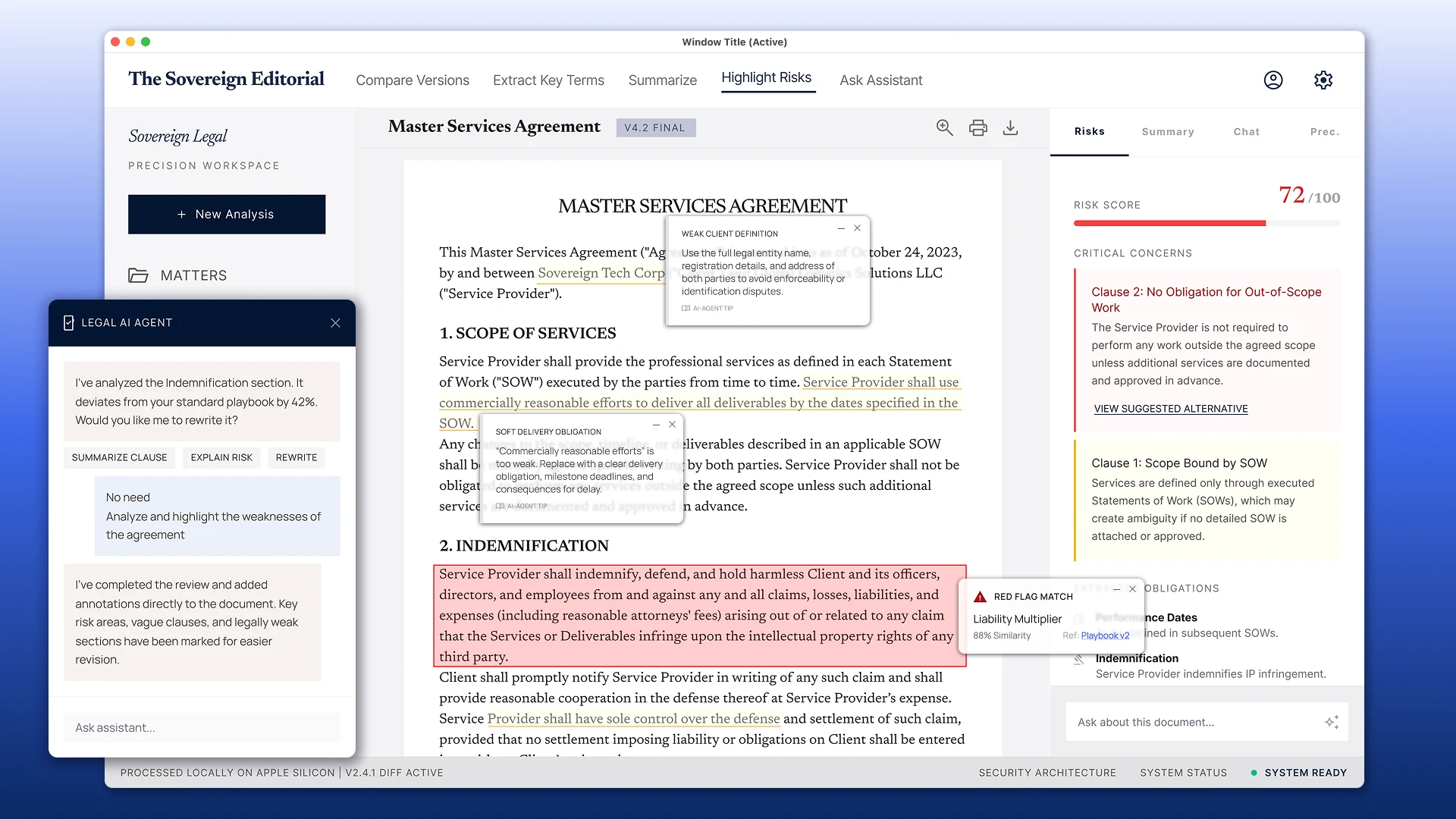

Анализ договоров и документов

Отрасль: Дистрибуция, оптовая торговля

Размер: 200–300 сотрудников

Проблема: Юридический департамент обрабатывал до 50 договоров поставки в месяц. Первичный разбор одного документа занимал от 40 минут до полутора часов: проверка условий оплаты, ответственности сторон, нестандартных пунктов.

Решение: На Mac Mini развёрнута локальная AI-система для анализа документов. Модель извлекает ключевые условия, сравнивает с внутренним шаблоном и формирует структурированное резюме с пометками по спорным пунктам. Время первичного анализа сократилось до 5–7 минут. Финальное решение остаётся за юристом – но уже с готовой аналитической базой. Все документы обрабатываются локально.

CRM с AI-слоем

Отрасль: B2B-продажи, профессиональные услуги

Размер: 40–60 сотрудников

Проблема: В CRM накопилась история по сотням клиентов – переписка, звонки, сделки, отказы. Перед каждым звонком менеджеры тратили время на ручной просмотр истории, но закономерности в данных оставались незамеченными.

Решение: На Mac Mini развёрнут AI-агент, интегрированный с CRM через API. Перед звонком агент автоматически формирует саммари по клиенту: история взаимодействий, открытые вопросы, контекст последней встречи. После звонка фиксирует итоги и предлагает следующий шаг. Со временем система начала выявлять паттерны успешных сделок в разрезе сегментов. Время на подготовку к звонку сократилось с 15–20 минут до 2–3.

Локальный AI vs Облачный AI

| Параметр | Локальный AI | Облачный AI |

|---|---|---|

| Конфиденциальность | Данные не покидают компанию | Данные обрабатываются на внешних серверах |

| Стоимость | Фиксированные инвестиции в железо | Переменные расходы, растут с объёмом |

| Качество моделей | Ограничено локально запускаемыми моделями | Доступ к самым мощным моделям (GPT-4o, Claude 3.5) |

| Скорость внедрения | Требует настройки и времени | Быстрый старт через API |

| Гибкость настройки | Полный контроль | Ограничено возможностями провайдера |

| Масштабируемость | Ограничена железом | Масштабируется легко |

Когда окупается локальное решение. Ориентировочная логика: если компания тратит на облачный AI от 2 000–3 000 EUR в месяц (API-затраты плюс инструменты), Mac Mini M4 Pro с настройкой окупается за 6–12 месяцев. При более высокой нагрузке – быстрее. При низкой – облако может быть экономичнее.

Для задач, где конфиденциальность критична, расчёт другой: облачное решение может быть просто неприемлемо вне зависимости от стоимости.

Многие компании приходят к гибридной архитектуре: локально – чувствительные данные и высокочастотные задачи, облако – задачи, требующие максимальной мощности модели.

Ограничения и нюансы

Было бы нечестно не сказать об этом прямо.

Не всё можно локально. Самые мощные модели (GPT-4o, Claude 3.5/3.7 Sonnet, Gemini Ultra) требуют колоссальных вычислительных ресурсов и доступны только через API. Локально запускаемые модели сильнее в одних задачах, слабее в других. Для задач, где нужна максимальная точность генерации или сложный многошаговый reasoning, облачные модели пока выигрывают.

Есть ограничения по мощности. Mac Mini при всех своих достоинствах – не дата-центр. При одновременной нагрузке от нескольких пользователей скорость ответа снижается. Если AI одновременно использует около 15–20 человек это, как правило, некритично. Для высоконагруженных систем потребуется более серьёзное железо или кластерная архитектура.

Система требует настройки и сопровождения. После установки необходимо провести первоначальную конфигурацию, чтобы обеспечить полноценную работу. Потребуется периодическое обновление моделей и компонентов, а также мониторинг качества ответов. Это непрерывный процесс, а не разовая настройка.

Когда бизнесу это действительно нужно

Выбор локальной AI-инфраструктуры оправдан, если одновременно выполняется несколько условий:

- в компании есть значимый массив внутренних данных (документы, базы знаний, история взаимодействий);

- конфиденциальность этих данных важна – по требованиям регулятора, внутренней политике или здравому смыслу;

- есть повторяющиеся процессы, которые AI может автоматизировать или ускорить;

- компания готова к инженерному внедрению, а не ищет готовый продукт "под ключ" без адаптации.

Если всё это про вас – локальная AI-инфраструктура не просто возможна, она целесообразна.

Итог

Локальный AI на Apple Silicon – рабочий и практичный подход, уже используемый компаниями, которым важен контроль над данными и предсказуемость затрат.

Mac Mini M4 Pro обеспечивает достаточную мощность, открытые модели демонстрируют приемлемое качество, а стек инструментов для локального развёртывания зрелый и стабильный.

Основная задача – правильно выстроить архитектуру: настроить контекстный слой, RAG, разработать навыки под конкретные бизнес-задачи, запустить агентов и обеспечить надёжную работу системы. Ошибки на этом уровне приводят к неточным ответам, проблемам с масштабированием и интеграцией, поэтому важно продумать структуру с самого начала.

Мы помогаем компаниям спроектировать и запустить локальные AI-системы: от выбора архитектуры до работающего решения. Если хотите обсудить вашу задачу – напишите нам.