AI / ML QA Engineer

Что делает AI / ML QA Engineer

AI-система, которая не прошла полноценное тестирование, – это риск для бизнеса. Языковая модель может уверенно выдавать неверную информацию, рекомендательная система – давать нерелевантные результаты, а классификатор – систематически ошибаться на определённых сегментах данных.

AI / ML QA Engineer – это специалист, который обеспечивает снижение таких ошибок в ИИ-проектах: тестирует точность и устойчивость моделей, выявляет галлюцинации, проверяет качество данных и оценивает поведение системы под нагрузкой. Его задача – убедиться, что AI-система ведёт себя предсказуемо и корректно не только в тестовой среде, но и в реальных условиях эксплуатации.

В цепочке разработки AI-систем QA Engineer стоит последним перед запуском: он принимает то, что построил AI Developer, обучил ML Engineer, подготовил Data Engineer и разметил Data Annotator, и даёт финальный ответ на вопрос – готова ли система к запуску для реальных пользовтелей.

Выберите разработчика

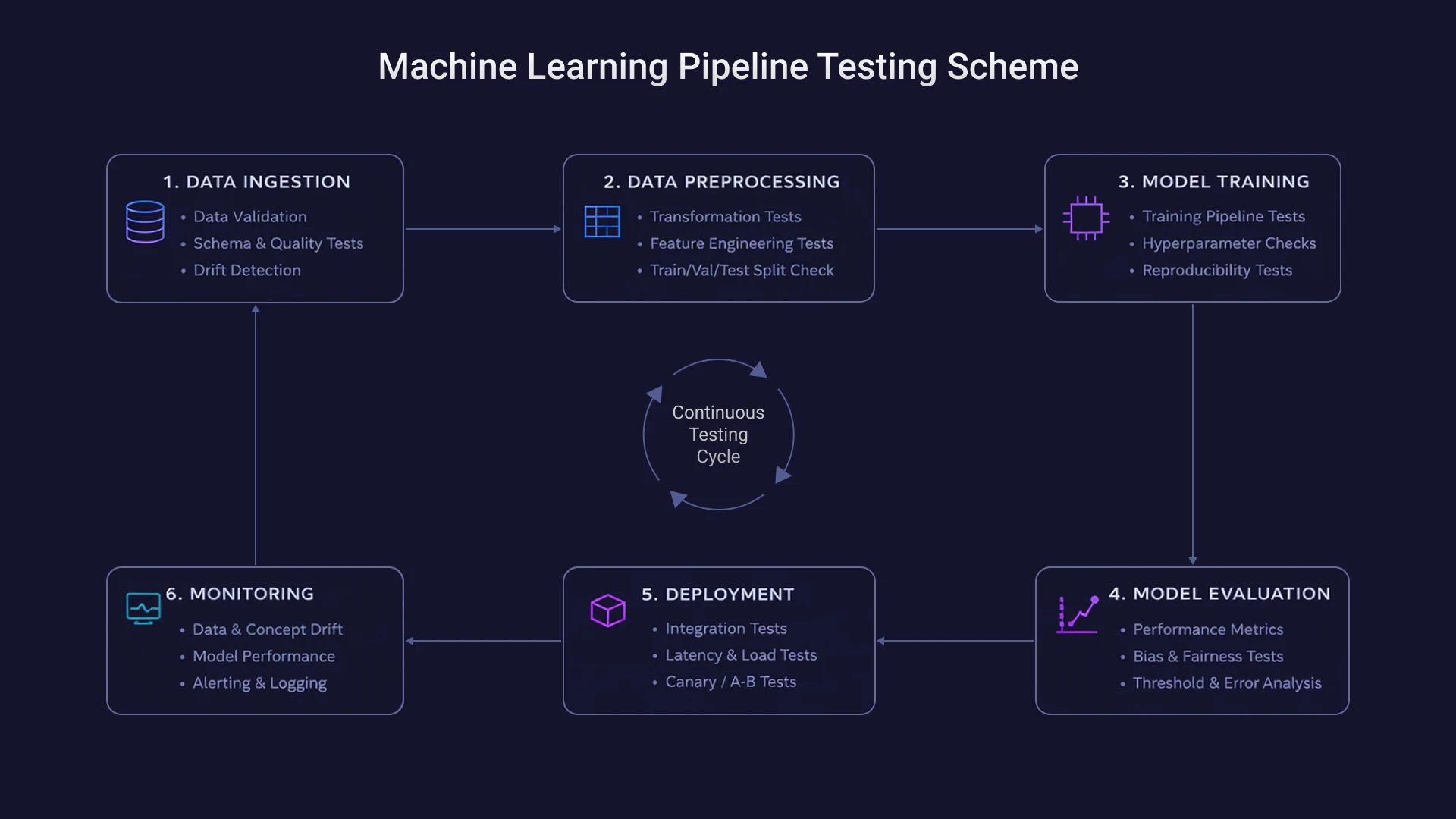

Как выглядит процесс работы AI / ML QA Engineer

QA в AI-проектах – это не разовая проверка перед релизом, а последовательный процесс, который охватывает данные, модели, приложения и их поведение в production.

Планирование QA (QA Planning). На старте AI / ML QA Engineer определяет тестовые сценарии, формирует оценочные наборы данных (evaluation datasets) и согласует критерии качества с командой. От того, насколько точно на этом этапе сформулированы требования, зависит глубина всего последующего тестирования.

Проверка данных (Dataset QA). Прежде чем тестировать модель, нужно убедиться в качестве данных, на которых она обучена. AI / ML QA Engineer проверяет датасеты на наличие ошибок разметки, выявляет смещения (bias) и оценивает репрезентативность выборок.

Тестирование ML-моделей (Model QA). AI / ML QA Engineer проверяет поведение модели на тестовых выборках, анализирует ключевые метрики – точность (accuracy), полноту (recall) и точность по классу (precision) – и выявляет сценарии, в которых модель ошибается.

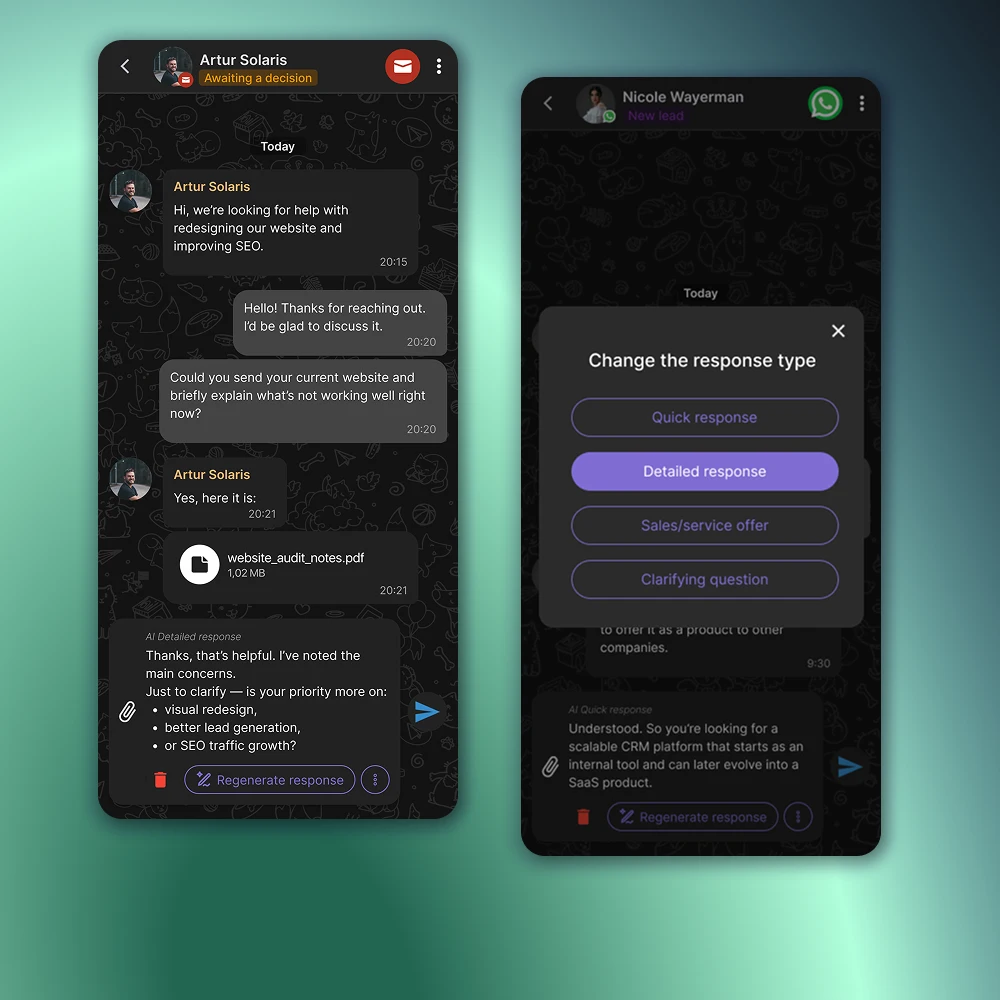

Тестирование LLM-приложений (LLM QA). Языковые модели требуют отдельного подхода: AI / ML QA Engineer проверяет корректность ответов, тестирует устойчивость промптов (prompt robustness) и выявляет галлюцинации – случаи, когда модель уверенно генерирует фактически неверную информацию.

Тестирование RAG-систем (RAG QA). В системах с дополненной генерацией (retrieval-augmented generation) качество ответа зависит не только от модели, но и от того, насколько релевантные документы она извлекает. AI / ML QA Engineer тестирует компонент поиска и проверяет, соответствуют ли источники контексту запроса.

Нагрузочное тестирование (Performance QA). AI / ML QA Engineer проверяет latency – время ответа системы – и тестирует её поведение под пиковой нагрузкой, чтобы убедиться, что производительность остаётся в допустимых пределах при реальном трафике.

Мониторинг в production (Production Monitoring). После запуска AI / ML QA Engineer анализирует логи, отслеживает аномалии в поведении модели и выявляет деградацию качества по мере изменения входных данных.

Инструменты AI / ML QA Engineer

Стек AI / ML QA Engineer охватывает инструменты для тестирования моделей, мониторинга и автоматизации проверок.

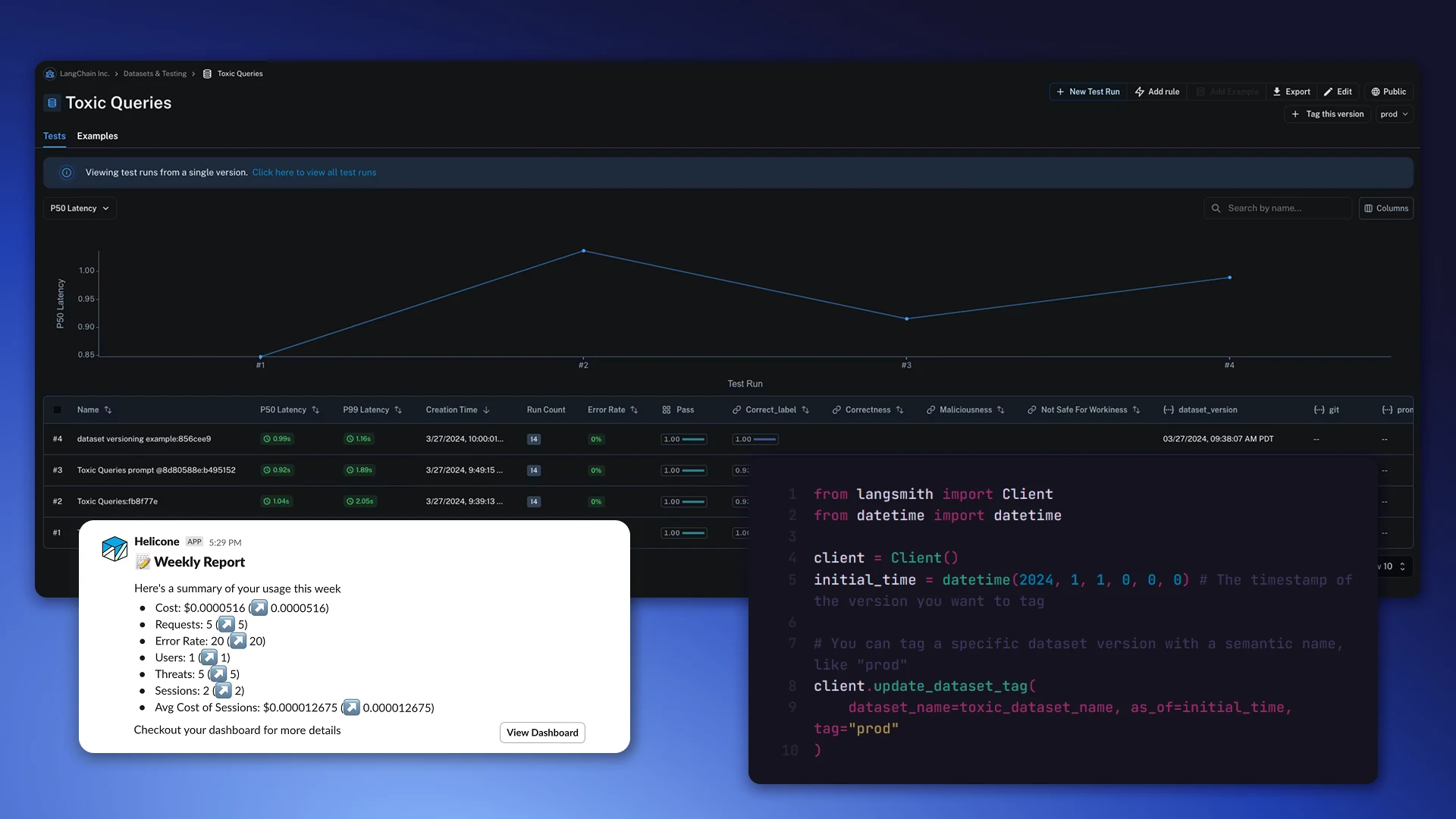

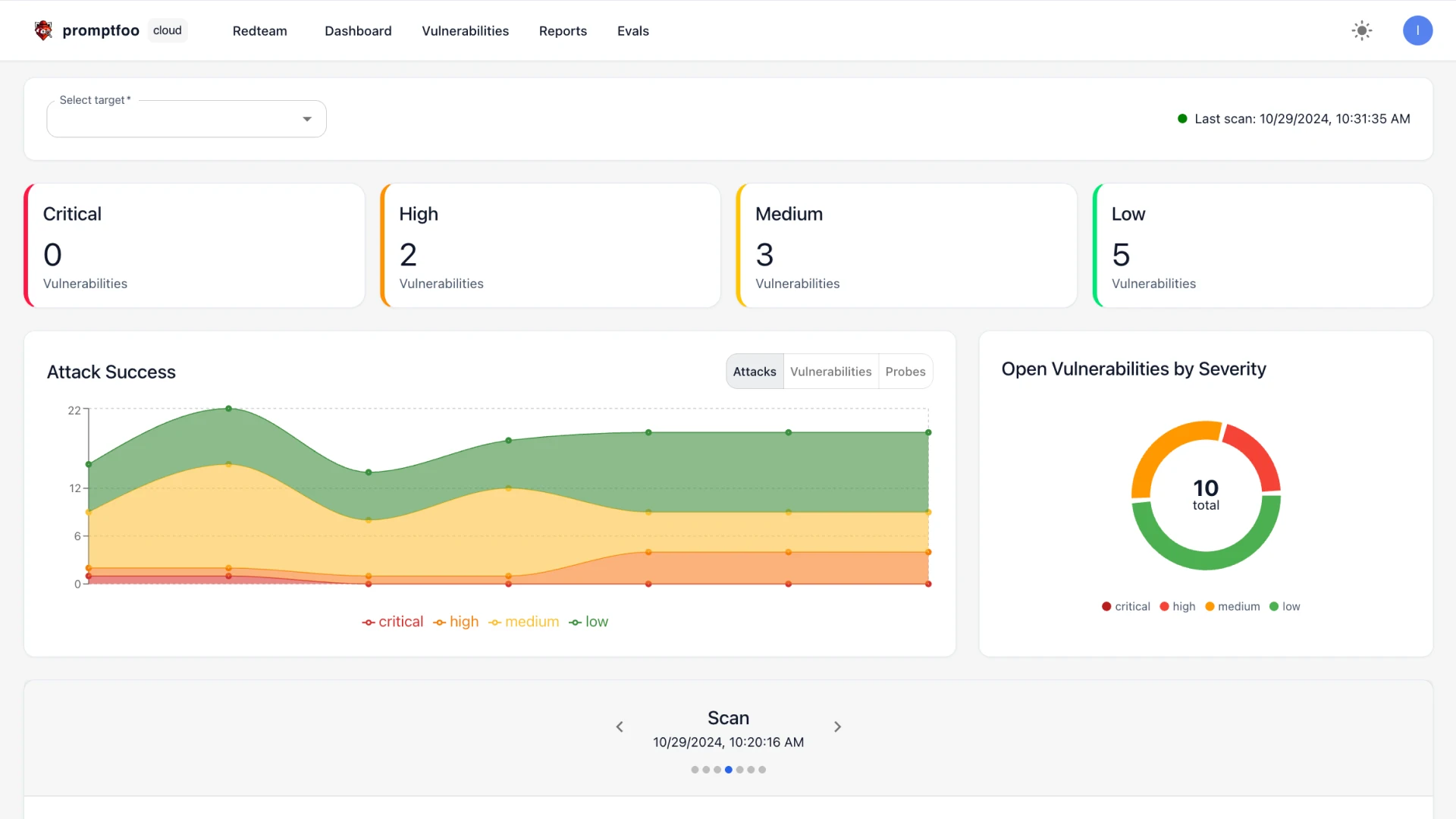

Тестирование LLM: LangSmith, Promptfoo, DeepEval – инструменты для оценки качества ответов языковых моделей, тестирования промптов и выявления галлюцинаций.

Мониторинг AI-систем: Langfuse и Helicone обеспечивают наблюдаемость LLM-приложений в production – отслеживание запросов, анализ latency и выявление аномалий.

Оценка ML-моделей: MLflow и Weights & Biases используются для отслеживания экспериментов, сравнения метрик и контроля версий моделей.

Автоматизация QA: Playwright, Selenium и Cypress применяются для сквозного тестирования интерфейсов AI-приложений, Postman – для проверки программных интерфейсов (API).

Метрики качества AI-систем

Качество AI-системы складывается из набора метрик, каждая из которых отвечает за свой аспект поведения модели.

Accuracy показывает долю корректных ответов модели на тестовой выборке и даёт общее представление о её точности.

Precision и Recall используются там, где важна не просто точность, а баланс между ложными срабатываниями и пропущенными ошибками – например, в классификационных задачах.

Hallucination rate – доля ответов, в которых модель генерирует фактически неверную информацию с высокой степенью уверенности. Особенно критична для LLM-приложений в медицине, праве и финансах.

Response relevance оценивает, насколько ответ модели соответствует контексту и намерению пользователя, а не просто является грамматически корректным текстом.

Latency – время ответа системы, которое напрямую влияет на пользовательский опыт и масштабируемость продукта.

Error rate фиксирует частоту сбоев и некорректных ответов в production и служит основным индикатором стабильности системы.

Где применяется AI / ML QA

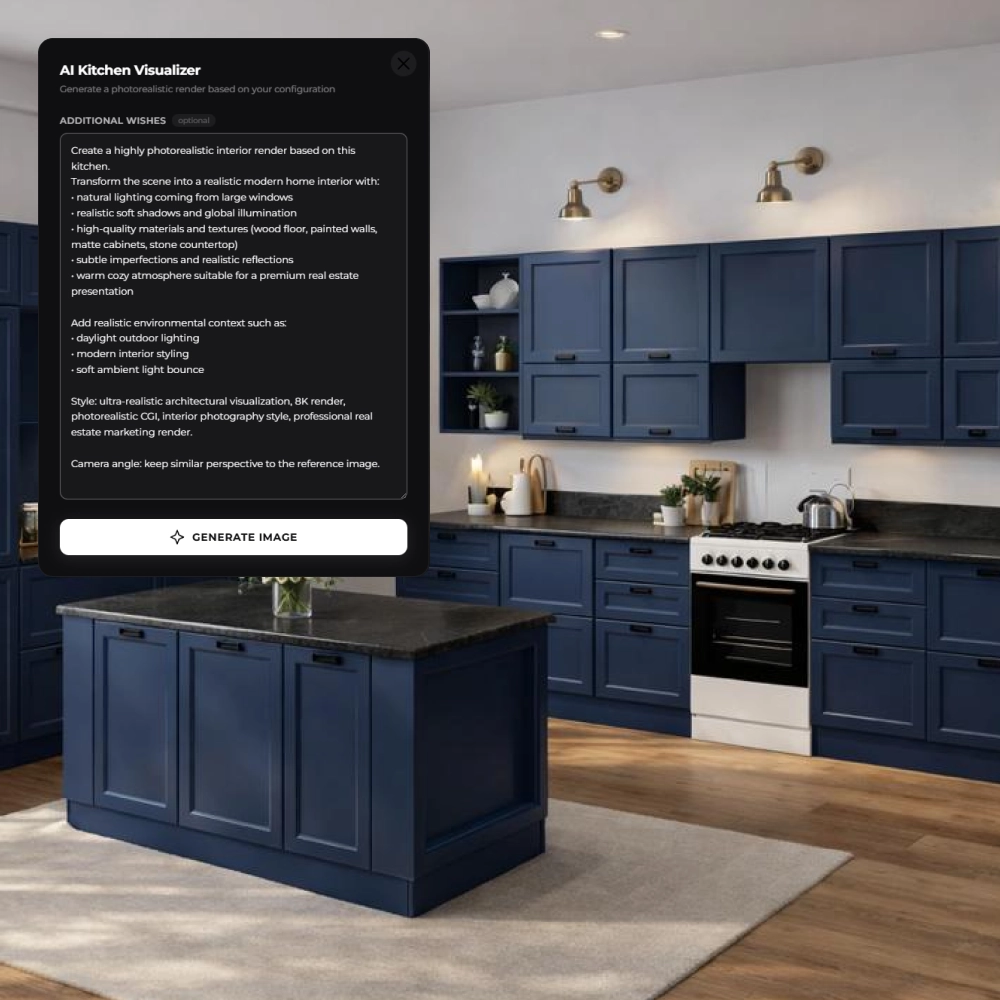

Любая AI или ML-система, которая взаимодействует с пользователями или участвует в принятии бизнес-решений, требует отдельного процесса тестирования.

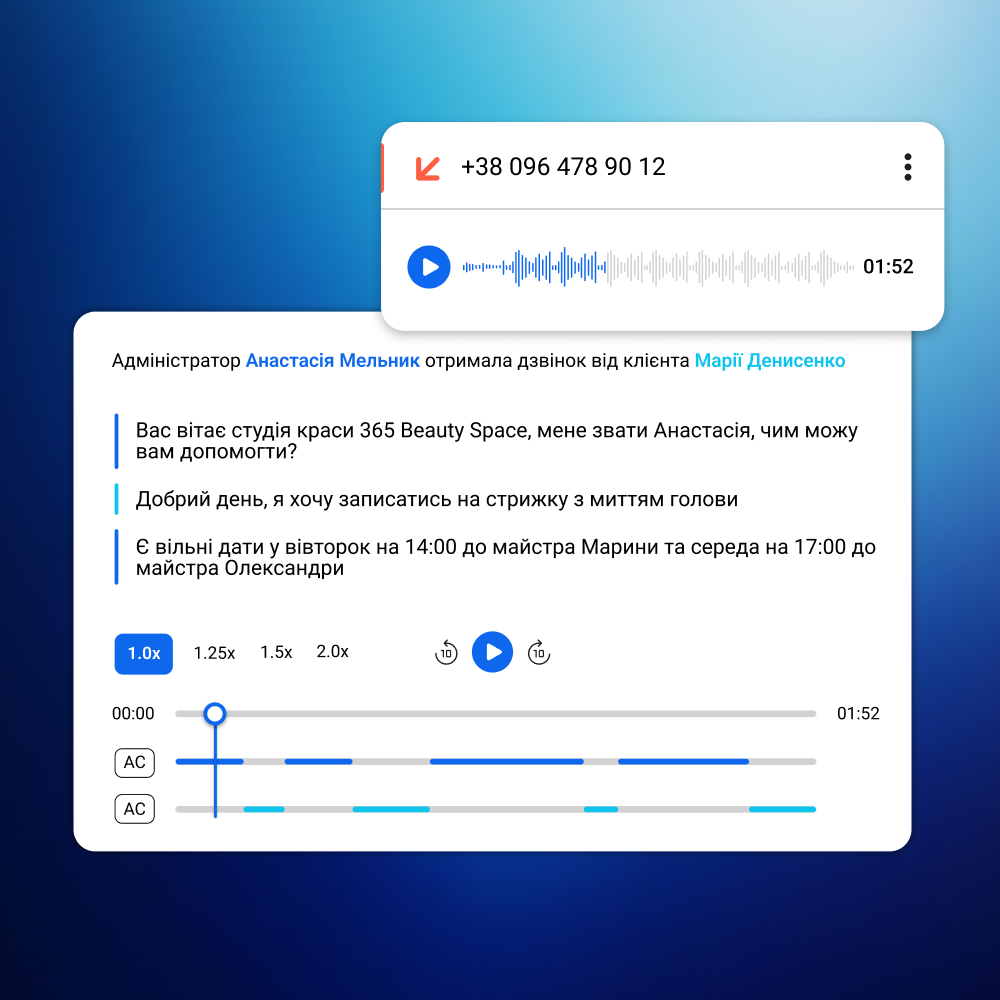

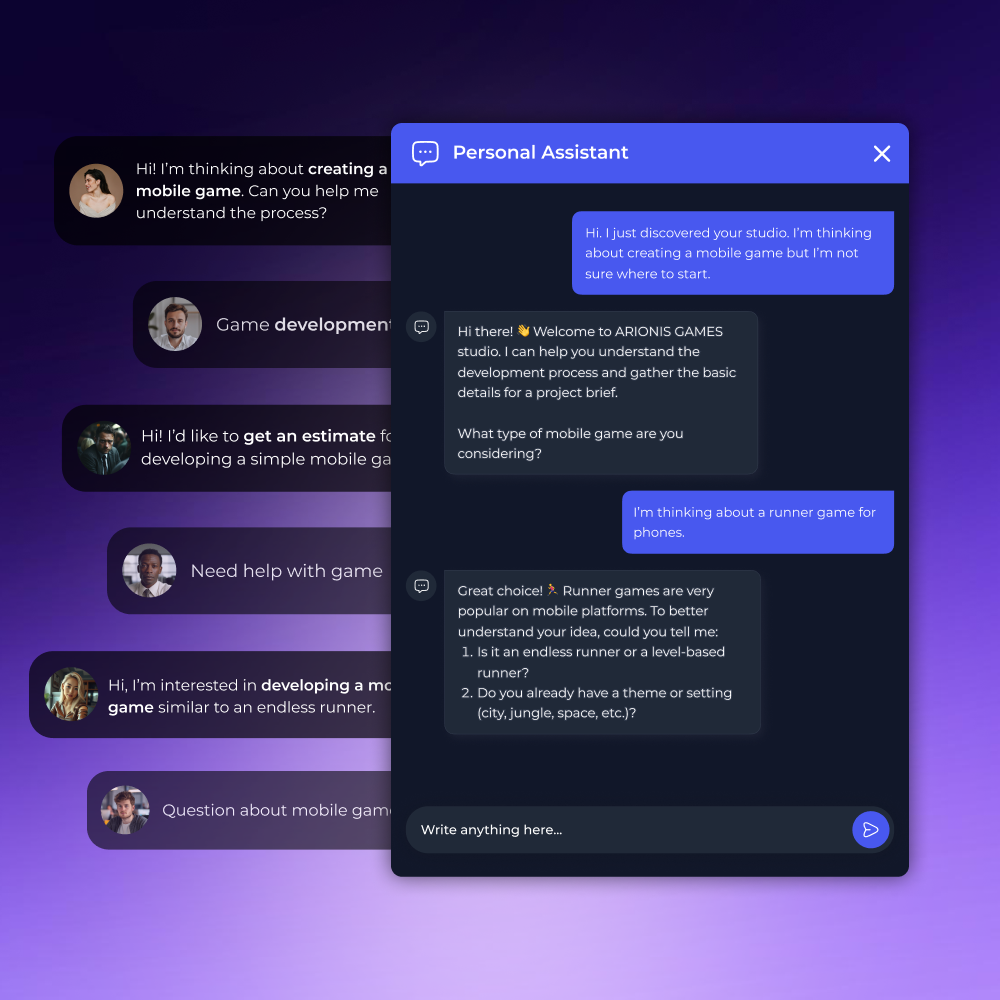

AI чат-боты и ассистенты. Представьте корпоративного ассистента, который отвечает на вопросы сотрудников по внутренним политикам компании – или клиентского бота в банке, который консультирует по продуктам. Такие системы должны давать точные ответы в любом сценарии диалога, включая провокационные и нестандартные запросы. AI / ML QA Engineer проверяет устойчивость модели, выявляет галлюцинации и тестирует граничные случаи до того, как система попадёт к пользователям.

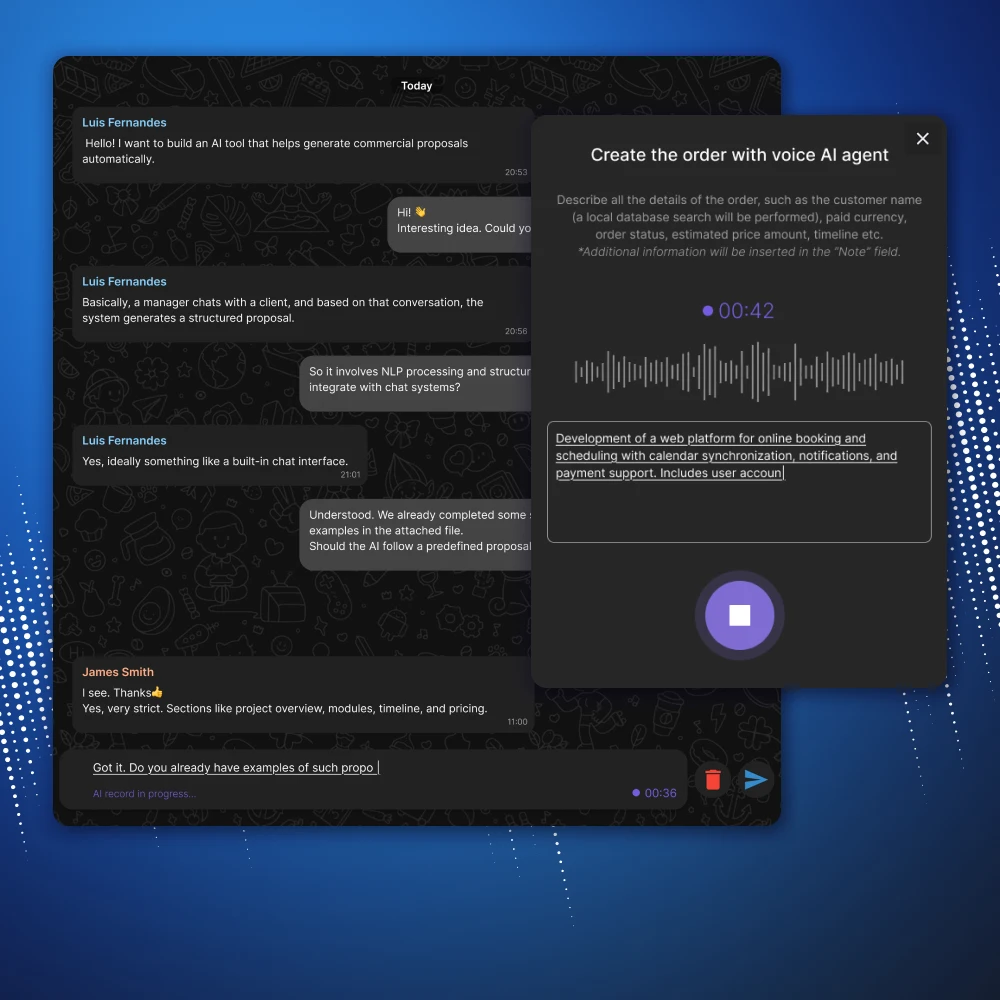

RAG-системы. Компании всё чаще строят внутренние базы знаний на основе LLM: сотрудник задаёт вопрос – система находит нужные документы и формулирует ответ. Качество такого решения зависит не только от того, как модель генерирует текст, но и от того, правильные ли документы она находит. AI / ML QA Engineer тестирует оба компонента и проверяет, что источники соответствуют контексту запроса.

Рекомендательные системы. Стриминговый сервис рекомендует фильмы, маркетплейс – товары, HR-платформа – вакансии. AI / ML QA Engineer проверяет, что рекомендации релевантны, не содержат смещений (bias) и соответствуют бизнес-логике продукта.

Решения на основе компьютерного зрения (computer vision). Модели, которые распознают дефекты на производстве, верифицируют документы или анализируют медицинские снимки, тестируются на точность классификации и устойчивость к изменению условий – освещения, угла съёмки, качества изображения.

Почему стоит нанять AI / ML QA Engineer в CortexIntellect

Специализация на AI, а не адаптация классического QA. Наши специалисты работают именно с AI-системами – они не переносят стандартные QA-практики на ML-продукты, а применяют подходы, разработанные под специфику недетерминированных моделей.

Понимание всего AI-стека. QA Engineer, который не понимает, как устроена модель и на каких данных она обучена, тестирует вслепую. Наши специалисты работают в связке с ML Engineer и Data Engineer и знают, где искать проблемы на каждом уровне системы.

Опыт across разных масштабов и индустрий. Наши специалисты тестировали AI-системы от MVP-продуктов до enterprise-решений с миллионами пользователей – в финтехе, медтехе, e-commerce и SaaS, и понимают, как требования к качеству меняются в зависимости от контекста и нагрузки.

Гибкий формат подключения. Разовое тестирование перед релизом, поддержка на конкретном этапе или долгосрочное сопровождение – формат определяется задачей, а не стандартным пакетом услуг.

Наймите AI / ML QA Engineer для вашего проекта

Свяжитесь с нами – обсудим требования к качеству вашей AI-системы, подберём специалиста под задачу и запустим работу в короткие сроки.

FAQ

-

Чем AI / ML QA отличается от обычного тестирования ПО?

В классическом тестировании ошибка воспроизводима: один и тот же input всегда даёт один и тот же output. В AI-системах поведение модели недетерминировано – результат зависит от данных, контекста и вероятностной природы модели. AI / ML QA Engineer работает с метриками качества, оценочными выборками и специализированными инструментами, которых нет в стандартном QA-процессе.

-

На каком этапе разработки подключать QA Engineer?

Чем раньше, тем лучше. Идеально – на этапе подготовки данных, до начала обучения модели. Это позволяет выявить проблемы с качеством датасета до того, как они повлияют на результат. Если модель уже обучена, QA Engineer подключается перед релизом – но в этом случае часть проблем придётся решать ретроспективно.

-

Как измеряется результат работы QA Engineer?

Результат фиксируется в конкретных метриках: accuracy, hallucination rate, latency, error rate. До начала работы мы согласуем целевые значения этих показателей, а после тестирования предоставляем отчёт с результатами и рекомендациями.

-

Можно ли нанять QA Engineer только на один этап – например, перед релизом?

Да. Специалиста можно подключить точечно: на LLM QA перед запуском, на нагрузочное тестирование или на настройку мониторинга в production. Формат сотрудничества обсуждается под конкретную задачу.

-

Что происходит после запуска системы в production?

Поведение AI-системы меняется по мере изменения входных данных и пользовательских сценариев. QA Engineer настраивает мониторинг, который отслеживает ключевые метрики в реальном времени и сигнализирует о деградации качества до того, как это становится заметно пользователям.