Data Engineer

Что делает Data Engineer

Каждый день в диджитал продуктах появляются тысячи новых записей: пользователи кликают, оформляют заказы, отправляют запросы, системы пишут логи – всё это оседает в базах, файлах и очередях сообщений и не приносит никакой пользы до тех пор, пока нет системы, которая собирает эти данные, очищает их и доставляет туда, где они нужны.

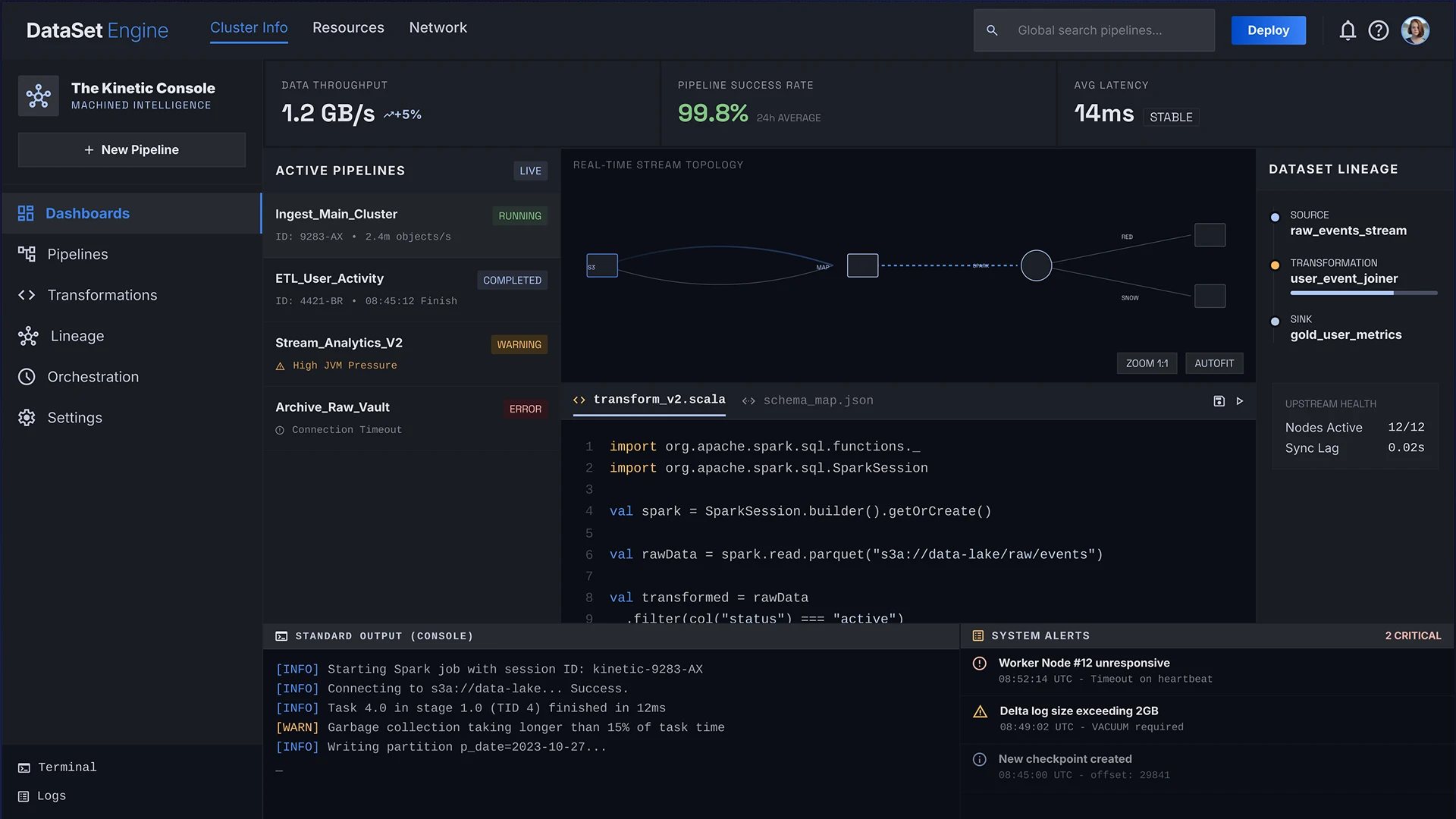

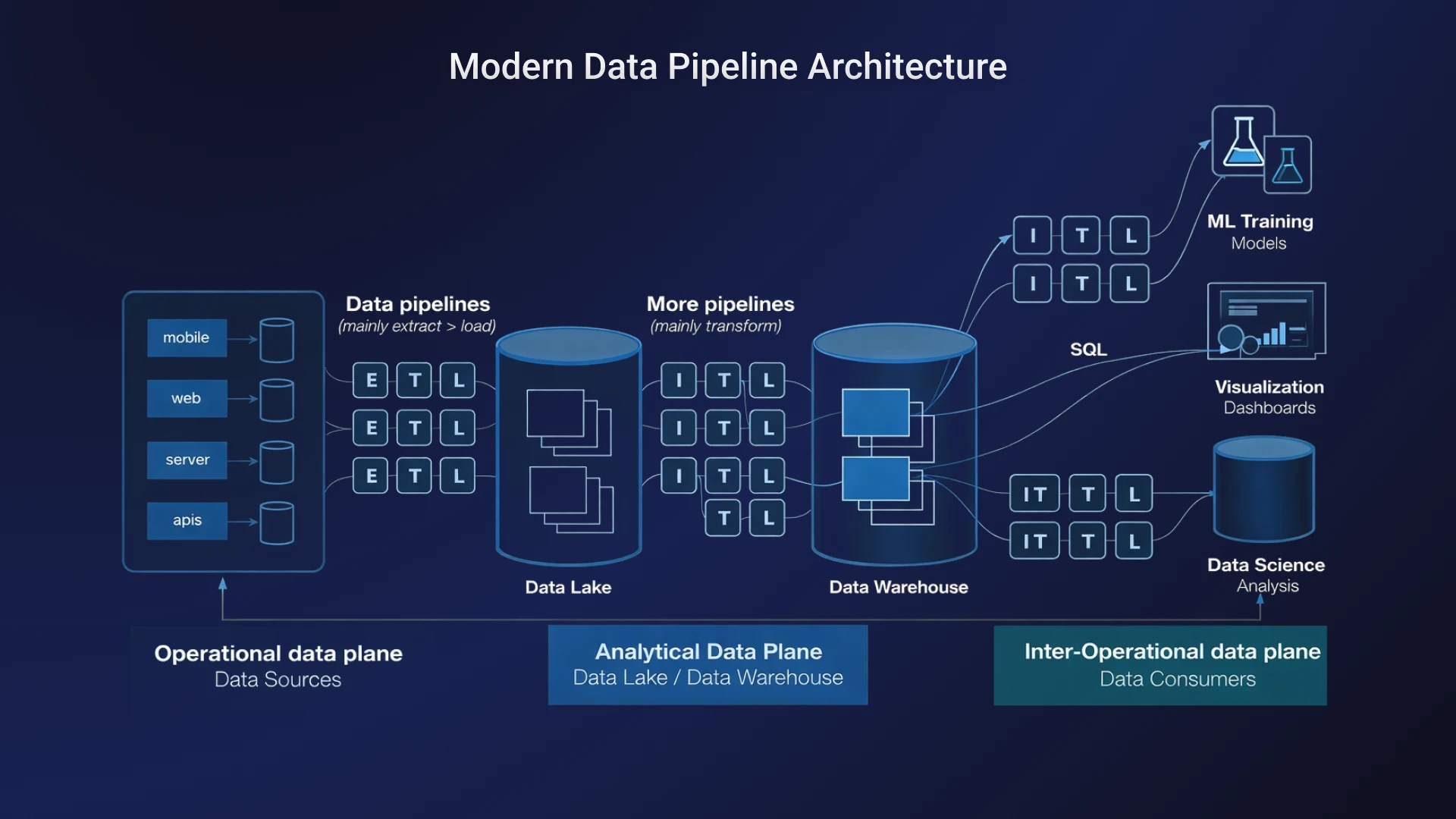

Этим занимается Data Engineer: он разрабатывает автоматические конвейеры (data pipelines) для сбора, преобразования и хранения данных из разрозненных источников и обеспечивает их доступность для аналитических систем, моделей машинного обучения (ML-моделей) и AI-приложений.

В цепочке разработки AI-систем Data Engineer стоит первым: он собирает и готовит данные, которые затем размечает Data Annotator, использует ML Engineer для обучения моделей, а AI Developer для создания готовых AI-приложений. Без Data Engineer эта цепочка просто не запускается.

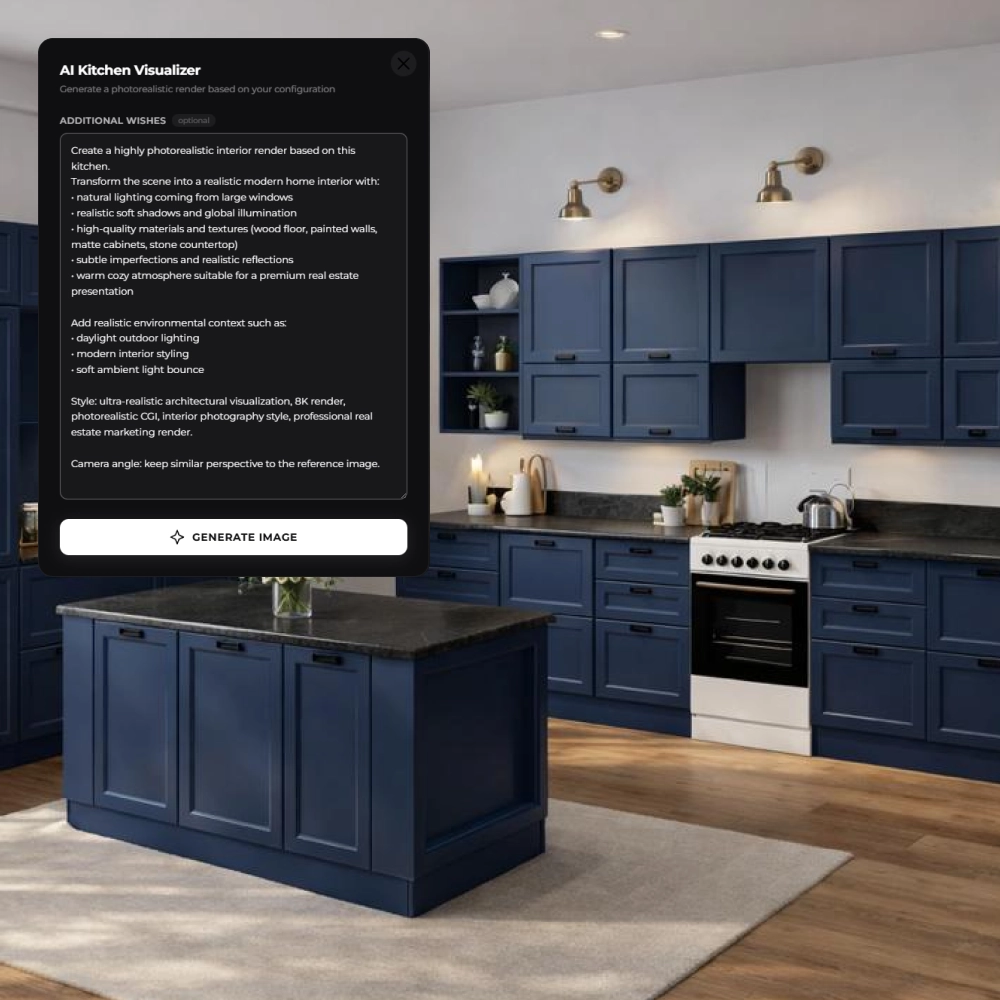

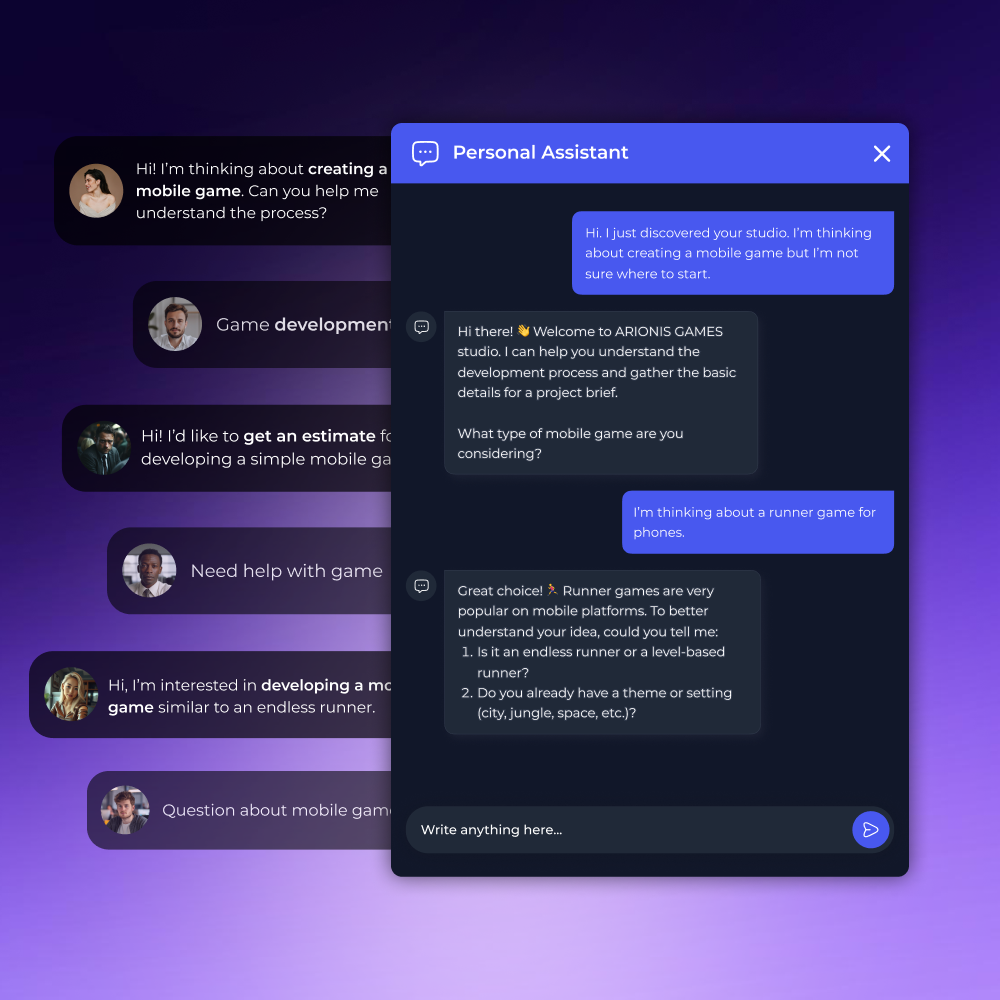

Выберите разработчика

Конвейер обработки данных

Data Engineer работает с данными на каждом этапе их жизненного цикла – от момента появления до момента, когда они готовы к использованию. Вот как устроен этот путь.

Сбор данных (Data Collection). Данные редко живут в одном месте: они поступают из программных интерфейсов (API) внешних сервисов, реляционных и нереляционных (NoSQL) баз данных, лог-систем и стриминговых платформ, и задача Data Engineer – определить все эти источники, настроить коннекторы и обеспечить регулярный сбор без потерь.

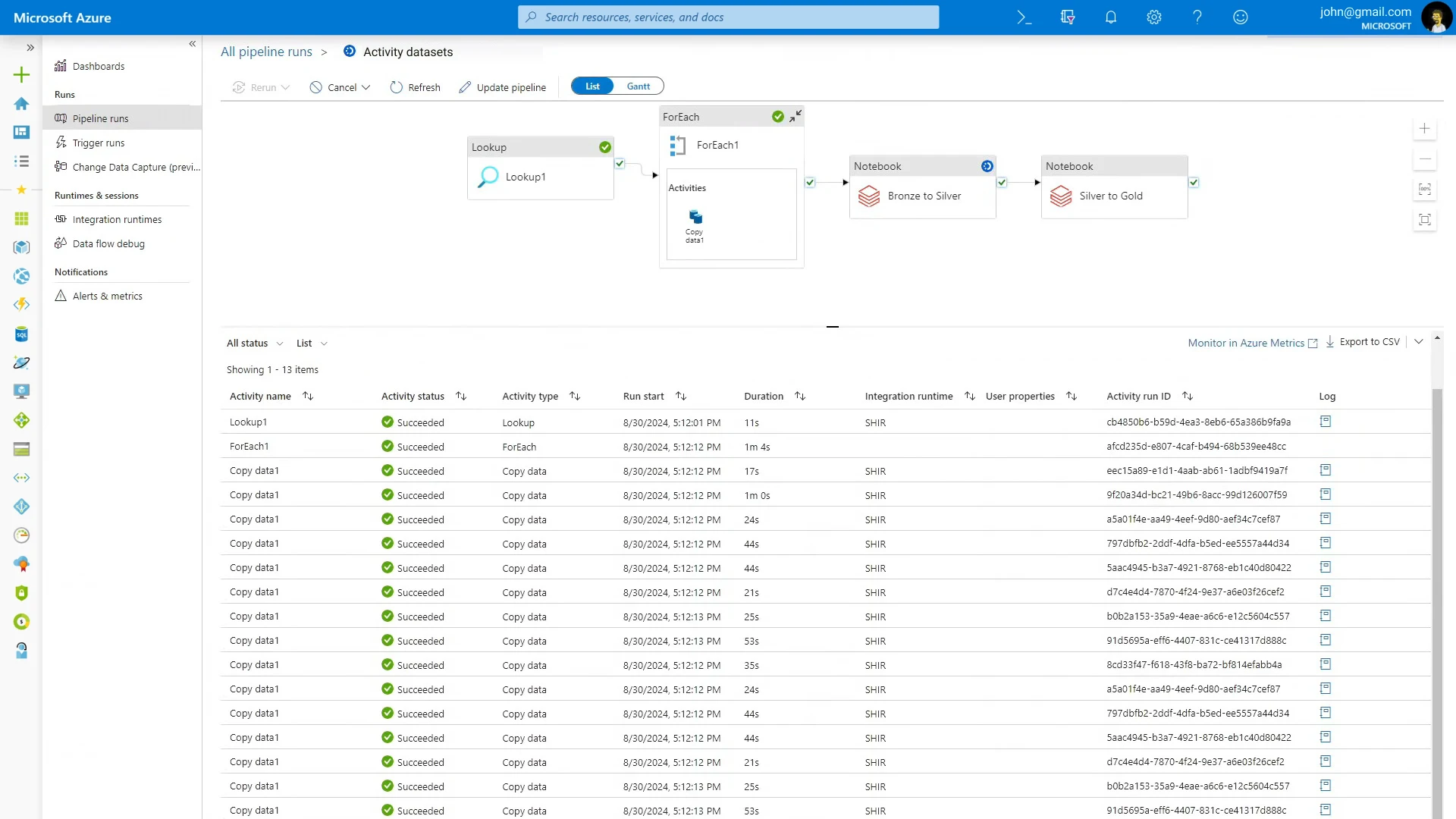

Загрузка данных (Data Ingestion). Собранные данные передаются в систему обработки по одному из двух сценариев: пакетная загрузка по расписанию (batch-обработка), когда данные накапливаются и обрабатываются порциями, или потоковая загрузка (streaming ingestion) в реальном времени, когда каждое событие обрабатывается по мере поступления. Data Engineer выбирает подходящую модель исходя из требований проекта.

Обработка данных (Data Processing). Сырые данные почти никогда не пригодны для прямого использования: на этом этапе убираются дубликаты и ошибки, форматы приводятся к единому стандарту, данные обогащаются из смежных источников и преобразуются в структуры, удобные для анализа.

Хранение данных (Data Storage). Обработанные данные размещаются в хранилищах, оптимизированных под конкретные задачи: озёра данных (data lakes) подходят для больших объёмов сырых и полуструктурированных данных, хранилища данных – для структурированных данных и аналитических запросов. Data Engineer проектирует схемы хранения с учётом скорости доступа, стоимости и масштабируемости.

Доставка данных (Data Delivery). Финальный этап – привести данные к формату, пригодному для конкретного потребителя. Data Engineer формирует готовые наборы данных, настраивает API доступа и следит за тем, чтобы данные оставались актуальными.

Ключевые задачи Data Engineer

Вот что входит в зону ответственности Data Engineer на проекте.

Разработка ETL-конвейеров.

Data Engineer настраивает автоматическое извлечение данных из источников, их трансформацию по заданным правилам и загрузку в целевые хранилища по расписанию или в режиме реального времени.

Обработка big data.

Когда речь идёт о терабайтах и петабайтах, Data Engineer проектирует распределённые вычисления на Apache Spark и PySpark, оптимизирует запросы и управляет ресурсами кластеров так, чтобы система справлялась с нагрузкой без потери производительности.

Интеграция источников данных.

Data Engineer подключает к единому потоку реляционные базы (PostgreSQL, MySQL), нереляционные хранилища (NoSQL: MongoDB, Cassandra), внешние API, очереди сообщений и агрегаторы логов.

Подготовка training datasets.

Data Engineer формирует обучающие выборки нужного объёма и качества, работает в связке с Data Annotator и обеспечивает их регулярное обновление по мере накопления новых данных.

Проектирование data lakes и data warehouses.

Data Engineer проектирует схему хранения, управляет разбивкой данных на разделы, контролирует их качество и настраивает права доступа.

Оптимизация обработки данных.

Data Engineer анализирует узкие места, перепроектирует схемы и внедряет кэширование и инкрементальную обработку там, где это сокращает время доставки данных и снижает вычислительные затраты.

Технологии, с которыми работает Data Engineer

Стек Data Engineer – один из самых широких среди технических специалистов. Вот что обычно входит в арсенал инженера данных:

Языки программирования:

- Python – основной язык для работы с данными;

- SQL – для работы с реляционными хранилищами и аналитическими запросами;

- Java и Scala – для высоконагруженных компонентов на Apache Spark.

Инструменты обработки данных:

- Apache Spark и PySpark обеспечивают распределённую обработку больших объёмов данных;

- Pandas – гибкий инструмент для преобразования данных в аналитических задачах.

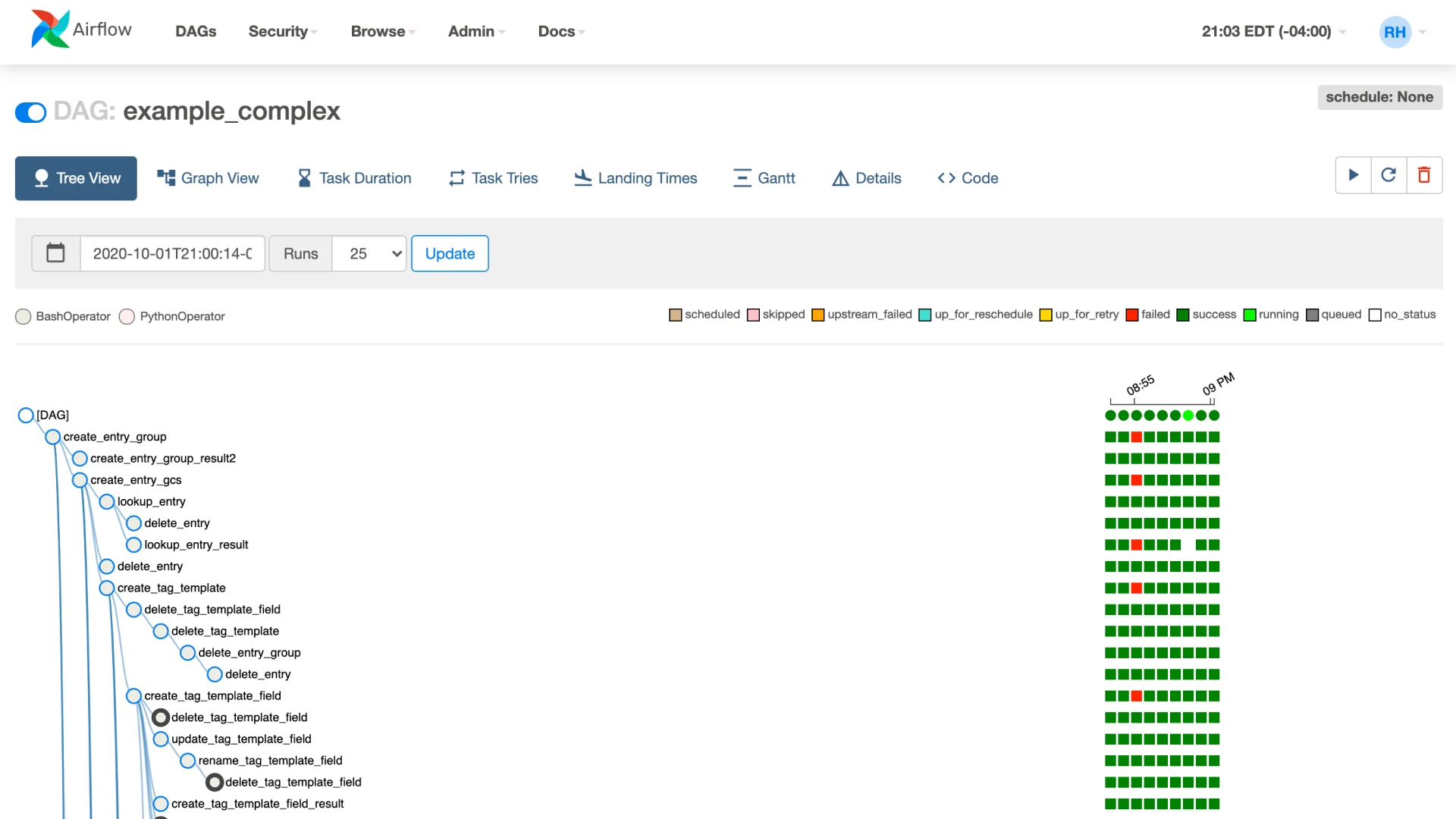

Оркестрация конвейеров (pipeline orchestration):

Apache Airflow и Prefect позволяют описывать зависимости между задачами, управлять расписанием и мониторить выполнение сложных многошаговых процессов – так, чтобы сбой в одном месте не ронял всю систему.

Потоковая передача данных (data streaming):

Apache Kafka обеспечивает надёжную передачу событий в реальном времени между компонентами системы с высокой пропускной способностью и минимальными задержками.

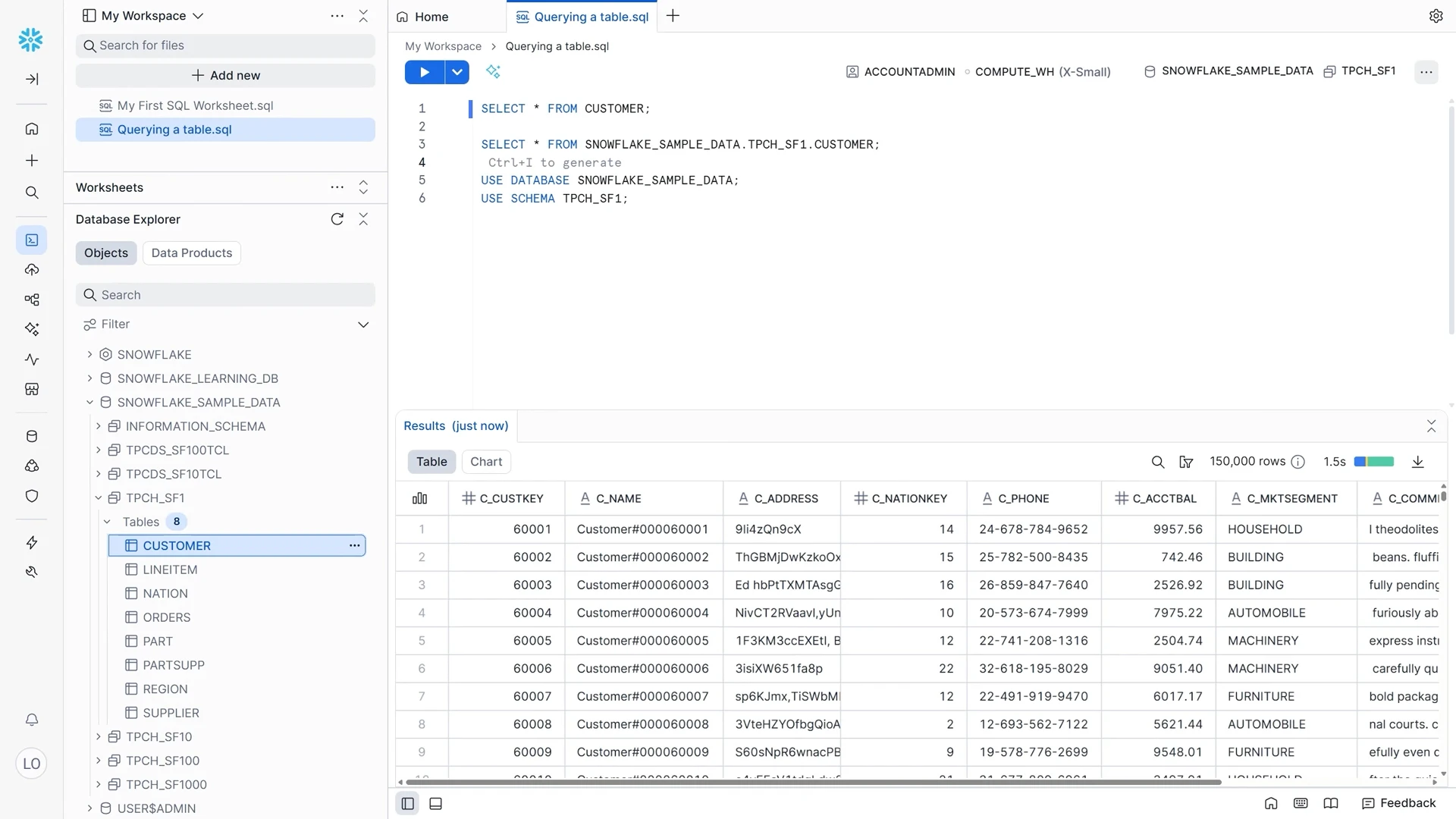

Хранение данных (data storage):

- Snowflake, BigQuery и Amazon Redshift – облачные хранилища данных для масштабируемых аналитических запросов.

- Data lakes используются для хранения сырых данных в исходном формате – до их обработки и структурирования.

Где применяется data engineering

Data engineering лежит в основе большинства продуктов, которые работают с данными в промышленных масштабах. Вот несколько примеров того, как это выглядит на практике.

Аналитические платформы. Такие компании, как Uber или Airbnb, обрабатывают миллиарды событий в день – сессии, действия, конверсии, геолокации. Data Engineer строит pipeline, который агрегирует эти данные из множества точек касания и поставляет их в дашборды в актуальном состоянии, без ручного экспорта и задержек.

Машинное обучение. Когда Spotify обучает модели для персональных плейлистов или Tesla – для автопилота, в основе лежат терабайты подготовленных данных. Data Engineer формирует training datasets нужного объёма, очищает их от шума и выстраивает процесс регулярного обновления выборок по мере поступления новых данных.

Рекомендательные системы. Netflix и Amazon строят свои рекомендации на потоковой обработке пользовательских действий в реальном времени. Data Engineer создаёт streaming pipelines, которые захватывают события – просмотры, клики, покупки – и передают их в рекомендательный движок с минимальной задержкой.

Маркетинговая аналитика. Крупные ритейлеры вроде Zalando или ASOS управляют десятками рекламных каналов одновременно. Data Engineer сводит данные из платного трафика, социальных сетей, email и партнёрских программ в единую модель атрибуции и обеспечивает единую точку доступа ко всей маркетинговой статистике.

Почему стоит нанять Data Engineers в CortexIntellect

Опыт разработки data pipelines. Мы проектируем как batch-, так и streaming-конвейеры и выбираем архитектуру под конкретные требования к нагрузке и задержкам.

Экспертиза в AI и ML-проектах. Наши специалисты понимают, какие данные нужны модели и в каком формате, и готовят их без итерационных согласований с командой.

Современный технологический стек. Apache Spark, Airflow, Kafka, Snowflake, BigQuery, AWS, GCP, Azure – мы работаем с инструментами, которые используют технологические компании уровня enterprise.

Опыт работы с большими данными. Мы успешно реализовывали проекты, где объём данных измеряется терабайтами, а pipeline должен справляться с пиковой нагрузкой без потери производительности.

Гибкая модель сотрудничества. Специалиста можно подключить на разовую задачу, конкретный этап проекта или долгосрочное сопровождение инфраструктуры данных.

Наймите Data Engineer для вашего проекта

Свяжитесь с нами – обсудим архитектуру данных, подберём специалиста под задачу и запустим работу в короткие сроки.

FAQ

-

Сколько времени занимает подключение Data Engineer к проекту?

Специалиста можно подключить в короткие сроки: после первичной консультации мы подбираем инженера под задачу и согласовываем старт. В большинстве случаев работа начинается в течение нескольких дней с момента обращения.

-

На каком этапе развития продукта нужен Data Engineer?

Чем раньше, тем лучше. Если в продукте уже накапливаются данные из нескольких источников, но единой системы их сбора и обработки нет – это сигнал, что Data Engineer нужен сейчас. Откладывать найм до появления ML-команды или аналитики не стоит: без готовой инфраструктуры их работа просто не запустится.

-

В чём разница между разовой задачей и долгосрочным сотрудничеством?

Разовый формат подходит для конкретного результата: настроить pipeline, спроектировать data warehouse, провести аудит существующей инфраструктуры. Долгосрочное сопровождение – для компаний, которым важно, чтобы инфраструктура данных развивалась вместе с продуктом и не требовала отдельного поиска специалиста при каждом новом запросе.

-

Справится ли специалист с нашим объёмом данных?

Наши инженеры работают с объёмами на уровне терабайтов и проектируют системы, рассчитанные на пиковую нагрузку. Архитектура подбирается под конкретные параметры проекта – скорость доставки данных, частота обновлений, требования к масштабируемости.

-

Нужно ли нам самим разбираться в стеке технологий, чтобы поставить задачу?

Нет. Для старта достаточно описать бизнес-задачу: откуда берутся данные, кто и как их использует, какой результат нужен на выходе. Выбор инструментов и архитектурные решения – зона ответственности инженера. Первичная консультация как раз для этого и нужна.