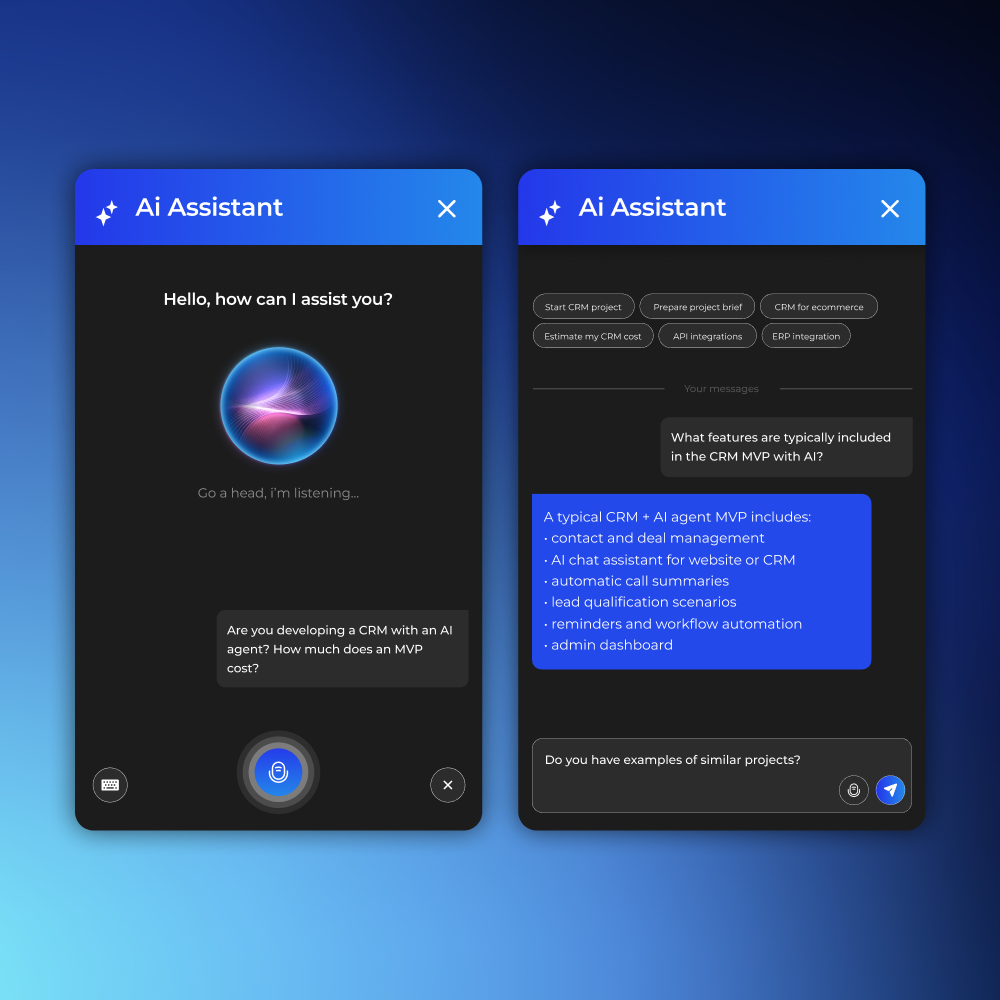

Сегодня AI-ассистенты, AI-компаньоны, голосовые помощники и AI-чаты создаются значительно быстрее, чем еще несколько лет назад. Благодаря AI-assisted development и так называемому vibe coding команды могут запускать MVP буквально за недели. Но вместе с этим появилась новая проблема: большинство таких продуктов тестируются по старым QA-подходам, которые уже не покрывают реальные риски AI-систем.

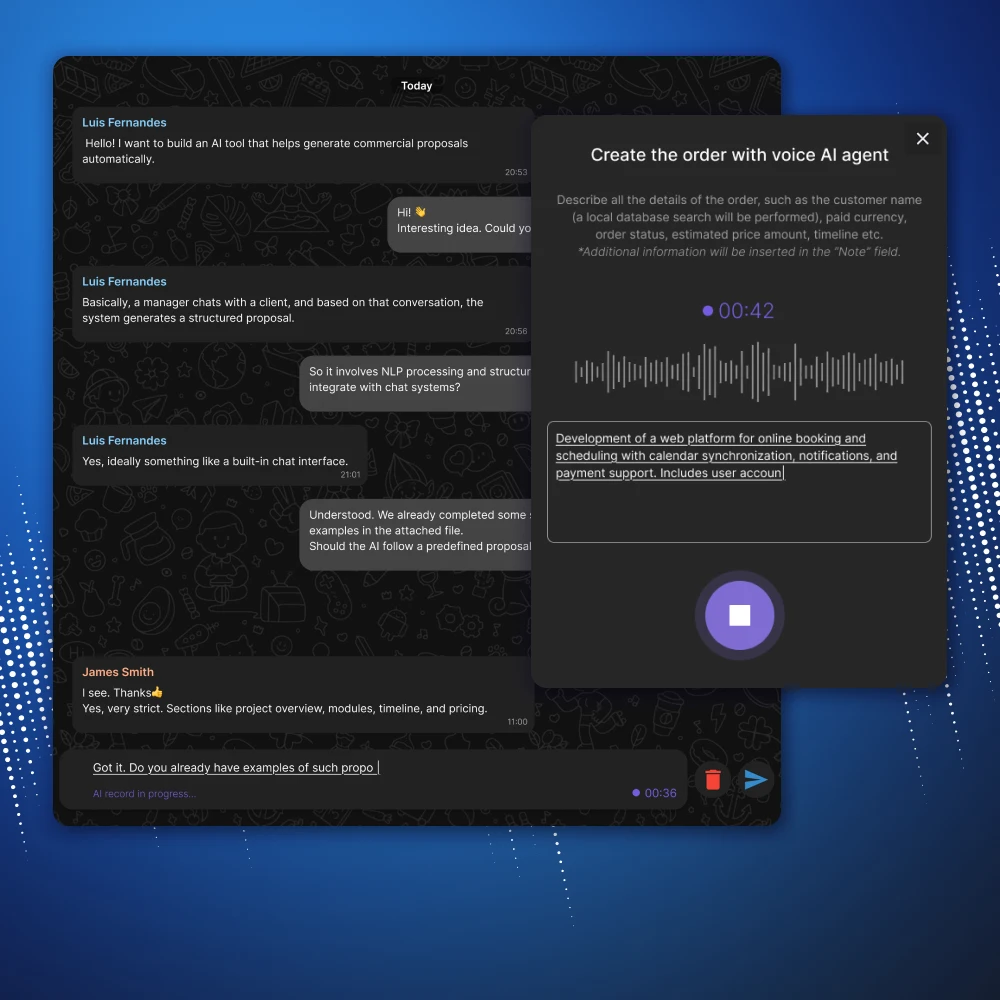

Если раньше достаточно было проверить формы, API и базовые пользовательские сценарии, то теперь необходимо тестировать контекст диалога, эмоциональное восприятие, голосовое взаимодействие, стабильность AI-ответов и даже ощущение «живого общения». В AI-продуктах пользователь оценивает не только техническую стабильность, но и то, насколько комфортно и естественно с ним взаимодействует система.

В этой статье рассмотрим практический чек-лист тестирования AI-чата и голосового AI-ассистента, а также основные проблемы, которые чаще всего возникают в подобных продуктах.

Почему AI-приложения требуют нового подхода к QA

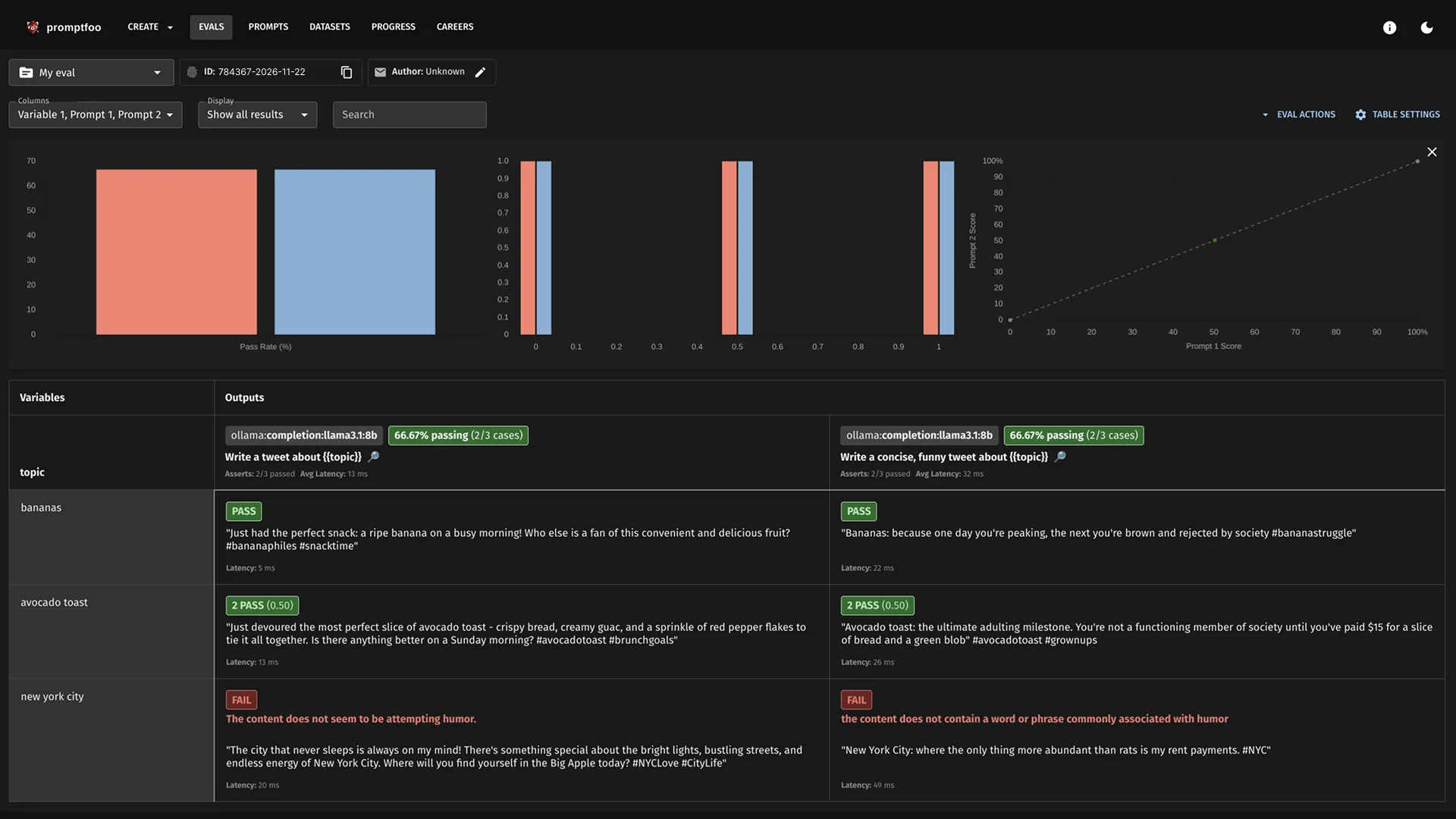

Главная особенность AI-продуктов — их поведение не всегда полностью детерминировано. Даже при одинаковых условиях AI может отвечать немного по-разному, менять формулировки, терять контекст или неожиданно уходить от темы.

Из-за этого классического тестирования уже недостаточно.

Теперь QA-команде приходится проверять:

- качество и адекватность AI-ответов;

- удержание контекста диалога;

- эмоциональное восприятие;

- скорость реакции AI;

- стабильность voice/chat interaction;

- поведение при плохом интернете;

- работу длинных диалогов;

- реакцию на агрессивные, эмоциональные или нестандартные сообщения.

Фактически современное тестирование AI-приложений — это уже смесь:

- QA,

- UX,

- conversational design,

- нагрузочного тестирования,

- психологии взаимодействия,

- AI behavior testing.

Что необходимо тестировать в AI-чате

Регистрация и быстрый старт

Для AI-продуктов критически важно минимизировать трение на старте. Пользователь должен максимально быстро попасть в диалог с AI. Поэтому необходимо проверять:

- email login / Google login / Apple login;

- восстановление доступа;

- корректность ошибок;

- адаптацию форм на мобильных устройствах.

Но технической проверки здесь недостаточно. Нужно оценивать и UX:

- не слишком ли длинный onboarding;

- не возникает ли ощущения сложности;

- хочется ли продолжить использование;

- нет ли лишних шагов перед началом общения.

Для AI-приложений «скорость начала разговора» напрямую влияет на удержание пользователей.

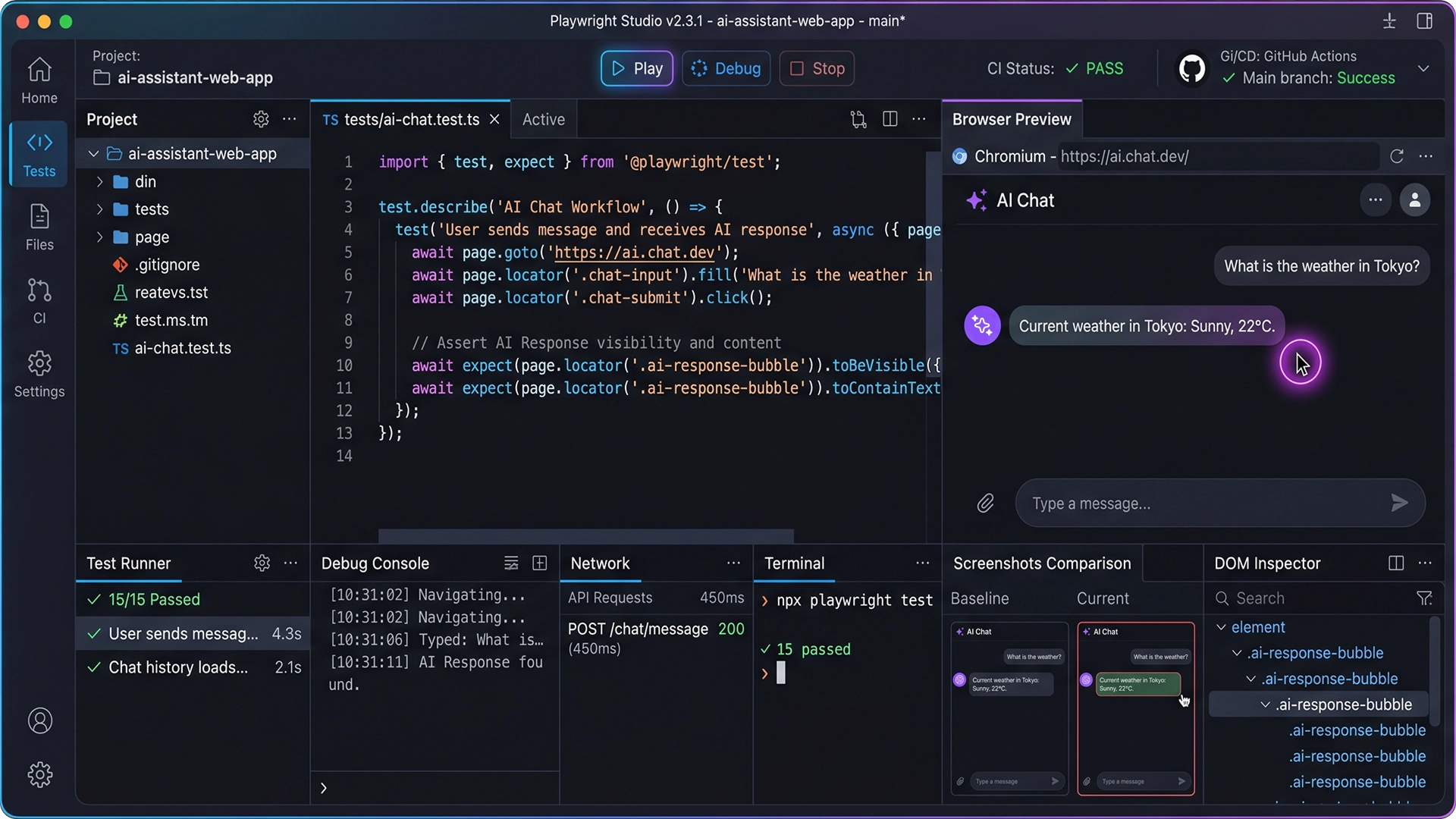

Проверка AI-ответов

Это уже одна из самых сложных частей тестирования. AI необходимо проверять не только на корректность, но и на качество взаимодействия.

Важно анализировать:

- отвечает ли AI по теме;

- удерживает ли контекст;

- не повторяется ли;

- не генерирует ли токсичные ответы;

- не превращается ли диалог в «роботизированный»;

- задает ли AI уточняющие вопросы;

- не пишет ли слишком длинные ответы;

- не смешивает ли языки;

- не генерирует ли бессмысленный текст или набор символов.

Очень часто AI-система выглядит стабильной технически, но полностью проваливается именно на уровне восприятия общения.

Особенно это критично для:

- AI-компаньонов;

- AI-консультантов;

- AI-психологов;

- voice assistants;

- AI support systems.

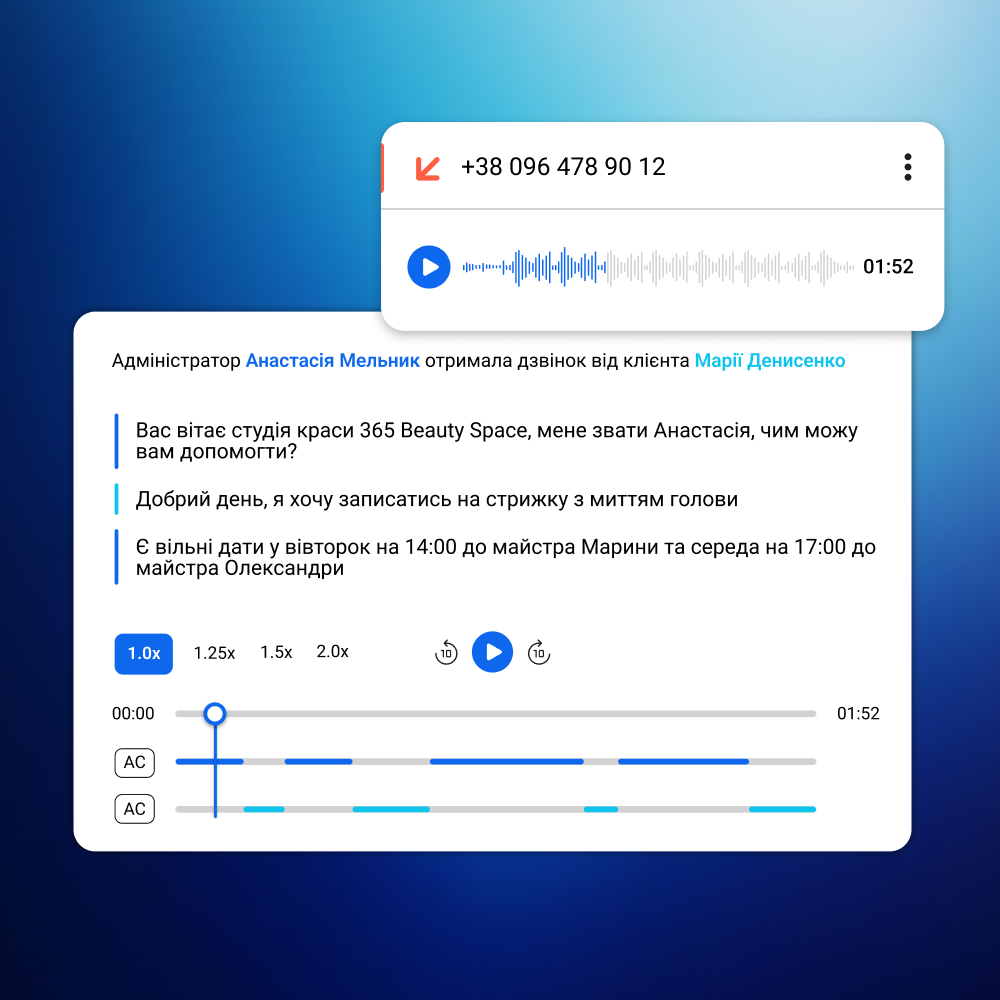

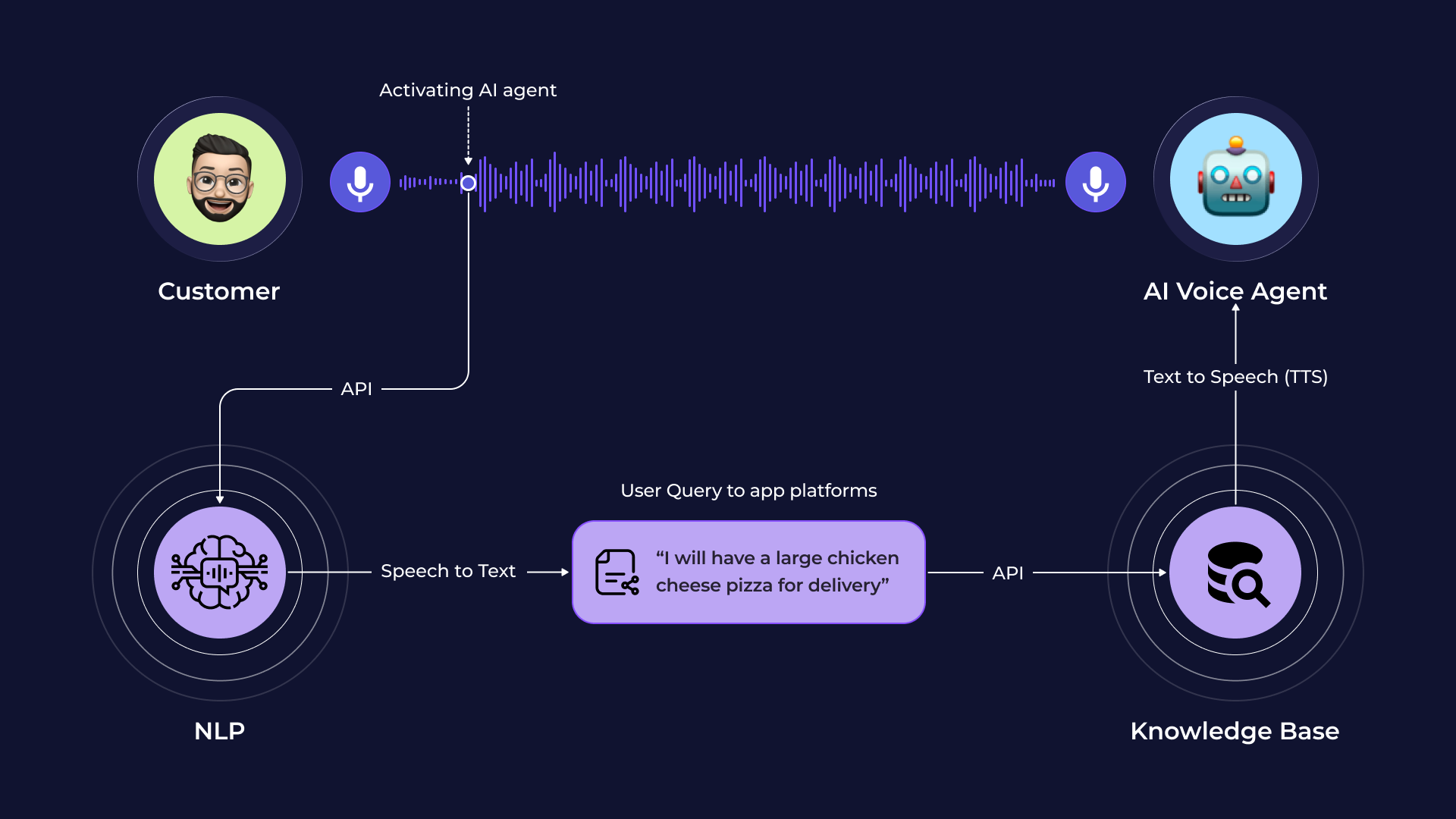

Голосовое взаимодействие

Voice AI сегодня — отдельная категория сложного тестирования. Даже если текстовый чат работает идеально, голосовой режим может создавать огромное количество проблем:

- роботизированное звучание;

- задержки между репликами;

- плохая синхронизация губ у аватара;

- ошибки распознавания речи;

- неправильные акценты;

- обрывы аудио;

- резкие скачки громкости;

- потеря микрофона;

- проблемы при переключении сети.

Особенно важно проверять ощущение естественности общения.

Пользователь очень быстро замечает:

- неестественные паузы;

- слишком «машинный» голос;

- странные интонации;

- эмоционально неподходящие реакции.

Именно такие мелочи часто ломают доверие к продукту сильнее, чем обычные баги интерфейса.

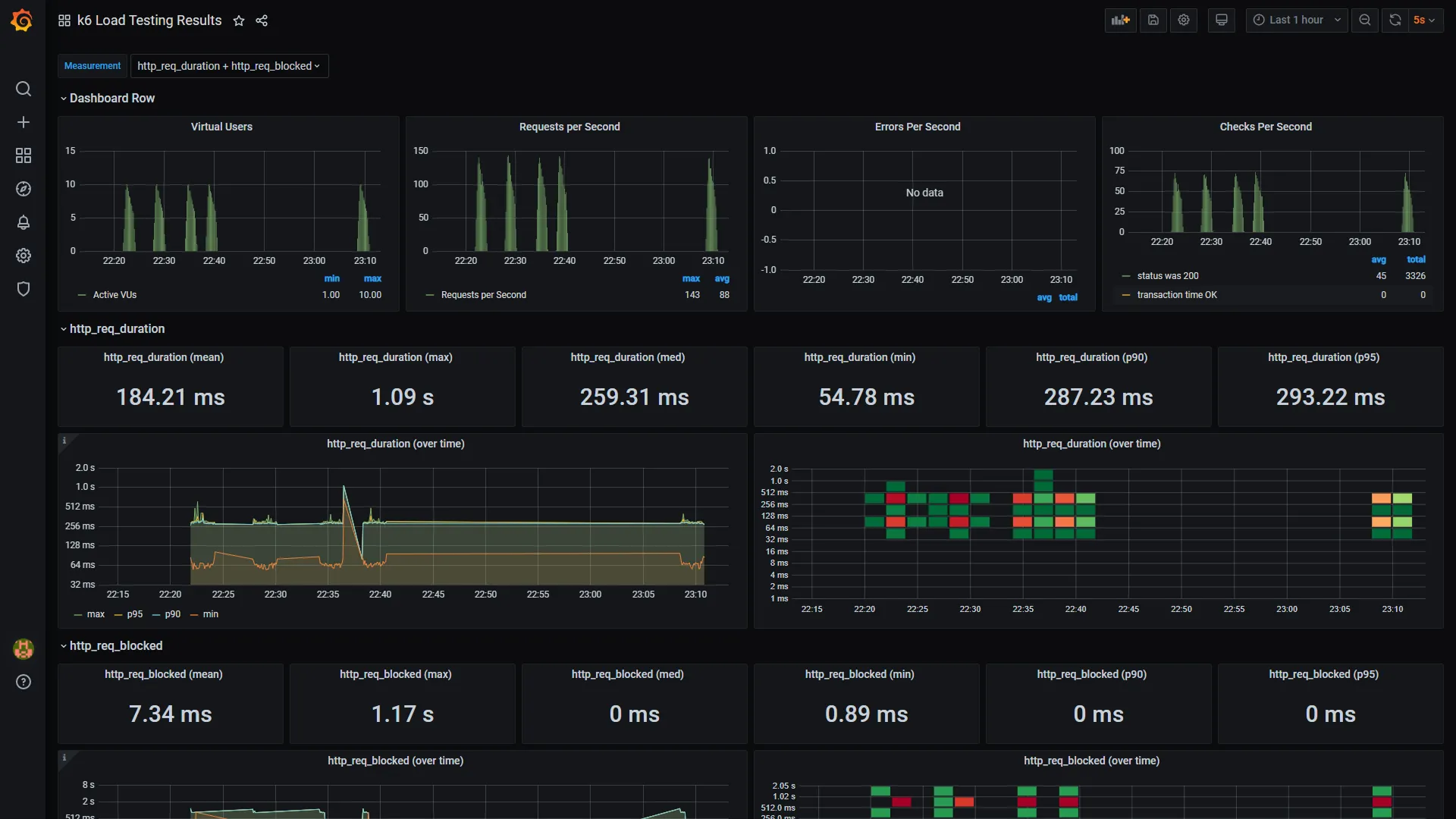

Edge-case тестирование AI-приложений

Одна из главных ошибок современных команд — тестировать только «идеальные сценарии». AI-продукты обязательно нужно проверять в нестандартных условиях.

Например:

- плохой интернет;

- резкое переключение между страницами;

- длинные сообщения;

- поток сообщений подряд;

- emoji;

- copy-paste больших текстов;

- эмоциональные сообщения;

- агрессивные сообщения;

- пустые сообщения;

- переключение между Wi-Fi и мобильной сетью.

Именно здесь чаще всего появляются:

- потеря контекста;

- зависания;

- дублирование сообщений;

- бесконечный loading;

- потеря истории чата;

- ошибки voice mode.

UX-проблемы AI-систем

В AI-продуктах UX стал значительно важнее, чем в обычных веб-сервисах. Даже мелкие проблемы могут разрушать ощущение «живого общения».

Необходимо проверять:

- не прыгает ли чат;

- не перекрывает ли клавиатура поле ввода;

- нет ли лагов при генерации;

- не мигает ли интерфейс;

- корректно ли работают кнопки;

- не ломается ли мобильная адаптация;

- нет ли горизонтального скролла;

- удобно ли вести длинный диалог.

AI-система должна восприниматься спокойно, плавно и естественно.

Любой раздражающий UX начинает усиливаться в несколько раз, когда пользователь находится в длинном диалоге.

Самая недооцененная часть — эмоциональное тестирование

Современные AI-ассистенты проверяются уже не только технически. Возникает новый тип QA — эмоциональное тестирование.

Команда должна задавать себе вопросы:

- хочется ли продолжить общение;

- вызывает ли AI доверие;

- не раздражают ли ответы;

- создается ли ощущение поддержки;

- чувствуется ли «живость» диалога;

- не становится ли AI навязчивым;

- помогает ли интерфейс расслабиться;

- не перегружает ли система пользователя.

Это особенно важно для:

- AI companions;

- AI therapy-like products;

- wellness AI apps;

- support assistants;

- conversational AI systems.

Фактически современные AI-продукты уже тестируются не только как software, но и как форма пользовательского опыта.

Какие ошибки считаются критическими

Для AI voice/chat систем критическими считаются:

- белый экран;

- вылеты;

- зависания;

- бесконечная загрузка;

- AI не отвечает;

- потеря истории;

- ошибки оплаты;

- сбои voice mode;

- токсичные ответы AI;

- потеря контекста диалога.

Причем токсичный или эмоционально неправильный ответ AI сегодня может быть даже опаснее обычного технического бага.

Почему AI QA станет отдельным направлением индустрии

С ростом AI-assisted development рынок столкнется с огромным количеством AI-generated приложений.

Создавать MVP становится проще. Но качество таких продуктов теперь определяется уже не только кодом.

Главный вопрос меняется: насколько естественно, стабильно и безопасно AI взаимодействует с человеком?

Именно поэтому AI QA постепенно превращается в отдельную специализацию, объединяющую:

- классическое тестирование,

- UX,

- behavioral analysis,

- conversational design,

- AI safety,

- эмоциональное восприятие интерфейсов.

И ближайшие годы спрос на подобное тестирование будет только расти.

Полезные ссылки и материалы

- AI/ML QA Engineer — тестирование AI и ML-систем

- Разработка AI-ассистентов

- Разработка AI Telegram-ботов

- Тестирование мобильных приложений: методы и особенности

- High-Load тестирование после Vibe Coding

- Тестирование программного обеспечения после Vibe Coding

- Все, что нужно знать про тестирование ПО: уровни, типы, этапы и методы