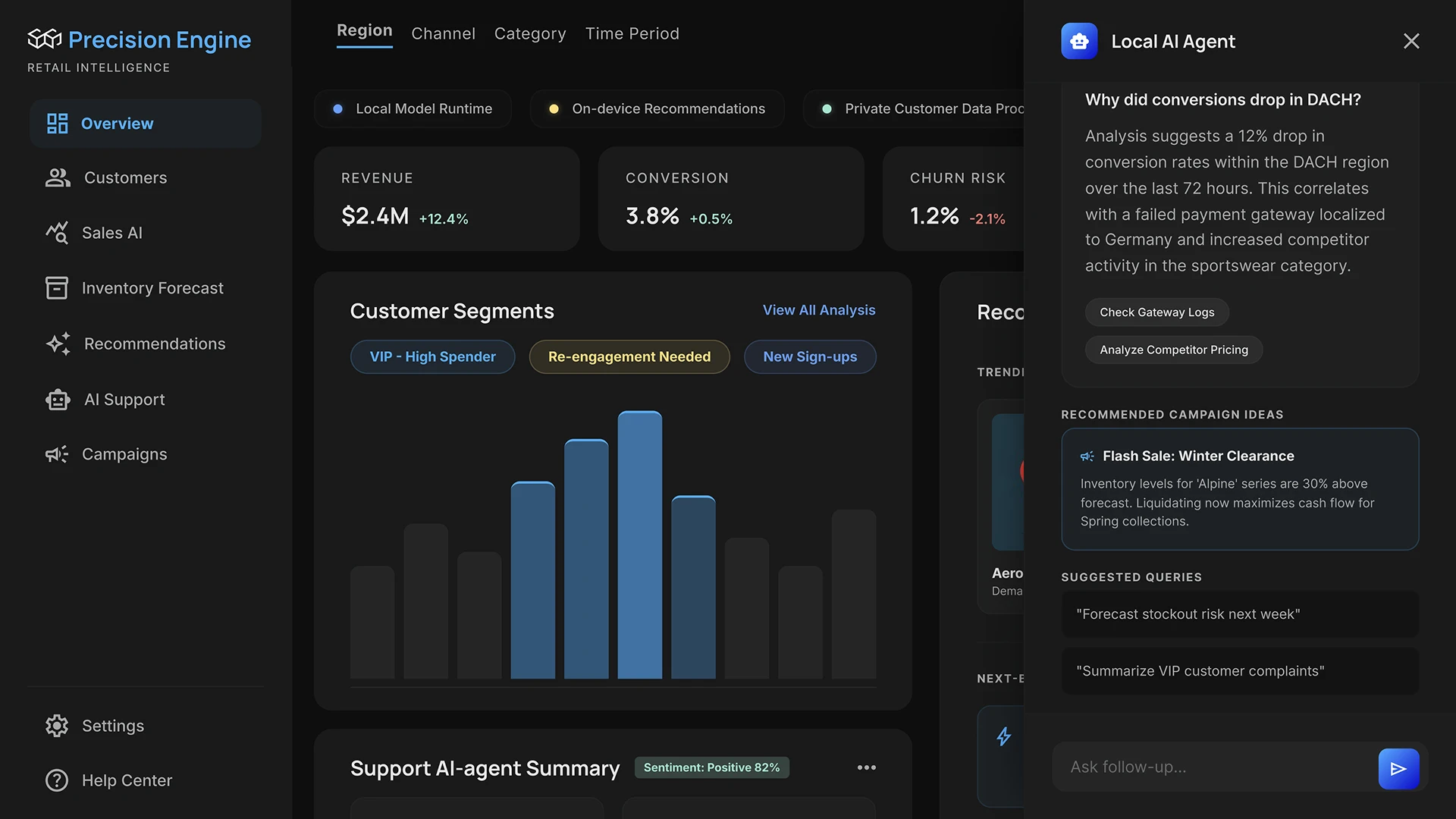

Компанії все активніше впроваджують AI у робочі процеси: обробка документів, аналіз даних, внутрішні помічники, автоматизація підтримки. Але при роботі з даними реальних людей та іншою чутливою інформацією виникає питання, яке не прийнято ставити вголос: куди саме вона йде?

Коли співробітник ставить питання GPT-4 про клієнтський договір або відправляє у хмару фрагменти внутрішньої звітності, дані залишають периметр компанії. Хмарні моделі зберігають запити, використовують для поліпшення систем, підпорядковуються юрисдикції країни розміщення серверів. Для бізнесу, що працює з персональними даними, фінансовою інформацією чи комерційною таємницею, це не абстрактний ризик – це пряме порушення безпекових політик або регуляторних вимог.

Водночас хмарний AI може стати дорогим при регулярному використанні. Сотні тисяч токенів на місяць на команду – це вже відчутні витрати без чіткого контролю за тим, що саме тарифікується.

Звідси і виростає запит, який ми бачимо все частіше: потрібний локальний AI.

Чому компанії переходять на локальний AI

Перехід до локальних рішень – це бізнес-рішення, яке спирається на кілька конкретних причин.

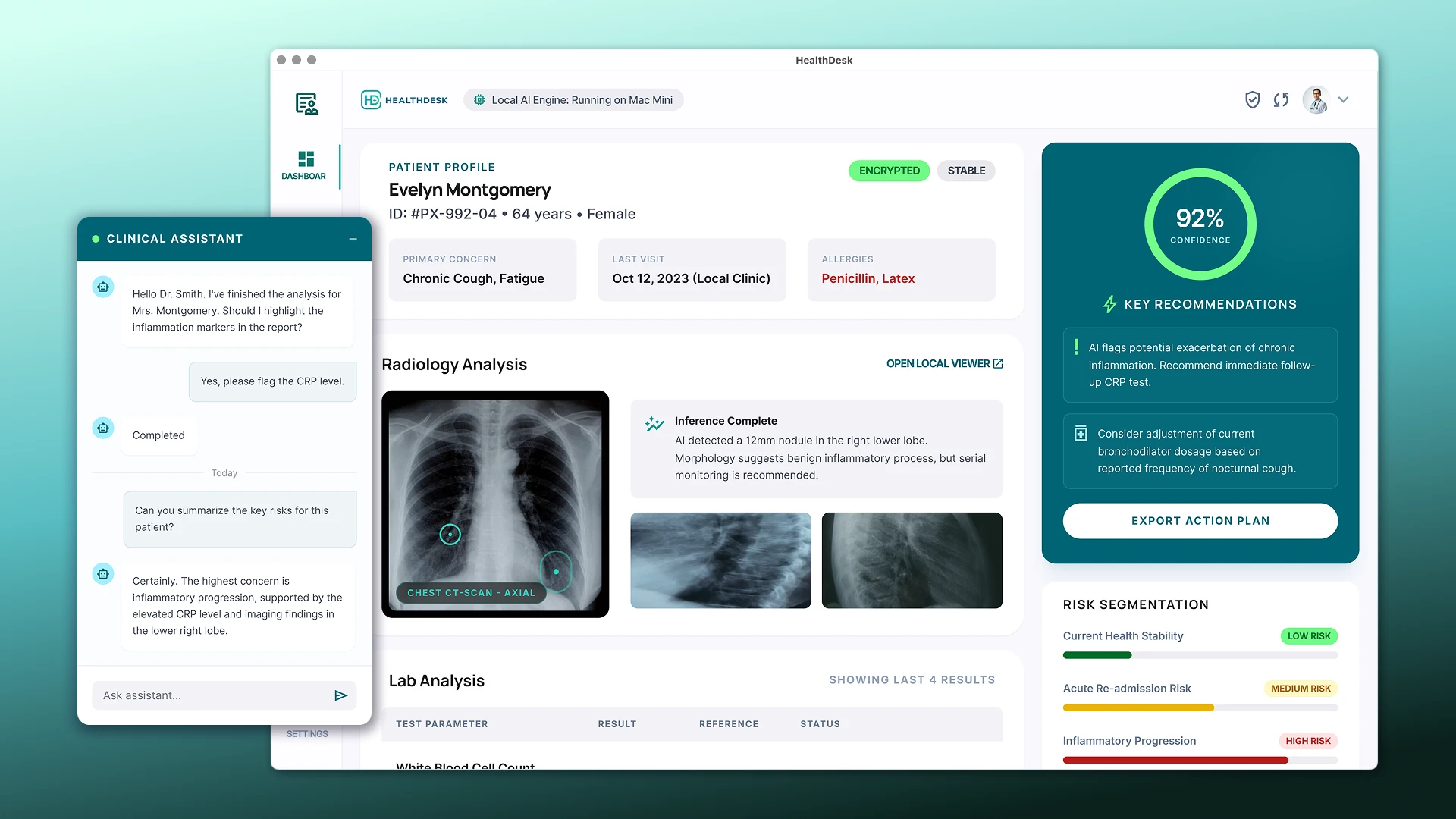

- Конфіденційність даних. Внутрішні документи, переговори, клієнтська база – це має залишатися всередині. Локальна модель не надсилає запити на зовнішні сервери: вона працює з даними там, де вони зберігаються.

- Робота із корпоративним контекстом. Хмарна модель не знає нічого про вашу компанію: ні про продукти, ні про процеси, ні про внутрішню документацію. Локальна система ж будується поверх ваших даних та відповідає саме на ваші запитання.

- Зниження операційних витрат. Фіксована вартість обладнання проти наростаючих хмарних витрат.

- Контроль за системою. Ви визначаєте, яка модель використовується, як вона налаштована, які дані до неї підключено, хто має доступ. Жодних змін умов використання, жодних раптових оновлень поведінки моделі.

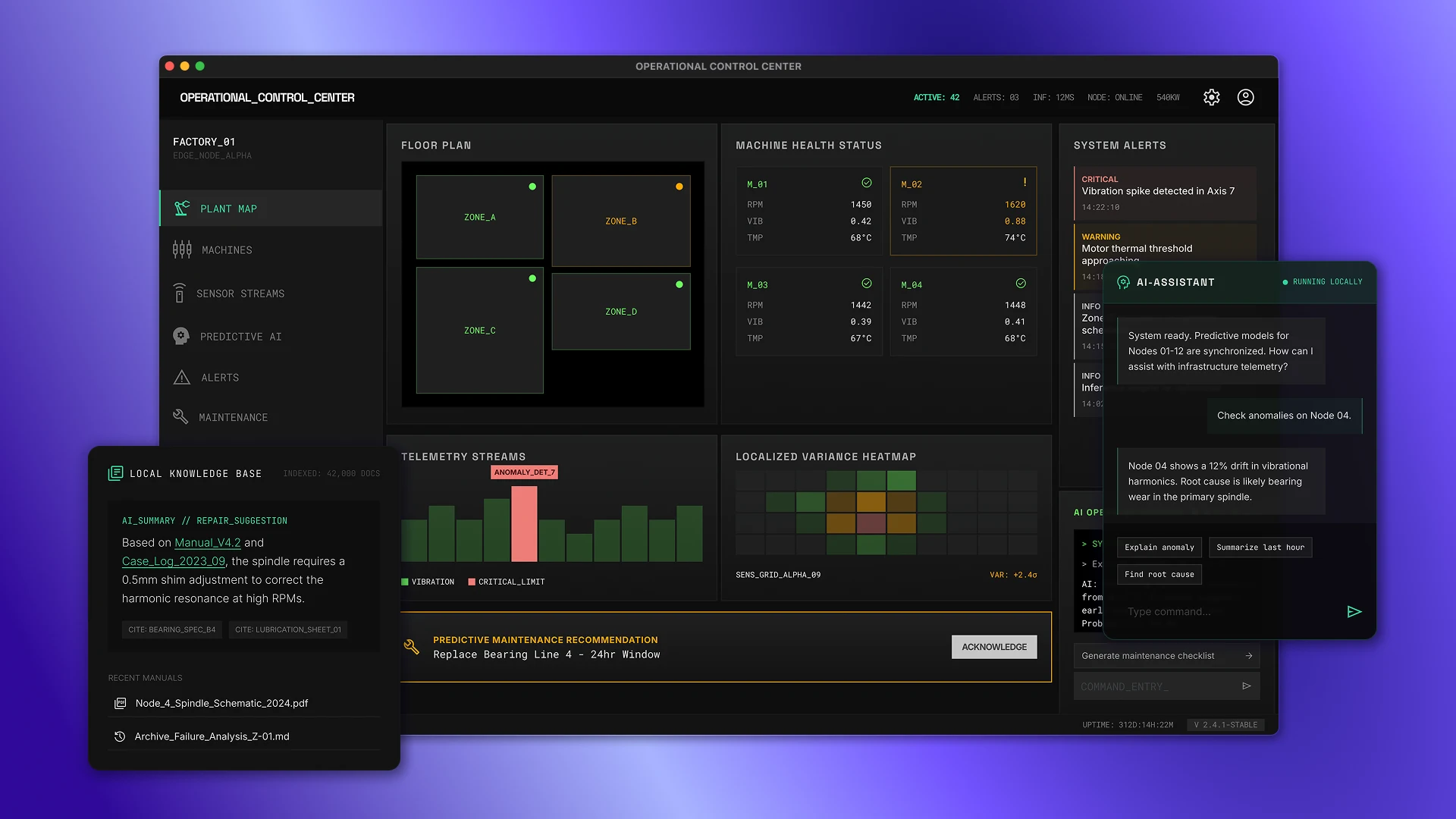

Практично це виглядає так: компанія підключає до локальної AI-системи CRM, базу знань та внутрішні регламенти. Менеджер ставить запитання та отримує відповідь, сформовану на основі реальних корпоративних даних, без жодного запиту до зовнішньої мережі.

Що таке локальна AI-інфраструктура

Важливо зрозуміти із самого початку: локальний AI – це не одна програма та не одна модель. Це система з кількох взаємозалежних компонентів.

Мовна модель (LLM) – ядро системи. Приймає текстовий запит, розуміє контекст, формує відповідь. Локально можна запустити моделі різного масштабу: від компактних (7-13 млрд. параметрів) до більш важких (70 млрд. і вище). Вибір моделі залежить від завдання та доступного "заліза".

Векторна база даних – сховище знань. Документи, регламенти, листування, дані CRM – все це перетворюється на числові уявлення (вектори) та індексується. Коли користувач ставить запитання, система шукає релевантні фрагменти і передає їх у модель разом із запитом.

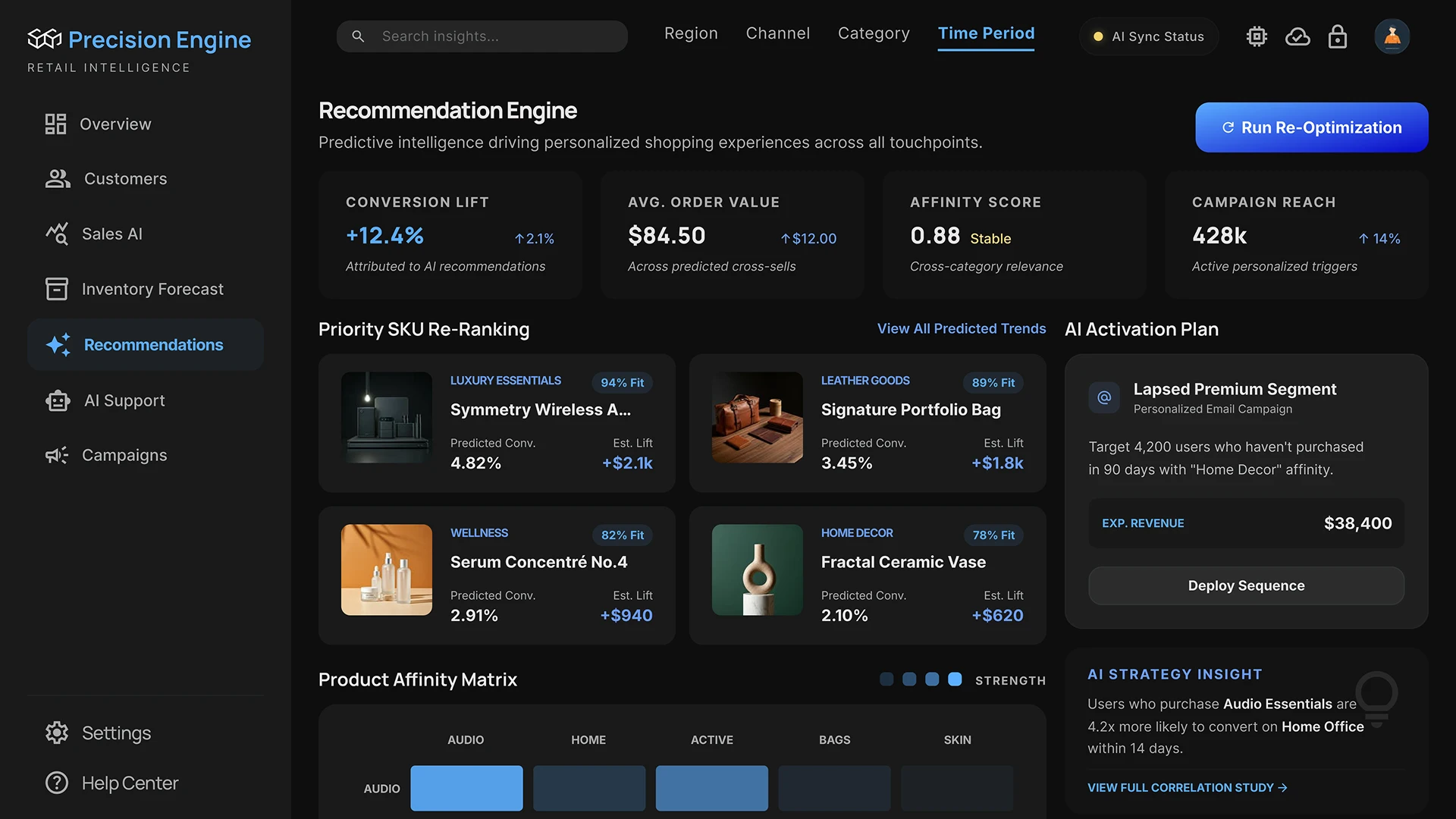

RAG (Retrieval-Augmented Generation) – механізм роботи з контекстом. Замість того, щоб модель "вигадувала" відповідь із загальних знань, RAG підтягує конкретні дані з бази та формує відповідь на їх основі. Це і є те, що робить корпоративний AI по-справжньому корисним.

AI-агенти – активні компоненти системи. На відміну від простого чат-бота агент вміє виконувати дії: шукати інформацію, викликати інструменти, звертатися до зовнішніх API, виконувати багатокрокові завдання. Агент - це AI, який не просто відповідає, а й робить.

Усі чотири компоненти у зв'язці – і є локальний AI.

Чому саме Mac Mini підходить для локальної AI-системи

Зазвичай, коли говорять про запуск AI локально, являють собою дорогі сервери з потужними відеокартами NVIDIA. Такі рішення справді працюють, але коштують дорого, вимагають охолодження, шумлять і потребують обслуговування.

Mac Mini на Apple Silicon – це більш простий та доступний варіант.

Чіпи серії M (M1, M2, M3, M4) влаштовані інакше: процесор та графіка використовують одну загальну пам'ять. Завдяки цьому модель не потрібно переганяти між різними компонентами, як у звичайних системах з окремою відеокартою. Все працює швидше та ефективніше, без зайвих затримок.

Mac Mini M4 Pro з 64 ГБ пам'яті коштує значно дешевше за професійний GPU-сервер, споживає 30–40 Вт у навантаженні, займає місце на столі і працює безшумно. При цьому дозволяє запускати моделі масштабу 30-70 млрд параметрів із прийнятною швидкістю для бізнес-завдань.

Для стартапу або компанії середнього розміру це означає повноцінний локальний AI-сервер без серверної кімнати і без капітальних витрат рівня enterprise.

Архітектура рішення

Це ключовий блок – те, що відрізняє реальну систему від набору випадково встановлених інструментів.

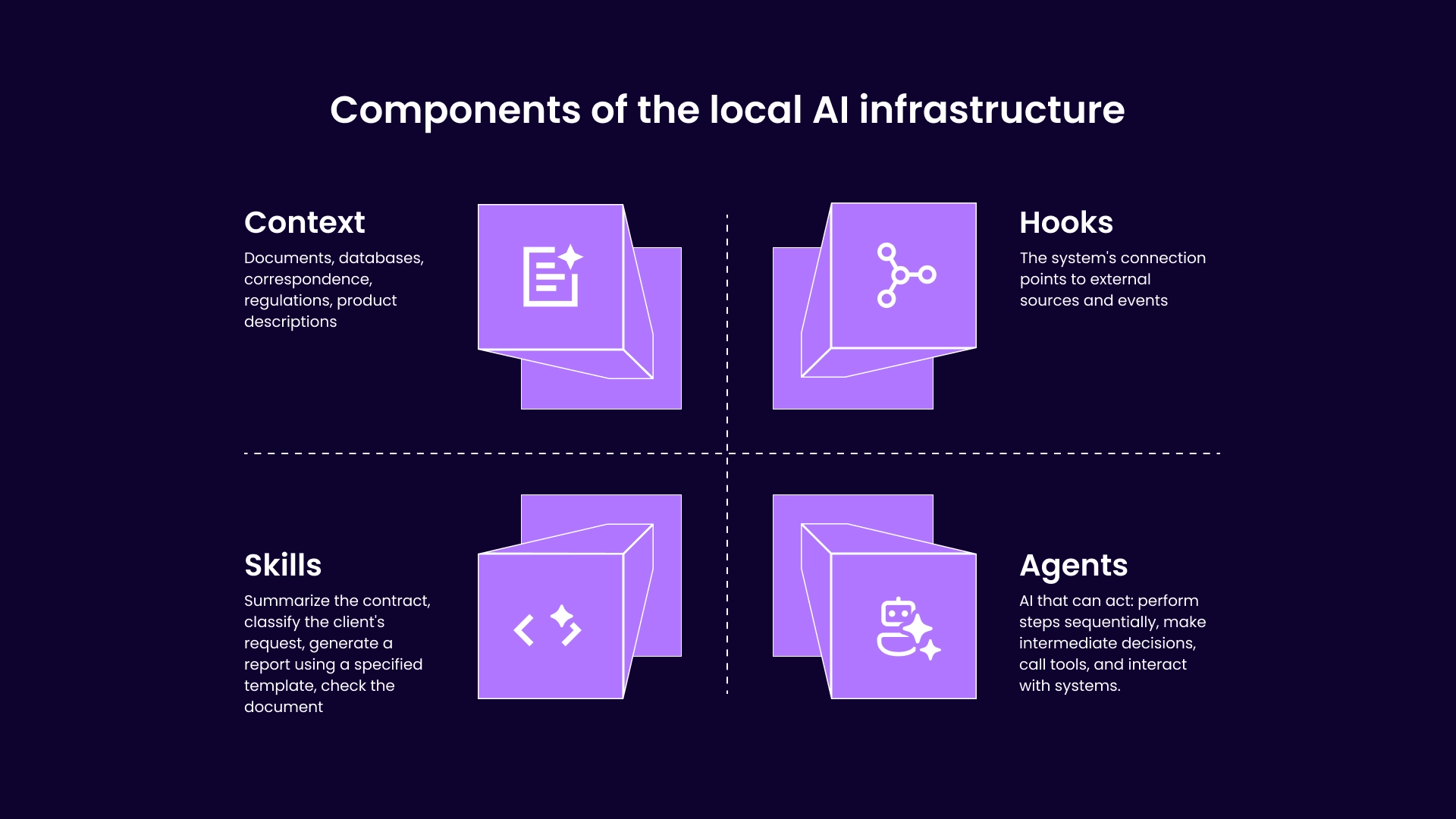

Робоча локальна AI-інфраструктура будується на чотирьох рівнях.

Контекст (Context)

Це те, що модель знає про вашу компанію. Документи, бази даних, листування, регламенти, продуктові описи – все, що потрібно, щоб AI відповідав не абстрактно, саме.

Контекст формується через RAG-пайплайн: документи завантажуються, розбиваються на фрагменти, перетворюються на вектори та індексуються. При кожному запиті система автоматично витягує релевантні фрагменти та передає їх моделі.

Без правильно збудованого контекстного шару модель відповідає з урахуванням загальних знань. З ним – на основі ваших даних.

Навички (Skills)

Це набір спеціалізованих можливостей, якими оснащена система: підсумовувати договір, класифікувати звернення клієнта, сформувати звіт за заданим шаблоном, перевірити документ відповідність регламенту.

Кожна звичка – це окремо налаштований модуль: зі своїм промптом, своєю логікою, своїми джерелами даних. Навички не універсальні – вони ув'язнені під конкретні завдання компанії.

Хукі (Hooks)

Це точки підключення системи до зовнішніх джерел та подій. CRM оновила статус клієнта – AI отримує повідомлення. Надійшов новий документ – запускається автоматична обробка. Співробітник надіслав запит через Slack – система реагує.

Хуки перетворюють AI з інструменту, до якого потрібно звертатися вручну, компонент бізнес-процесу, який працює самостійно.

Агенти (Agents)

Верхній рівень архітектури Агент – це AI, який вміє як відповідати, а й діяти: послідовно виконувати кроки, приймати проміжні рішення, викликати інструменти, взаємодіяти з системами.

Наприклад: агент отримує запит на підготовку звіту – шукає потрібні дані в базі знань, звертається до CRM через API, формує структуру, генерує текст та надсилає результат у потрібний канал. Все це без участі людини.

Чотири рівні працюють разом. Прибрати один – і система втрачає або точність, або гнучкість, або можливість інтеграції.

Як це реалізується на практиці

Нижче – послідовність кроків, які можна пройти з нуля, щоб розгорнути локальну AI-систему.

1. Підготовка середовища

Спочатку переконайтеся, що пристрій підходить:

- Бажано від 16 ГБ об'єднаної пам'яті (краще 32 ГБ, якщо плануєте працювати з великими моделями)

- Достатньо вільного місця (мінімум 20–50 ГБ під моделі та дані)

Далі:

1.1. Оновіть macOS до актуальної версії

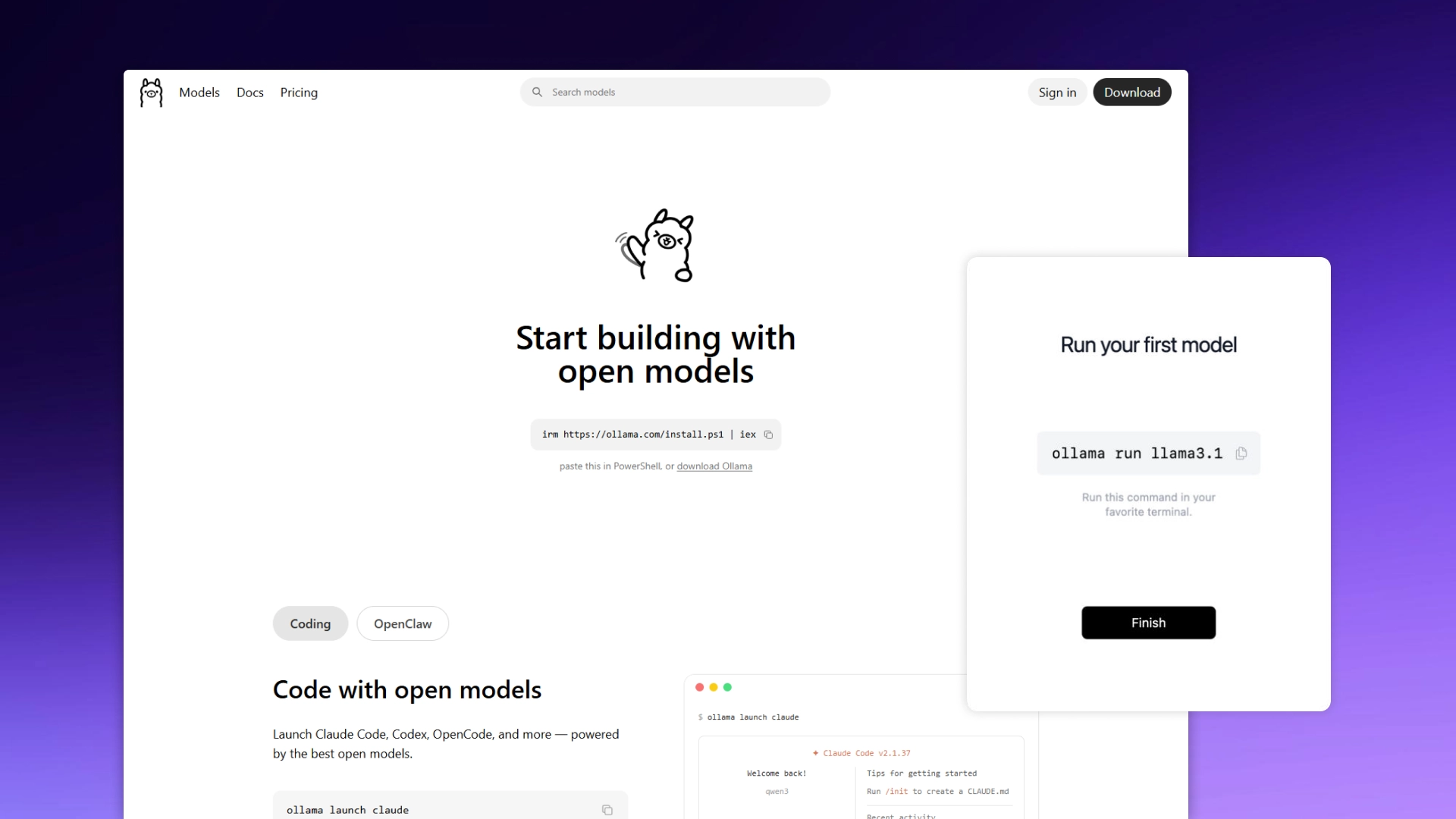

1.2. Встановіть Ollama

- скачайте з офіційного сайту

- встановіть як звичайну програму

1.3. Перевірте, що все працює:

- відкрийте термінал

- виконайте команду: ollama run llama3

1.4. Якщо модель завантажувалася та відповідає – базове середовище готове.

На цьому етапі у вас є локальний AI, але без підключення до ваших даних.

2. Вибір та запуск моделей

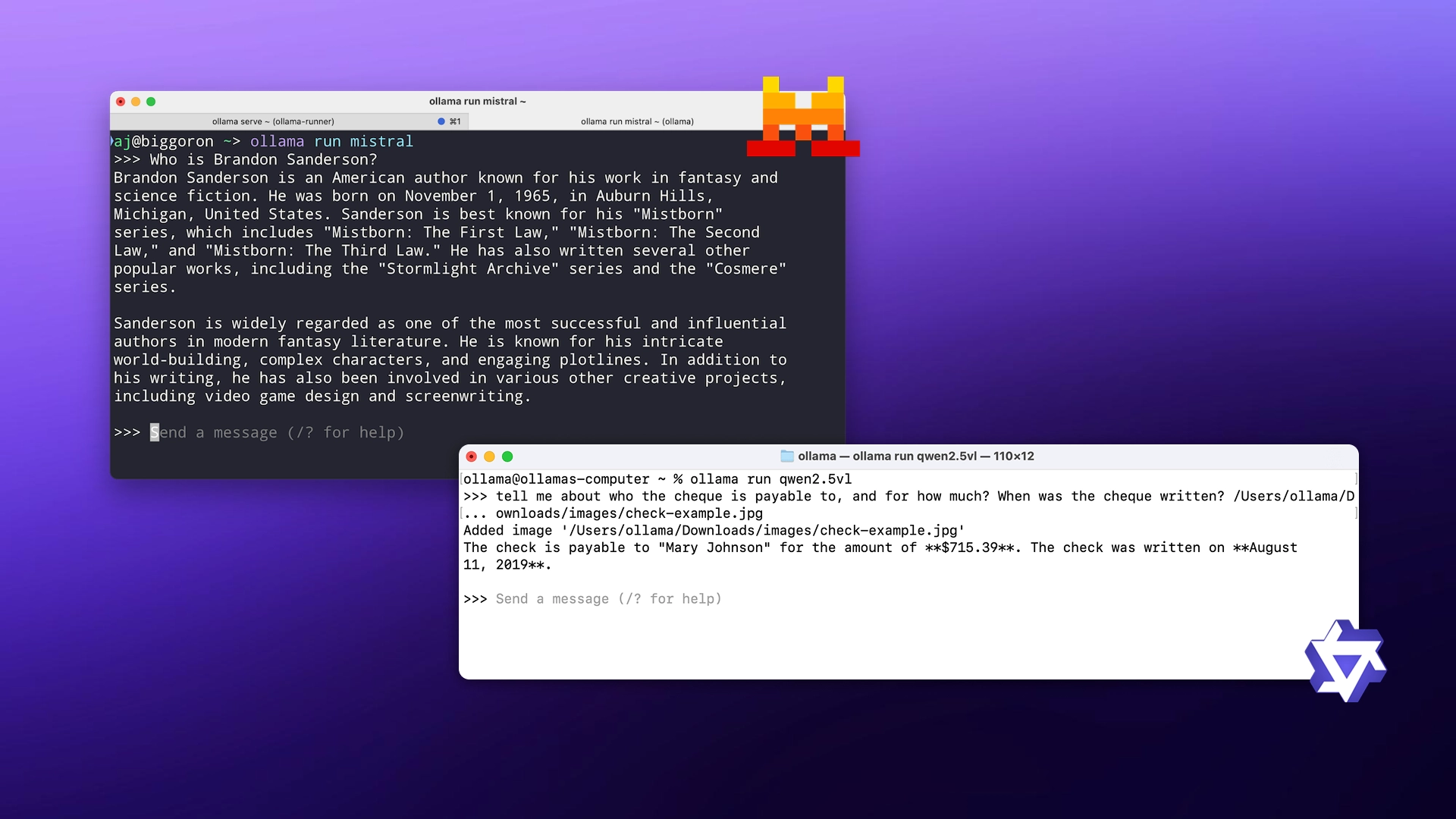

Тепер потрібно зрозуміти які моделі використовувати.

Почніть із простого:

Що зробити:

- Завантажте 1–2 моделі для тесту:

ollama run mistral

ollama run qwen - Протестуйте їх на своїх завданнях:

- поставити запитання

- попросити написати текст

- дати шматок документа

Зверніть увагу на:

- швидкість відповіді

- якість тексту

- "розуміння" запиту

Після цього виберіть одну основну модель і, при потребі, одну додаткову.

3. Підключення бази знань

Тепер додаємо ваші дані.

Крок 1: підготовка документів

Зберіть все, з чим модель має працювати:

- PDF-файли

- нотатки

- інструкції

- листування (якщо потрібно)

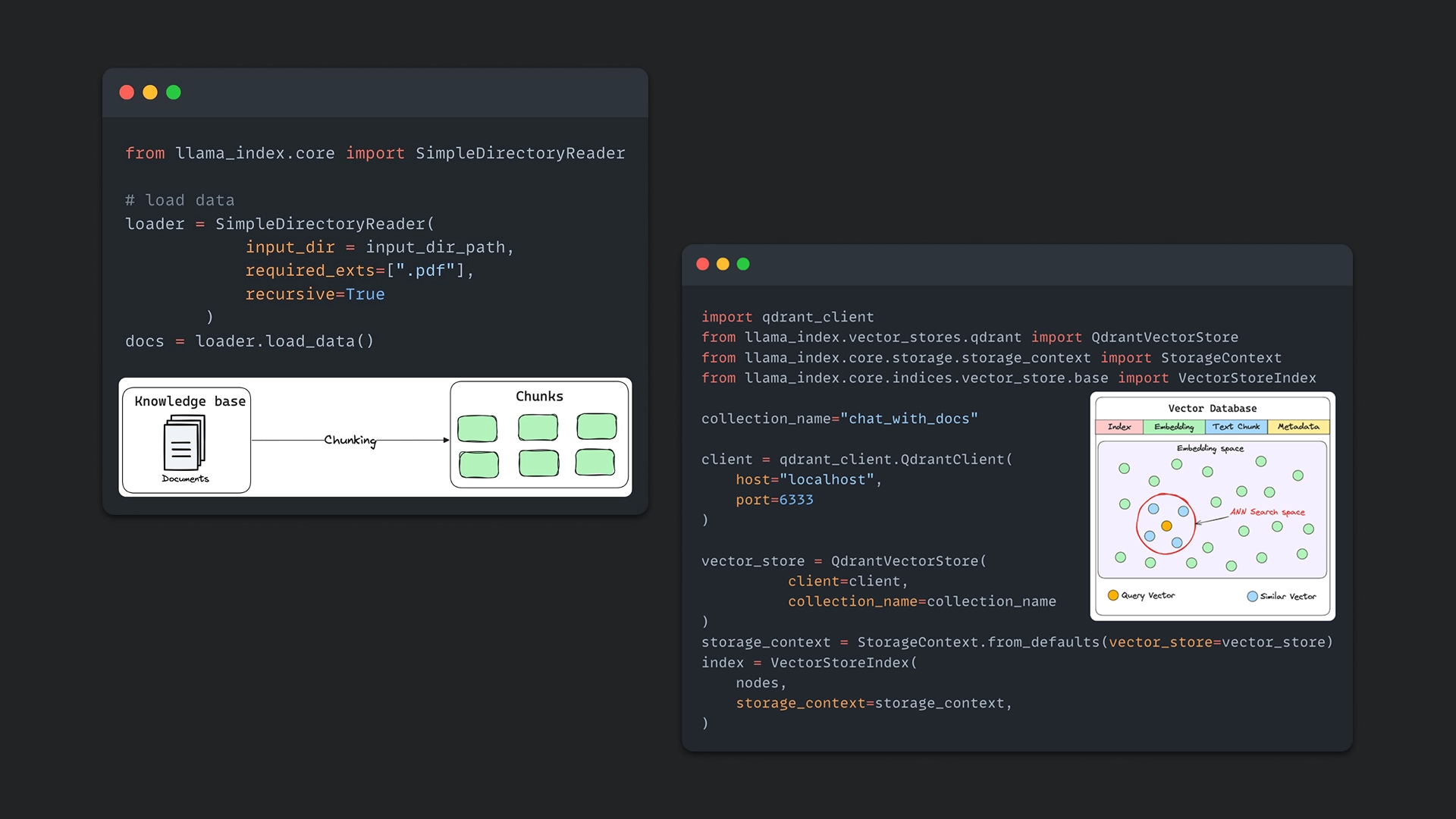

Крок 2: розбивка на часті (chunking)

Документи поділяються на невеликі фрагменти (зазвичай 300-800 слів). Це потрібно, щоб модель могла точно знаходити потрібні шматки.

Крок 3: створення векторної бази

Встановіть одну з БД:

Далі:

- Перетворіть текст на ембеддінги (вектори)

- Збережіть їх у базу

- Прив'яжіть кожен фрагмент до вихідного документа

На практиці це робиться через Python або готові бібліотеки (наприклад, LangChain або LlamaIndex ).

4. Налаштування RAG

Тепер потрібно "пов'язати" модель та базу. Передбачається, що у вас вже встановлено Ollama або налаштований доступ до іншої LLM через API.

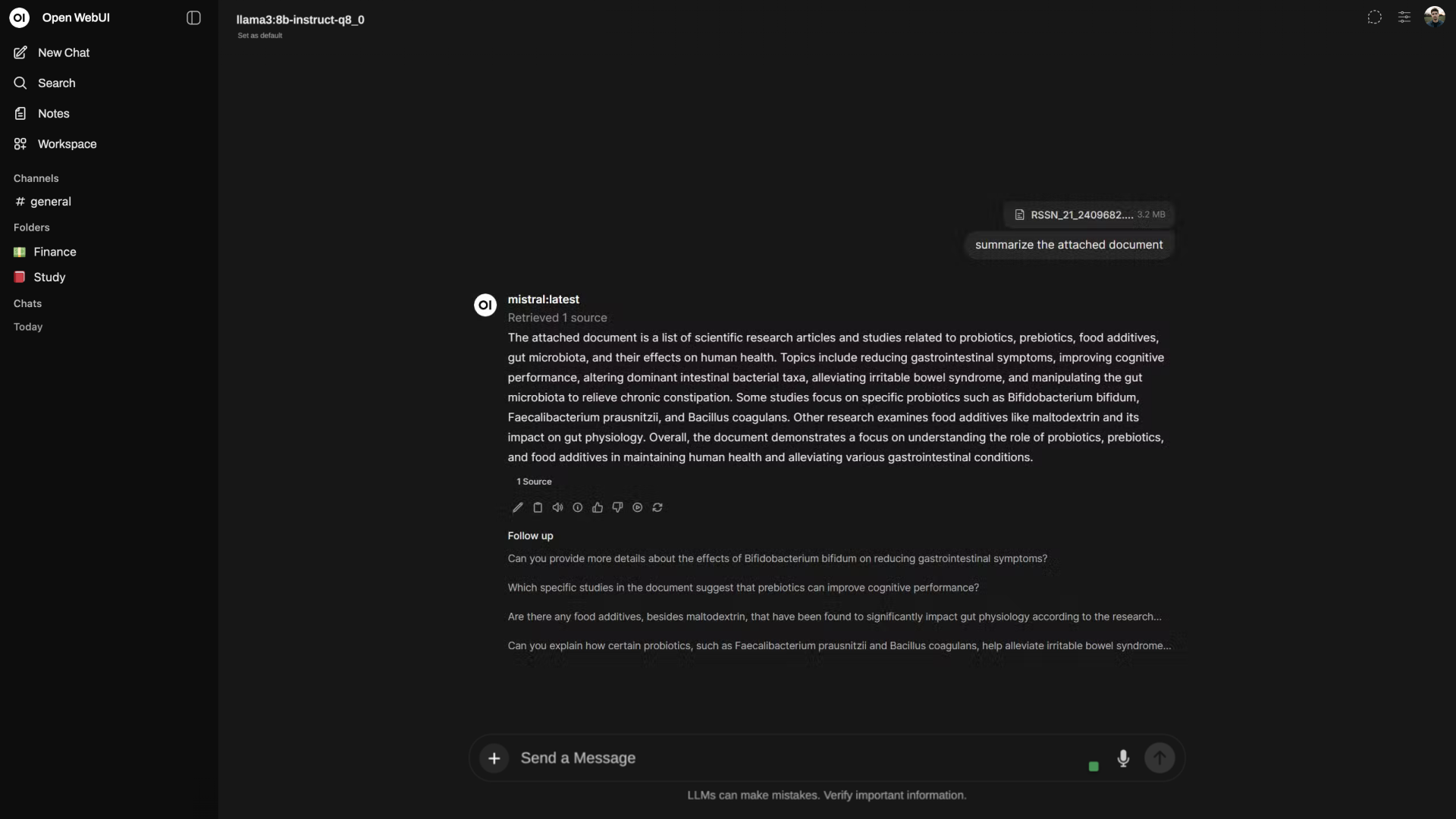

Крок 1: Встановіть інтерфейс для роботи

Щоб не працювати через термінал, потрібен інтерфейс:

- Open WebUI – більш гнучкий варіант

- LM Studio – простіше для старту

Що зробити:

- Встановіть вибраний інструмент

- Запустіть його

- Переконайтеся, що він бачить вашу модель (через Ollama або API)

Крок 2: Виберіть та активуйте модель

В інтерфейсі:

- Відкрийте список моделей

- Виберіть встановлену (наприклад):

- Mistral

- Llama

- Qwen

- Встановіть її як основну для чату

Перевірте: модель має відповідати на звичайні запитання.

Крок 3: Додати документи (база знань)

В інтерфейсі знайдіть розділ:

- "Knowledge" / "Documents" / "Files"

Далі:

- Завантажте файли (PDF, DOCX, TXT)

- Дочекайтесь обробки

Система автоматично:

- розіб'є текст на фрагменти

- створить векторний індекс (зазвичай на базі Chroma чи аналогів)

Крок 4: Увімкніть використання бази (RAG)

Тепер важливо зв'язати модель та документи:

- Відкрийте налаштування чату/помічника.

- Знайдіть параметри:

- “Use knowledge base”

- "Retrieval"

- "Context"

- Увімкніть їх.

- Вкажіть, які документи використати.

Без цього кроку RAG не працюватиме, навіть якщо файли завантажені.

Крок 5: Вкажіть правило відповіді

У налаштуваннях асистента (System Prompt) додайте:

Відповідай лише на основі завантажених документів. Якщо інформації недостатньо – повідом про це.

Це знижує ймовірність вигаданих відповідей.

Крок 6: Налаштуйте параметри пошуку

Якщо інтерфейс дозволяє, перевірте:

- Top K (кількість фрагментів) → 3–5

- Search type → similarity або hybrid

Якщо таких параметрів немає, використовуйте значення за замовчуванням.

Крок 7: Перевірте роботу

Зробіть два тести:

- Питання, на яке є відповідь у документах

- Питання, на яке немає відповіді

Очікуваний результат:

- у першому випадку – точна відповідь за даними

- у другому – чесне “інформації немає”

5. Запуск агентів

Крок 1: Відкрийте інтерфейс та перейдіть до створення асистента

Запустіть Open WebUI. У меню знайдіть розділ “Assistants”, “Agents” або “Workspaces” та натисніть кнопку створення нового асистента (Create Assistant).

Крок 2: Визначте завдання агента

У полі Instructions або System Prompt опишіть, що він повинен робити.

Приклад: відповідати на запитання клієнтів, аналізувати документи чи допомагати зі звітами.

Крок 3: Підключіть базу знань (RAG)

Знайдіть блок “Knowledge” або “Documents” та виберіть завантажені раніше файли.

Якщо документи ще не додані, завантажте їх тут же.

Це дозволить агенту відповідати на основі ваших даних, а не лише “загальних знань”.

Крок 4: При необхідності додайте інструменти

Деякі версії інтерфейсу містять розділ “Tools” або “Functions”.

Там можна підключити:

- API

- зовнішні сервіси

- додаткові джерела даних

Якщо цього блоку немає – можна працювати лише з базою знань, цього достатньо більшості завдань.

Крок 5: Вкажіть логіку роботи

Логіка прописується текстом у тому самому полі “Instructions”.

Приклад:

- якщо питання щодо документів → використовуй базу знань

- якщо інформації немає → повідом про це

- не вигадуй відповіді

Крок 6: Налаштуйте формат відповіді

Також через інструкції задайте, як має виглядати результат.

Наприклад:

- коротка відповідь

- структурована відповідь (пункти)

- JSON (якщо потрібно для інтеграцій)

Крок 7: Збережіть помічника і протестуйте

Збережіть налаштування, відкрийте чат з цим помічником і поставте кілька реальних питань.

Перевірте:

- чи використовує він документи

- чи не вигадує відповіді

- чи дотримується формату

Крок 8: За потреби скоригуйте

Якщо відповіді слабкі:

- уточніть інструкції

- переформулюйте логіку

- перевірте, чи база знань дійсно підключена

- при необхідності змініть модель Ollama

Що виходить у результаті

Після проходження всіх кроків у вас є:

- локально запущена модель

- база знань із вашими даними

- система пошуку за цими даними (RAG)

- агенти під конкретні завдання

І все це працює без хмари та без передачі даних назовні.

Якщо ви не бажаєте налаштовувати систему самостійно, для масштабування, інтеграції та оптимізації роботи моделі можна залучити досвідченого інженера.

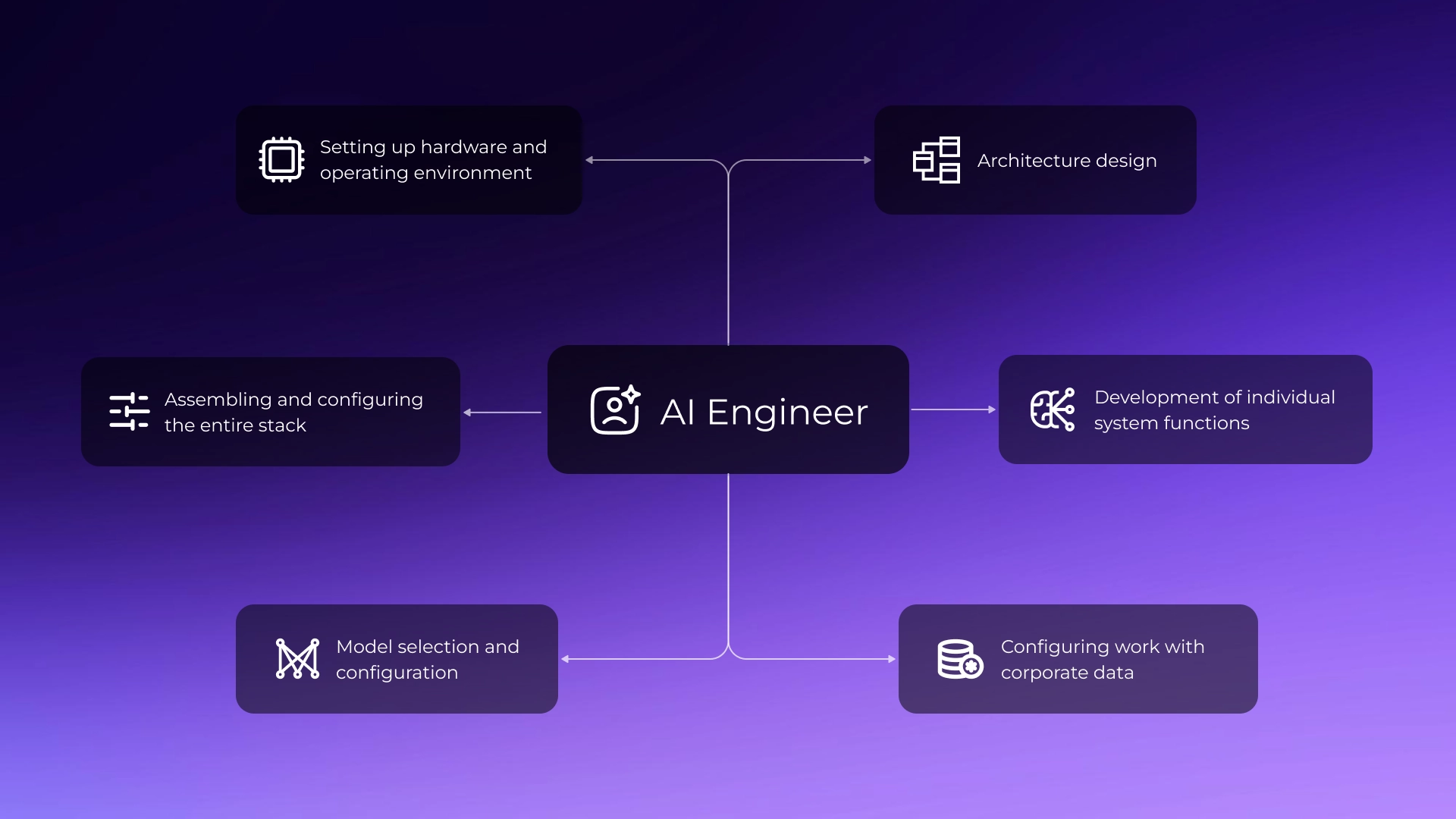

Що робить інженер з локального AI

Інженер з локального AI – це не розробник загального профілю та не фахівець за даними. Це людина на перетині трьох областей: вона розуміє, як працює залізо, як влаштовані мовні моделі і як зібрати з набору інструментів бізнес-продукт, що працює. Такий фахівець зустрічається рідко – саме тому, що кожна з цих областей сама по собі є глибокою.

- Налаштування заліза та операційного середовища. Mac Mini у ролі AI-сервера потребує серйозної підготовки. Інженер налаштовує систему так, щоб вона стабільно працювала під постійним навантаженням: правильно розподіляє пам'ять між кількома моделями, забезпечує доступ до системи всередині мережі компанії, налаштовує моніторинг температури та навантаження, організовує резервне копіювання. Також опрацьовується автоматичний запуск усіх сервісів після перезавантаження та ведення системних журналів – щоб за будь-якої позаштатної ситуації було зрозуміло, що сталося.

- Складання та налаштування всього стека. Як ви знаєте, локальний AI – це одна програма, а кілька взаємозалежних компонентів. Інженер розгортає кожну та зв'язує їх між собою: середовище для запуску моделей, інтерфейс для звернення до системи з інших додатків, базу для зберігання корпоративних знань, за потреби – інструменти для обробки завдань на фоні. Кожен компонент налаштовується під конкретне навантаження, а не запускається за замовчуванням.

- Підбір та налаштування моделей. Вибір моделі вимагає перевірки, рейтинги та відгуки тут не допоможуть. Інженер перевіряє, як конкретна модель справляється саме із завданнями компанії: тестує якість відповідей на реальних прикладах, вимірює швидкість роботи на цільовому залозі, оцінює споживання пам'яті. При необхідності модель "стискається" – це дозволяє запустити більш потужну версію в рамках доступних ресурсів із контрольованою втратою якості.

- Проєктування архітектури. Це найвідповідальніша частина роботи. Інженер продумує, як дані рухаються всією системою: звідки беруться, як обробляються, хто і чого має доступ. Заздалегідь закладається логіка зростання: що зміниться в системі, якщо користувачів стане втричі більше або обсяг документів зросте вдесятеро. Продумується і поведінка при збоях – як система відновлюється, якщо один із компонентів перестає працювати.

- Розробка окремих функцій системи. Кожна функція – аналіз договору, класифікація звернення, генерація звіту – окремо спроєктований модуль. Інженер визначає, які дані потрібні для кожної функції, як саме вона повинна обробляти запит і в якому форматі повертати результат.

- Налаштування роботи з корпоративними даними. Якість відповідей системи залежить від того, як налаштований пошук за базою знань. Інженер підбирає оптимальний спосіб розбивки документів на фрагменти, налаштовує логіку пошуку релевантних частин та визначає, як знайдена інформація входить у запит до моделі. Саме тут найчастіше виникають проблеми у тих, хто намагається зібрати систему самостійно: технічно все запускається, але відповіді виходять неточними чи не на тему.

- Доопрацювання після запуску. Система не виходить на робочу якість одразу. Після запуску починається цикл тестування на реальних сценаріях: фіксуються помилки, коригуються налаштування, доопрацьовується логіка. Інженер вибудовує процес оцінки якості відповідей – частина перевірок автоматизується, частина потребує участі людей, які добре знають предметну область. Це ітераційна робота, і вона є частиною застосування, а не його наслідком.

Приклади використання

AI-асистент для внутрішньої підтримки

Галузь: IT-компанія, SaaS

Розмір: 300–350 працівників

Проблема: HR та IT витрачали до 30% робочого часу на однотипні питання від співробітників – за регламентами, процесами узгодження, внутрішніми інструкціями. Інформація існувала в документах, але знайти її було незручно.

Рішення: На Mac Mini розгорнуть локальний AI-асистент, підключений до внутрішньої бази документів компанії. Співробітники звертаються до нього через Slack природною мовою та отримують точні відповіді з посиланням на джерело. Дані не залишають периметр компанії. Навантаження на HR та IT скоротилося, швидкість онбордингу нових співробітників зросла.

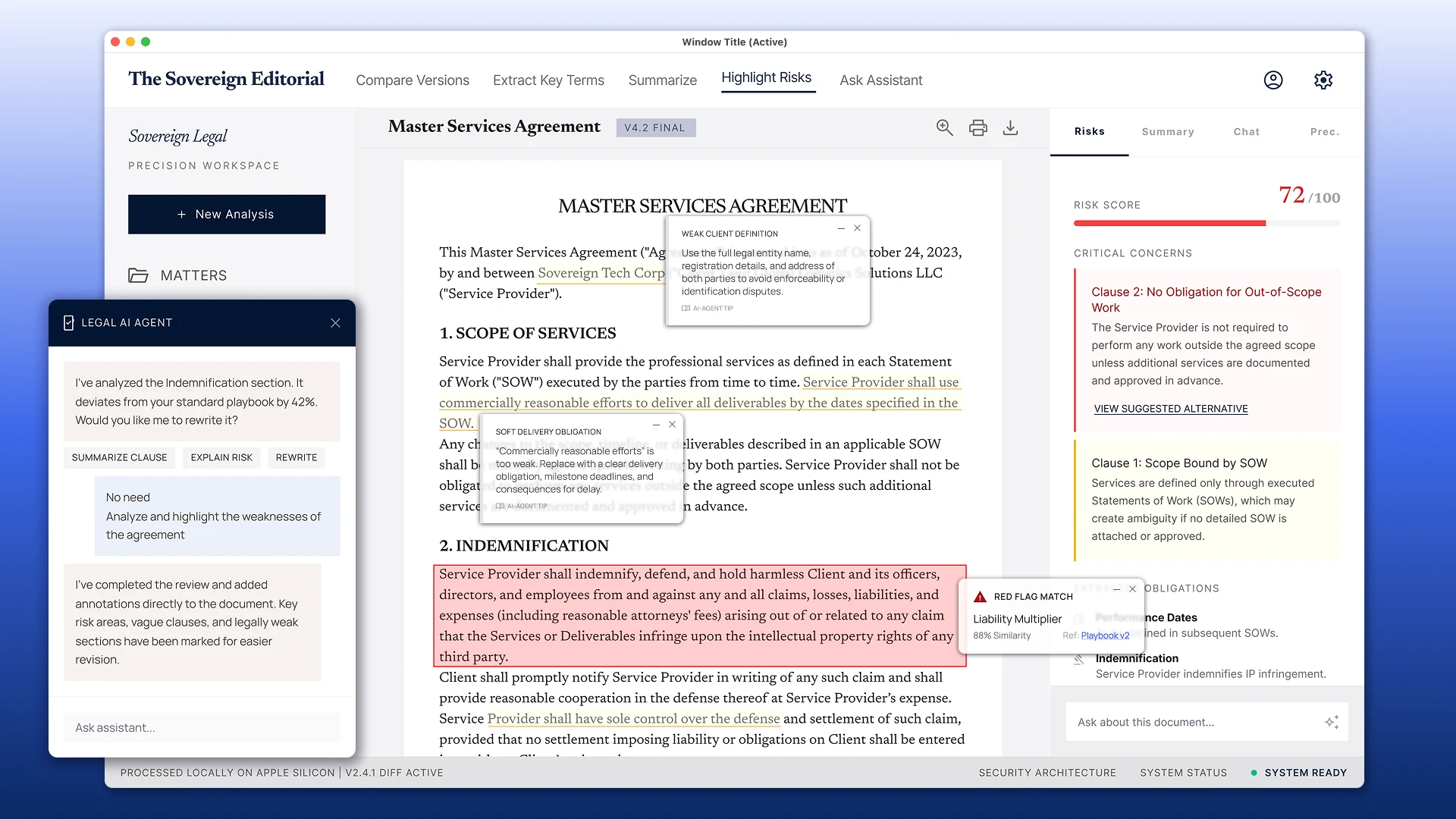

Аналіз договорів та документів

Галузь: Дистрибуція, оптова торгівля

Розмір: 200–300 працівників

Проблема: Юридичний департамент обробляв до 50 договорів постачання на місяць. Первинний розбір одного документа займав від 40 хвилин до півтори години: перевірка умов оплати, відповідальності сторін, нестандартних пунктів.

Рішення: На Mac Mini розгорнуто локальну AI-систему для аналізу документів. Модель отримує ключові умови, порівнює з внутрішнім шаблоном і формує структуроване резюме з позначками по спірних пунктах. Час первинного аналізу скоротився до 5-7 хвилин. Фінальне рішення залишається за юристом, але вже з готовою аналітичною базою. Усі документи обробляються локально.

CRM з AI-шаром

Галузь: B2B-продаж, професійні послуги

Розмір: 40-60 співробітників

Проблема: У CRM накопичилася історія сотнями клієнтів – листування, дзвінки, угоди, відмови. Перед кожним дзвінком менеджери витрачали час на ручний перегляд історії, але закономірності даних залишалися непоміченими.

Рішення: На Mac Mini розгорнуто AI-агент, інтегрований з CRM через API. Перед дзвінком агент автоматично формує саммарі за клієнтом: історія взаємодій, відкриті питання, контекст останньої зустрічі. Після дзвінка фіксує підсумки та пропонує наступний крок. Згодом система почала виявляти патерни успішних угод у межах сегментів. Час на підготовку до дзвінка скоротився з 15-20 хвилин до 2-3.

Локальний AI vs Хмарний AI

| Параметр | Локальний AI | Хмарний AI |

|---|---|---|

| Конфіденційність | Дані не залишають компанію | Дані обробляються на зовнішніх серверах |

| Вартість | Фіксовані інвестиції у залізо | Змінні витрати, зростають з обсягом |

| Якість моделей | Обмежено моделями, що локально запускаються. | Доступ до найпотужніших моделей (GPT-4o, Claude 3.5) |

| Швидкість застосування | Потребує налаштування та часу | Швидкий старт через API |

| Гнучкість налаштування | Повний контроль | Обмежено можливостями провайдера |

| Масштабованість | Обмежена залізом | Масштабується легко |

Коли окупається локальне рішення. Орієнтовна логіка: якщо компанія витрачає на хмарний AI від 2000-3000 EUR на місяць (API-витрати плюс інструменти), Mac Mini M4 Pro з налаштуванням окупається за 6-12 місяців. При вищому навантаженні – швидше. При низькій – хмара може бути економічнішою.

Для завдань, де конфіденційність критична, розрахунок інший: хмарне рішення може бути просто неприйнятним незалежно від вартості.

Багато компаній приходять до гібридної архітектури: локально – чутливі дані та високочастотні завдання, хмара – завдання, що потребують максимальної потужності моделі.

Обмеження та нюанси

Було б нечесно не сказати прямо про це.

Не все можна локально. Найпотужніші моделі (GPT-4o, Claude 3.5/3.7 Sonnet, Gemini Ultra) вимагають колосальних обчислювальних ресурсів та доступні лише через API. Локально запускаються моделі сильніші в одних завданнях, слабші в інших. Для завдань, де потрібна максимальна точність генерації або складний багатокроковий reasoning, хмарні моделі поки що виграють.

Є обмеження за потужністю. Mac Mini за всіх своїх переваг – не дата-центр. При одночасному навантаженні від кількох користувачів швидкість відповіді знижується. Якщо AI одночасно використовує близько 15–20 осіб, це, як правило, некритично. Для високонавантажених систем знадобиться більш серйозне залізо або кластерна архітектура.

Система вимагає налаштування та супроводу. Після встановлення необхідно провести початкову конфігурацію, щоб забезпечити повноцінну роботу. Потрібне періодичне оновлення моделей та компонентів, а також моніторинг якості відповідей. Це безперервний процес, а не разове налаштування.

Коли бізнесу це дійсно потрібно

Вибір локальної AI-інфраструктури виправданий, якщо одночасно виконується кілька умов:

- у компанії є значний масив внутрішніх даних (документи, основи знань, історія взаємодій);

- конфіденційність цих даних важлива – за вимогами регулятора, внутрішньої політики чи здорового глузду;

- є процеси, що повторюються, які AI може автоматизувати або прискорити;

- компанія готова до інженерного впровадження, а чи не шукає готовий продукт "під ключ" без адаптації.

Якщо все це про вас – локальна інфраструктура AI не просто можлива, вона доцільна.

Підсумок

Локальний AI на Apple Silicon – робочий та практичний підхід, що вже використовується компаніями, яким важливий контроль над даними та передбачуваність витрат.

Mac Mini M4 Pro забезпечує достатню потужність, відкриті моделі демонструють прийнятну якість, а стек інструментів для локального розгортання зрілий та стабільний.

Основне завдання – правильно побудувати архітектуру: налаштувати контекстний шар, RAG, розробити навички під конкретні бізнес-завдання, запустити агентів та забезпечити надійну роботу системи. Помилки на цьому рівні призводять до неточних відповідей, проблем із масштабуванням та інтеграцією, тому важливо продумати структуру із самого початку.

Ми допомагаємо компаніям спроєктувати та запустити локальні AI-системи: від вибору архітектури до працюючого рішення. Якщо хочете обговорити ваше завдання – напишіть нам.