Інженер з контролю якості штучного інтелекту / машинного навчання

Що робить AI/ML QA Engineer

AI-система, яка не пройшла повноцінне тестування – це ризик для бізнесу. Мовна модель може впевнено видавати неправильну інформацію, рекомендаційна система – давати нерелевантні результати, а класифікатор – систематично помилятися певних сегментах даних.

AI/ML QA Engineer – це фахівець, який забезпечує зниження таких помилок у ІІ-проектах: тестує точність та стійкість моделей, виявляє галюцинації, перевіряє якість даних та оцінює поведінку системи під навантаженням. Його завдання – переконатися, що AI-система веде себе передбачувано та коректно не лише у тестовому середовищі, а й у реальних умовах експлуатації.

У ланцюжку розробки AI-систем QA Engineer стоїть останнім перед запуском: він приймає те, що побудував AI Developer, навчив ML Engineer, підготував Data Engineer і розмітив Data Annotator, і дає фінальну відповідь на питання – чи готова система до запуску реальних користувачів.

Виберіть разробника

Як виглядає процес роботи AI/ML QA Engineer

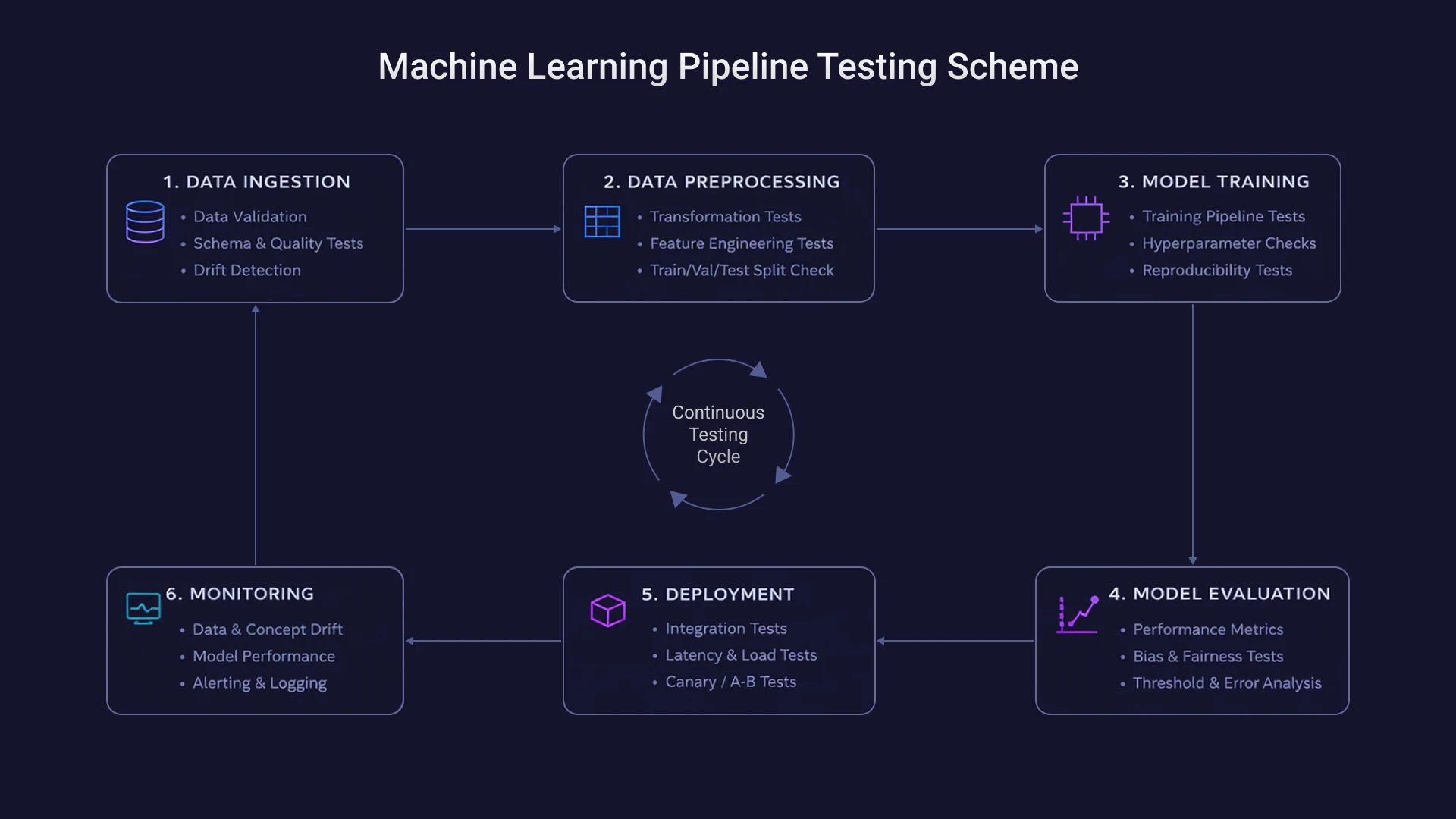

QA в AI-проектах – це не разова перевірка перед релізом, а послідовний процес, який охоплює дані, моделі, додатки та їхню поведінку в production.

Планування QA (QA Planning). На старті AI/ML QA Engineer визначає тестові сценарії, формує оціночні набори даних (evaluation datasets) та погодить критерії якості з командою. Від того, як точно на цьому етапі сформульовані вимоги, залежить глибина всього наступного тестування.

Перевірка даних (Dataset QA). Перш ніж тестувати модель, потрібно переконатися як дані, на яких вона навчена. AI/ML QA Engineer перевіряє датасети на наявність помилок розмітки, виявляє зміщення (bias) та оцінює репрезентативність вибірок.

Тестування ML-моделей (Model QA). AI / ML QA Engineer перевіряє поведінку моделі на тестових вибірках, аналізує ключові метрики – точність (accuracy), повноту (recall) та точність за класом (precision) – та виявляє сценарії, в яких модель помиляється.

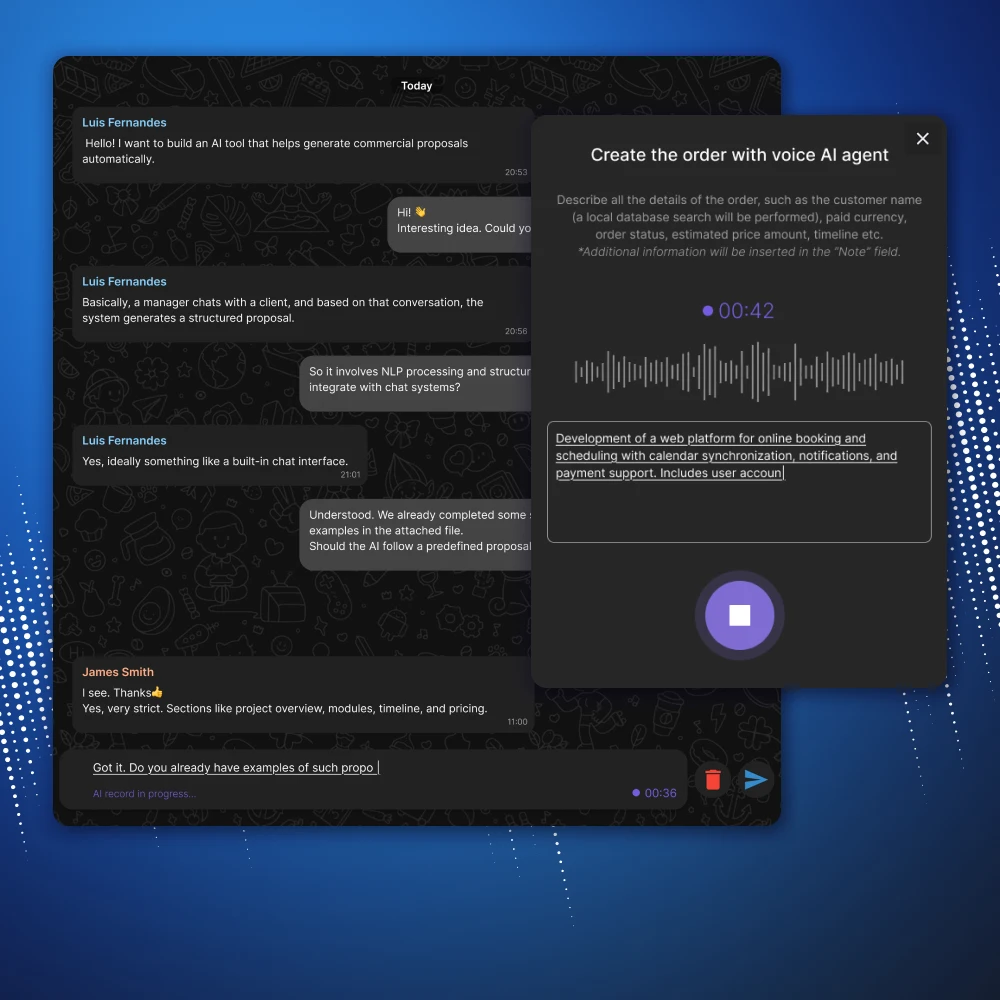

Тестування LLM-додатків (LLM QA). Мовні моделі вимагають окремого підходу: AI/ML QA Engineer перевіряє коректність відповідей, тестує стійкість промптів (prompt robustness) та виявляє галюцинації – випадки, коли модель впевнено генерує фактично неправильну інформацію.

Тестування RAG-систем (RAG QA). У системах з доповненою генерацією (retrieval-augmented generation) якість відповіді залежить тільки від моделі, а й від того, наскільки релевантні документи вона витягує. AI / ML QA Engineer тестує компонент пошуку та перевіряє, чи відповідають джерела контексту запиту.

Тестування навантаження (Performance QA). AI / ML QA Engineer перевіряє latency - час відповіді системи - і тестує її поведінку під піковим навантаженням, щоб переконатися, що продуктивність залишається в допустимих межах реального трафіку.

Моніторинг у production (Production Monitoring). Після запуску AI/ML QA Engineer аналізує логи, відстежує аномалії в поведінці моделі та виявляє деградацію якості у міру зміни вхідних даних.

Інструменти AI/ML QA Engineer

Стек AI/ML QA Engineer охоплює інструменти для тестування моделей, моніторингу та автоматизації перевірок.

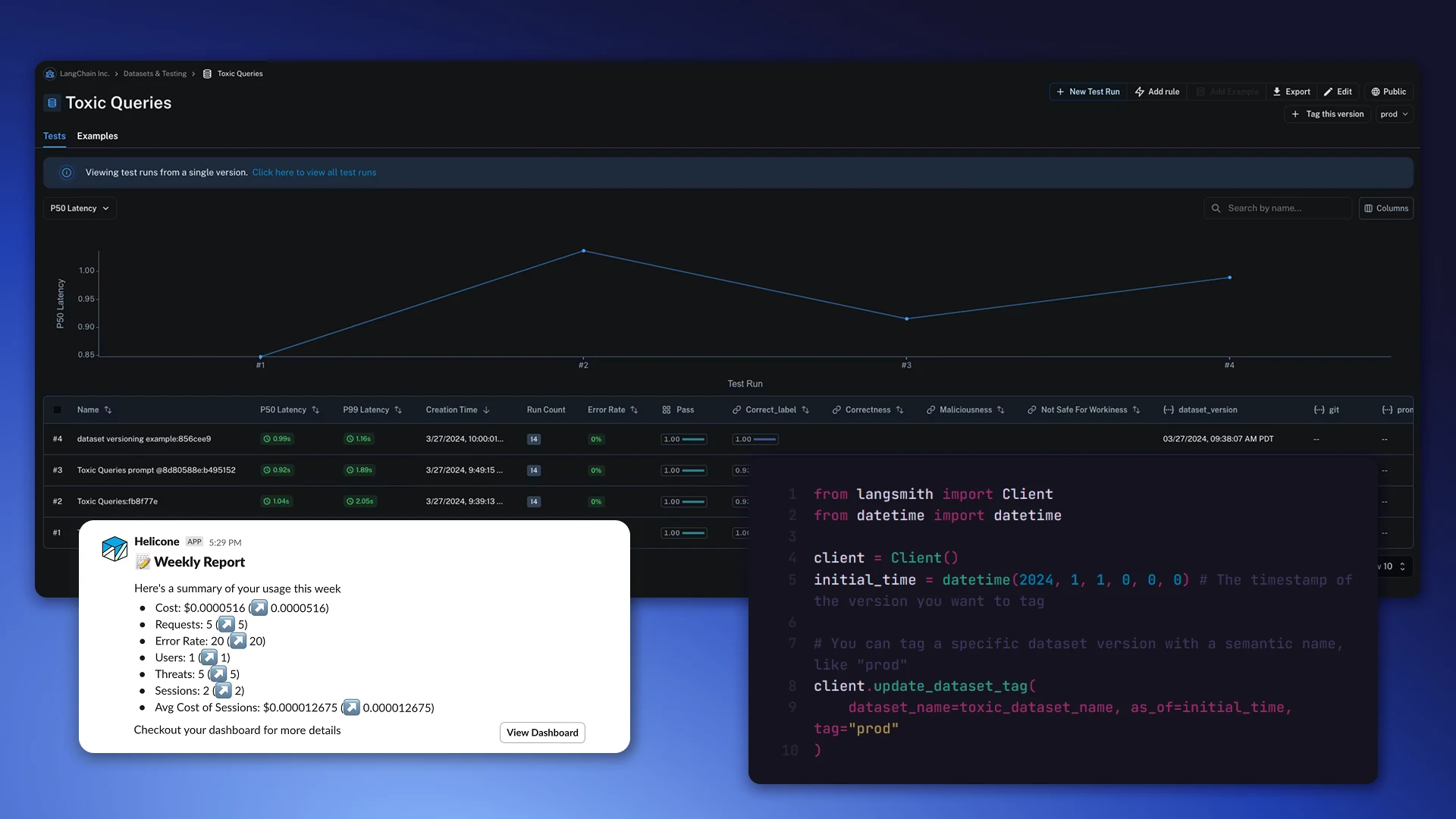

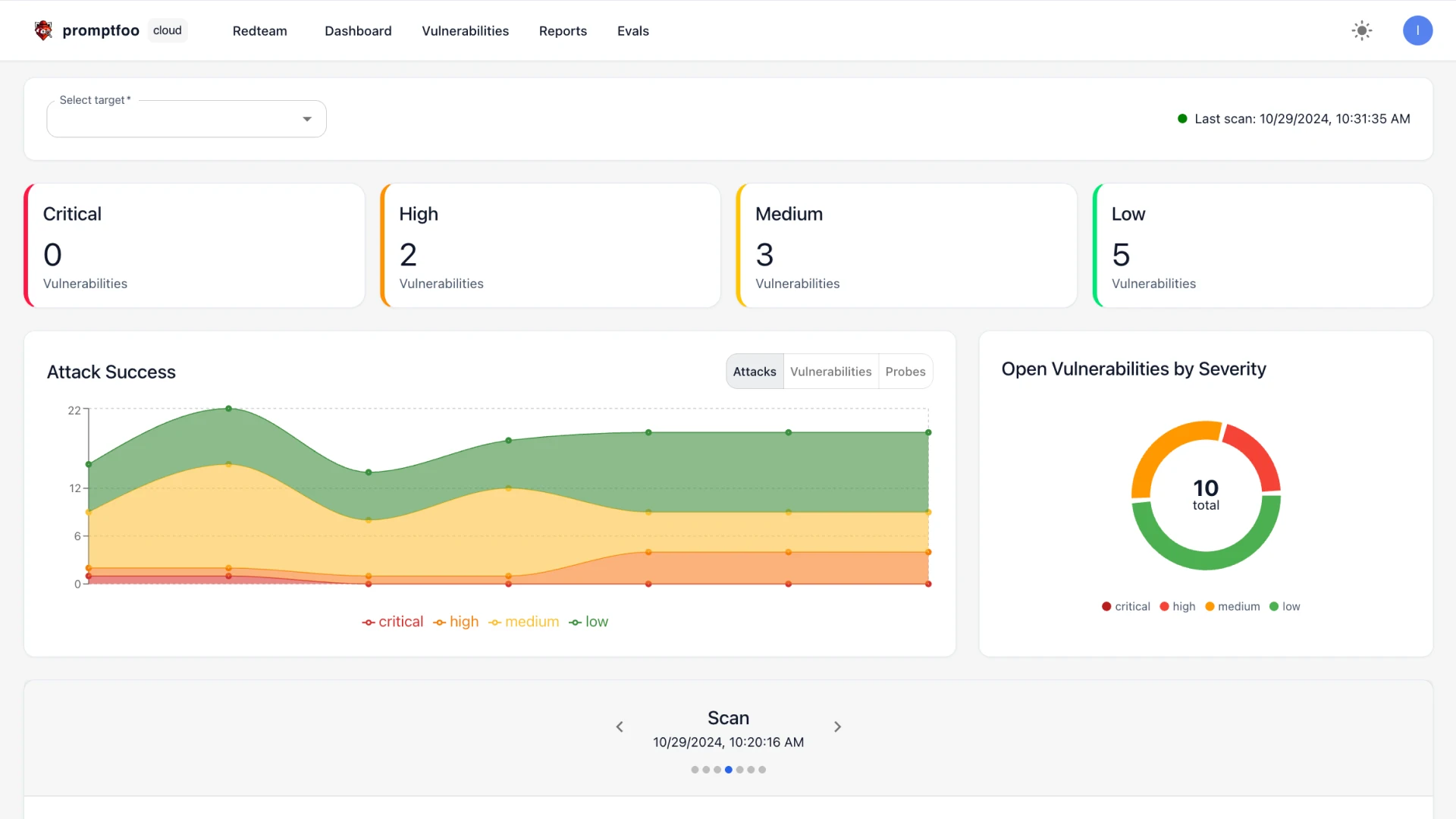

Тестування LLM: LangSmith, Promptfoo, DeepEval – інструменти для оцінки якості відповідей мовних моделей, тестування промптів та виявлення галюцинацій.

Моніторинг AI-систем: Langfuse та Helicone забезпечують спостереження LLM-додатків у production – відстеження запитів, аналіз latency та виявлення аномалій.

Оцінка ML-моделей: MLflow та Weights & Biases використовуються для відстеження експериментів, порівняння метрик та контролю версій моделей.

Автоматизація QA: Playwright, Selenium та Cypress застосовуються для наскрізного тестування інтерфейсів AI-програм, Postman – для перевірки програмних інтерфейсів (API).

Метрики якості AI-систем

Якість AI-системи складається із набору метрик, кожна з яких відповідає за свій аспект поведінки моделі.

Accuracy показує частку коректних відповідей моделі на тестовій вибірці та дає загальне уявлення про її точність.

Precision та Recall використовуються там, де важлива не просто точність, а баланс між помилковими спрацьовуваннями та пропущеними помилками – наприклад, у класифікаційних задачах.

Hallucination rate – частка відповідей, у яких модель генерує фактично неправильну інформацію із високим рівнем впевненості. Особливо критична для LLM-додатків у медицині, праві та фінансах.

Response relevance оцінює, наскільки відповідь моделі відповідає контексту та наміру користувача, а не просто є граматично коректним текстом.

Latency – час відповіді системи, що безпосередньо впливає на досвід користувача і масштабованість продукту.

Error rate фіксує частоту збоїв і некоректних відповідей у production і є основним індикатором стабільності системи.

Де застосовується AI/ML QA

Будь-яка AI або ML-система, яка взаємодіє з користувачами чи бере участь у прийнятті бізнес-рішень, потребує окремого процесу тестування.

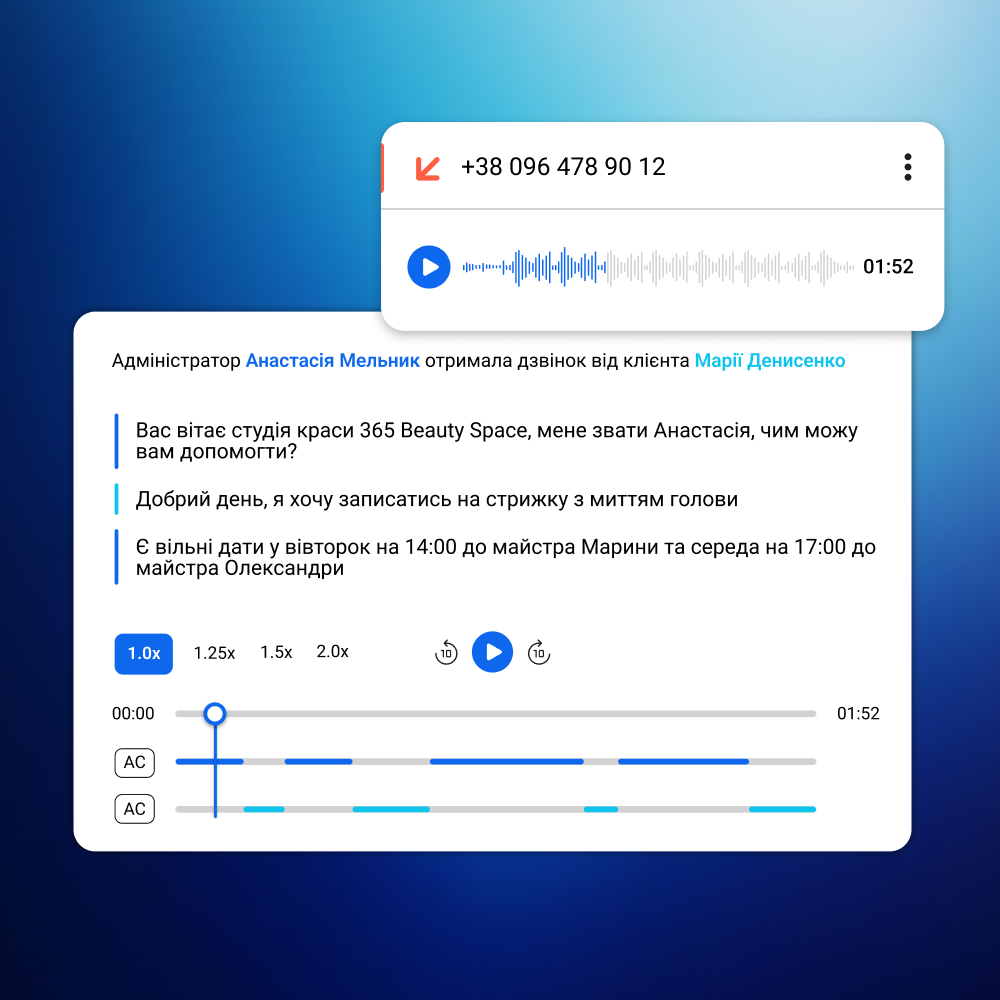

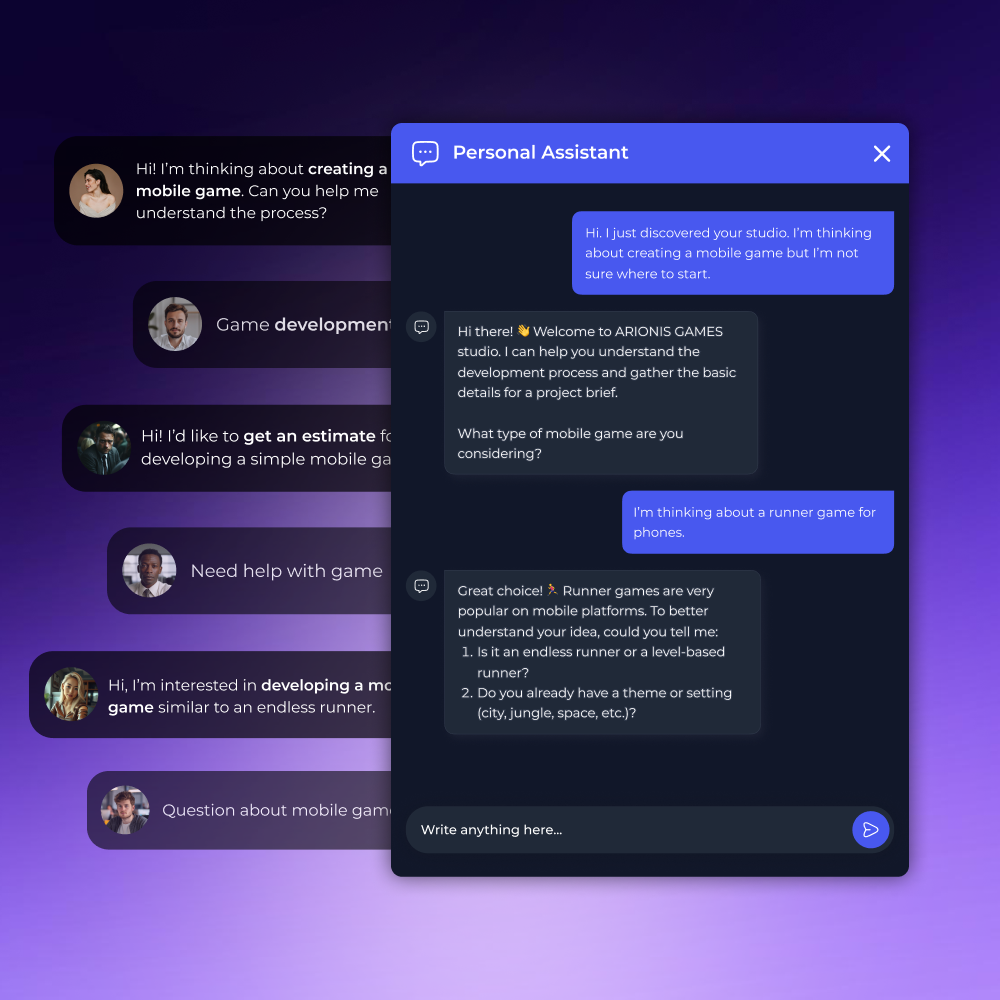

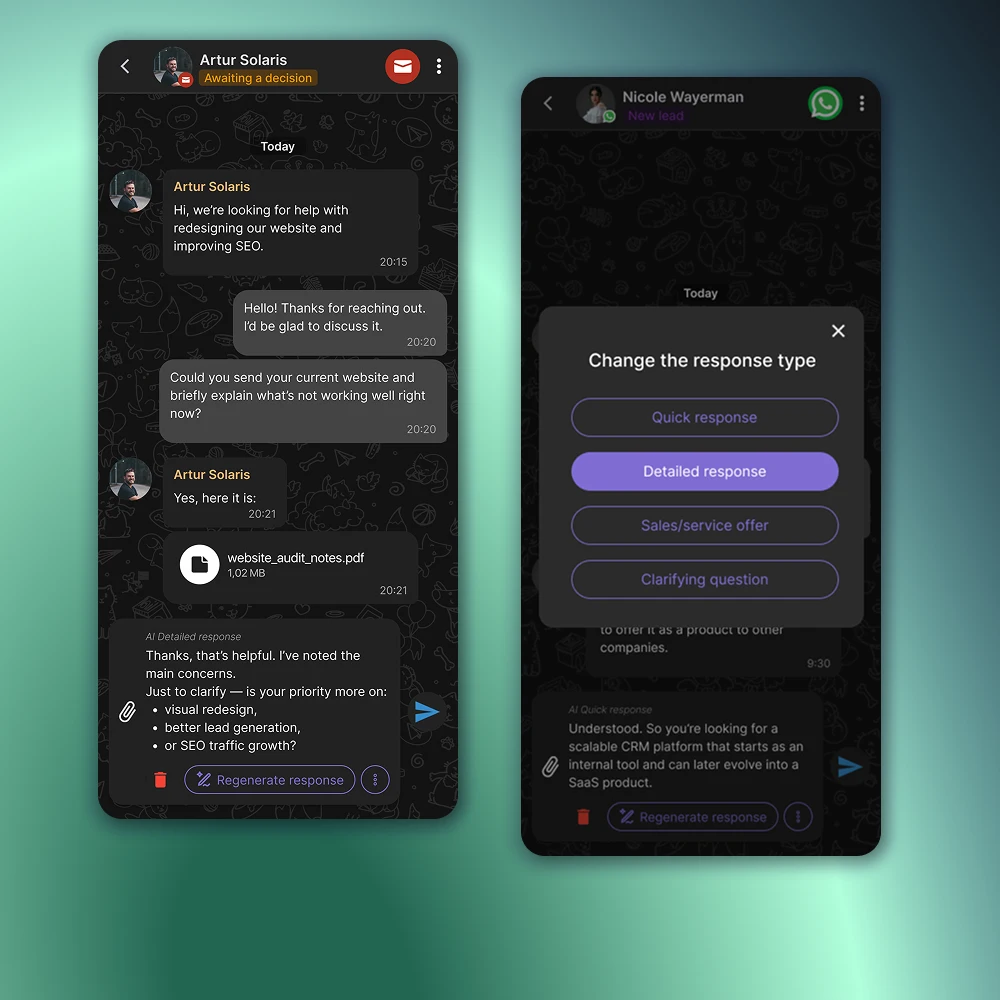

AI чат-боти та помічники. Представте корпоративного асистента, який відповідає на запитання співробітників щодо внутрішніх політик компанії – або клієнтського бота в банку, який консультує щодо продуктів. Такі системи повинні давати точні відповіді у будь-якому сценарії діалогу, включаючи провокаційні та нестандартні запити. AI/ML QA Engineer перевіряє стійкість моделі, виявляє галюцинації та тестує граничні випадки до того, як система потрапить до користувачів.

RAG-системи. Компанії все частіше будують внутрішні бази знань на основі LLM: співробітник ставить питання – система знаходить потрібні документи та формулює відповідь. Якість такого рішення залежить не тільки від того, як модель генерує текст, а й від того, чи правильні документи вона знаходить. AI / ML QA Engineer тестує обидва компоненти і перевіряє, що джерела відповідають контексту запиту.

Рекомендаційні системи. Стрімінговий сервіс рекомендує фільми, маркетплейс – товари, HR-платформа – вакансії. AI/ML QA Engineer перевіряє, що рекомендації релевантні, не містять зсувів (bias) та відповідають бізнес-логіці продукту.

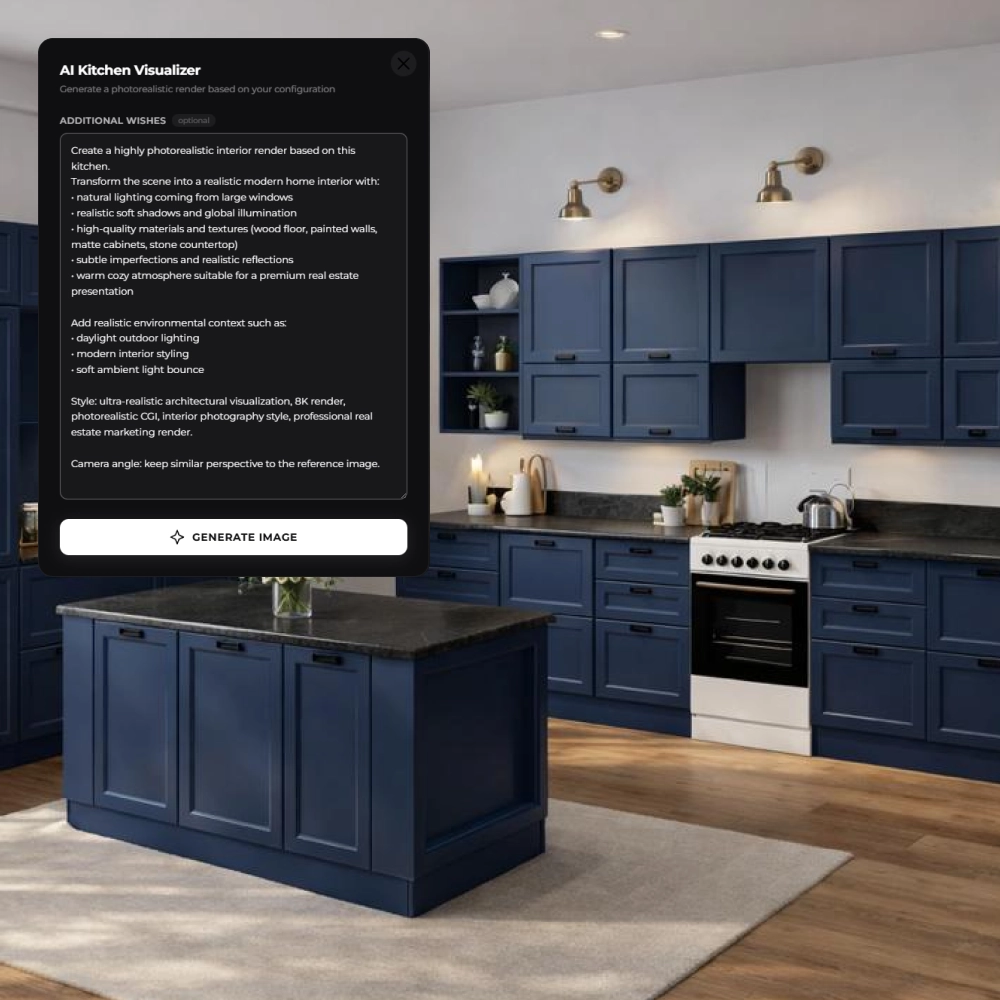

Рішення з урахуванням комп'ютерного зору (computer vision). Моделі, що розпізнають дефекти на виробництві, верифікують документи або аналізують медичні знімки, тестуються на точність класифікації та стійкість до зміни умов – освітлення, кута зйомки, якості зображення.

Чому варто найняти AI / ML QA Engineer у CortexIntellect

Спеціалізація на AI, а чи не адаптація класичного QA. Наші спеціалісти працюють саме з AI-системами - вони не переносять стандартні QA-практики на ML-продукти, а застосовують підходи, розроблені під специфіку недетермінованих моделей.

Розуміння всього AI-стеку. QA Engineer, який не розуміє, як влаштована модель і на яких даних вона навчена, тестує наосліп. Наші фахівці працюють у зв'язці з ML Engineer та Data Engineer і знають, де шукати проблеми на кожному рівні системи.

Досвід across різних масштабів та індустрій. Наші фахівці тестували AI-системи від MVP-продуктів до enterprise-рішень з мільйонами користувачів – у фінтеху, медтеху, e-commerce та SaaS, і розуміють, як вимоги до якості змінюються залежно від контексту та навантаження.

Гнучкий формат підключення. Разове тестування перед релізом, підтримка на певному етапі або довгостроковий супровід – формат визначається завданням, а не стандартним пакетом послуг.

Найміть AI / ML QA Engineer для вашого проекту

Зв'яжіться з нами – обговоримо вимоги до якості вашої AI-системи, підберемо спеціаліста під завдання та запустимо роботу за короткий термін.

Найчастіші запитання

-

Чим AI/ML QA відрізняється від звичайного тестування?

У класичному тестуванні помилка відтворюється: той самий input завжди дає той самий output. В AI-системах поведінка моделі недетермінована – результат залежить від даних, контексту та імовірнісної природи моделі. AI/ML QA Engineer працює з метриками якості, оціночними вибірками та спеціалізованими інструментами, яких немає у стандартному QA-процесі.

-

На якому етапі розробки можна підключати QA Engineer?

Що раніше, то краще. Ідеально – на етапі підготовки даних до початку навчання моделі. Це дозволяє виявити проблеми з якістю датасету перед тим, як вони вплинуть на результат. Якщо модель вже навчена, QA Engineer підключається перед релізом - але в цьому випадку частину проблем доведеться вирішувати ретроспективно.

-

Як вимірюється результат QA Engineer?

Результат фіксується у конкретних метриках: accuracy, hallucination rate, latency, error rate. До початку роботи ми погодимо цільові значення цих показників, а після тестування надаємо звіт з результатами та рекомендаціями.

-

Чи можна найняти QA Engineer лише на один етап – наприклад перед релізом?

Так. Фахівця можна підключити точково: на LLM QA перед запуском, на тестування навантаження або на налаштування моніторингу в production. Формат співробітництва обговорюється під конкретне завдання.

-

Що відбувається після запуску системи в production?

Поведінка AI-системи змінюється в міру зміни вхідних даних і сценаріїв користувача. QA Engineer налаштовує моніторинг, який відстежує ключові метрики в реальному часі та сигналізує про деградацію якості до того, як це стає помітним для користувачів.