Data Engineer

Що робить Data Engineer

Щодня в диджитал продуктах з'являються тисячі нових записів: користувачі клацають, оформляють замовлення, відправляють запити, системи пишуть логи - все це осідає в базах, файлах і чергах повідомлень і не приносить жодної користі до тих пір, поки немає системи, яка збирає ці дані, очищає їх.

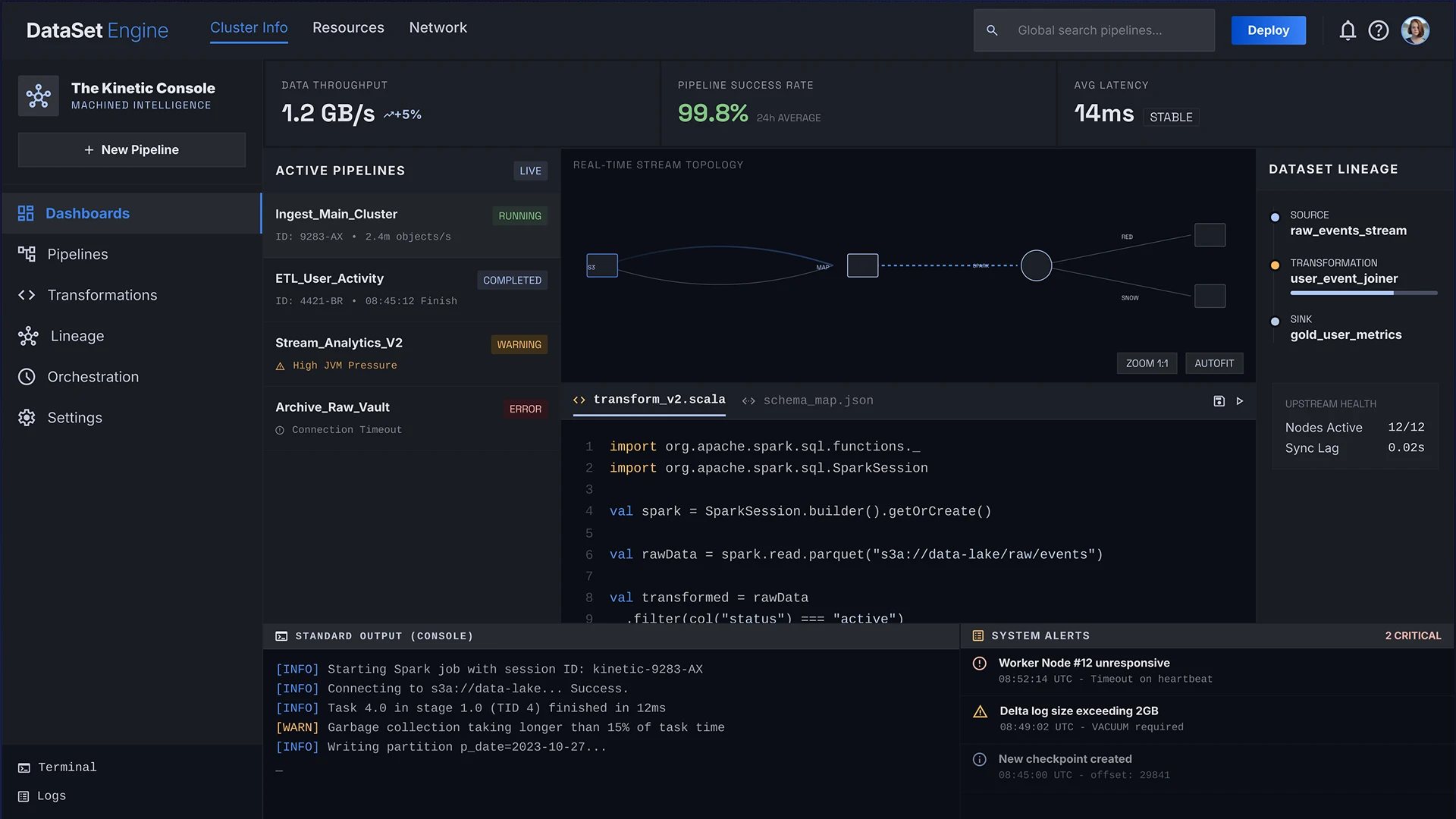

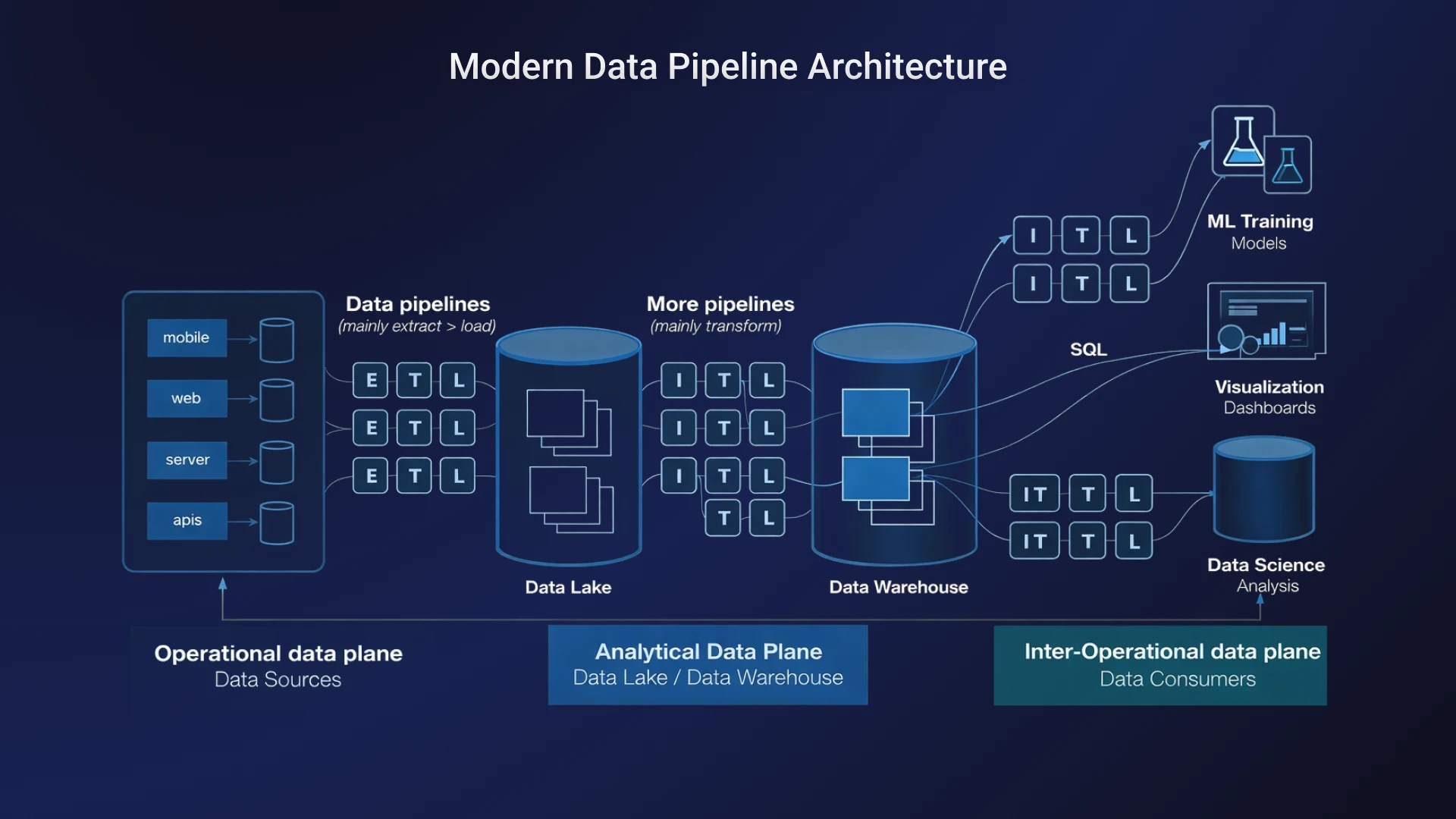

Цим займається Data Engineer: він розробляє автоматичні конвеєри (data pipelines) для збору, перетворення та зберігання даних із розрізнених джерел та забезпечує їх доступність для аналітичних систем, моделей машинного навчання (ML-моделей) та AI-додатків.

У ланцюжку розробки AI-систем Data Engineer стоїть першим: він збирає та готує дані, які потім розмічує Data Annotator, використовує ML Engineer для навчання моделей, а AI Developer для створення готових AI-додатків. Без Data Engineer цей ланцюжок просто не запускається.

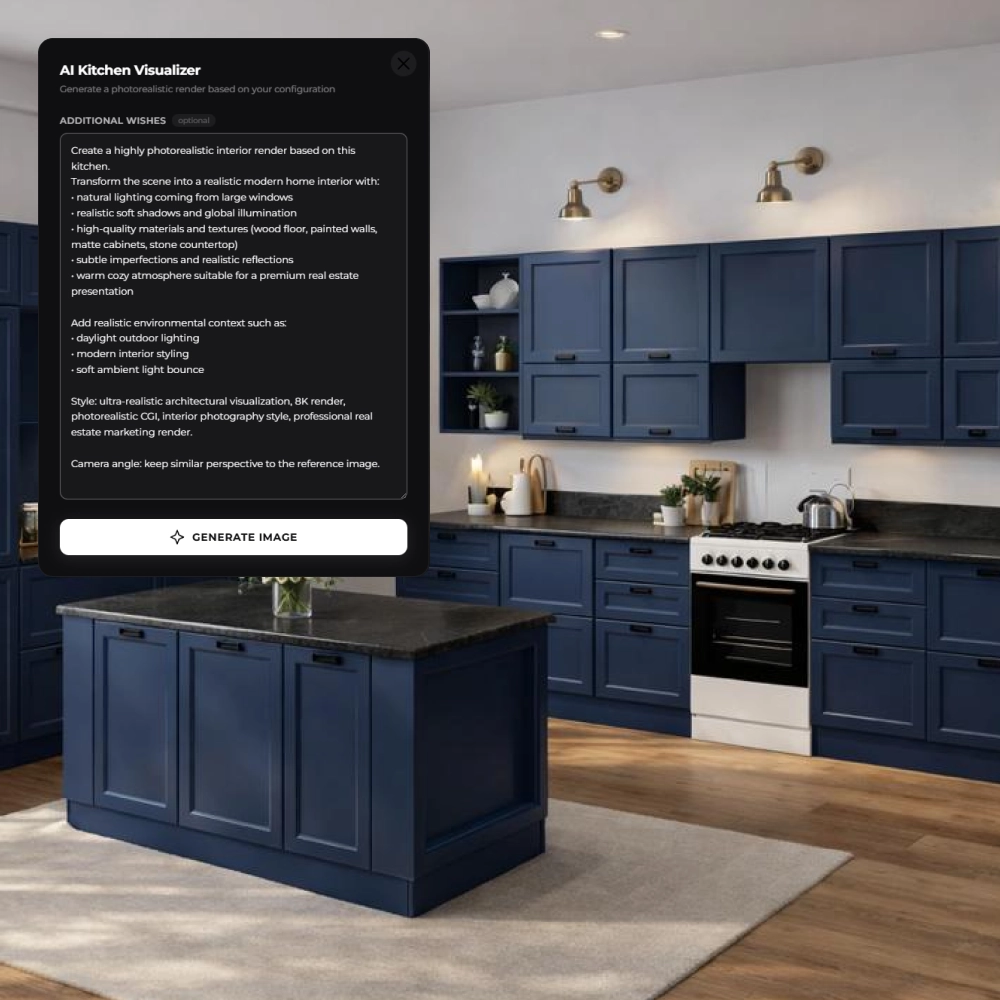

Виберіть разробника

Конвеєр обробки даних

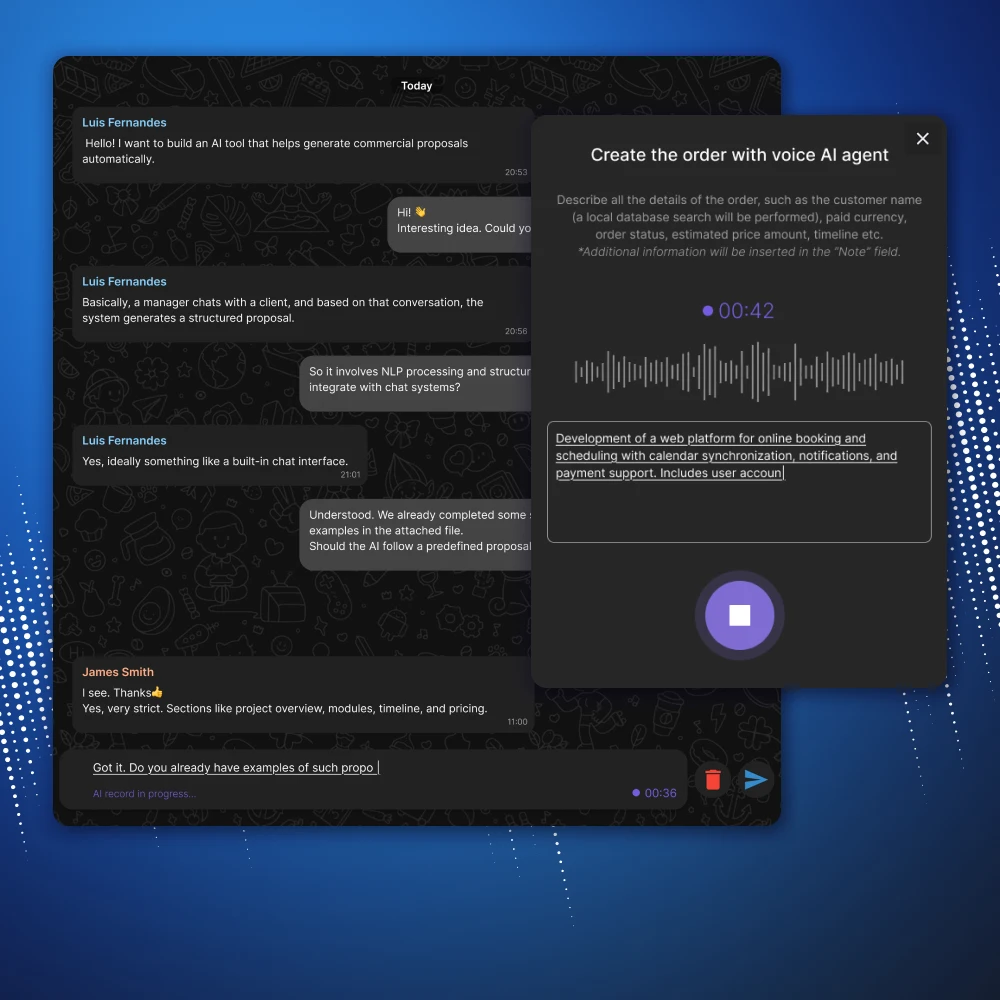

Data Engineer працює з даними на кожному етапі їх життєвого циклу - від моменту появи до моменту, коли вони готові до використання. Ось як улаштований цей шлях.

Збір даних (Data Collection). Дані рідко живуть в одному місці: вони надходять із програмних інтерфейсів (API) зовнішніх сервісів, реляційних та нереляційних (NoSQL) баз даних, лог-систем та стрімінгових платформ, і завдання Data Engineer – визначити всі ці джерела, налаштувати конектори та забезпечити регулярний збір без втрат.

Завантаження даних (Data Ingestion). Зібрані дані передаються до системи обробки за одним із двох сценаріїв: пакетне завантаження за розкладом (batch-обробка), коли дані накопичуються та обробляються порціями, або потокове завантаження (streaming ingestion) у реальному часі, коли кожна подія обробляється в міру надходження. Data Engineer вибирає відповідну модель, виходячи з вимог проекту.

Обробка даних (Data Processing). Сирі дані майже ніколи не придатні для прямого використання: на цьому етапі забираються дублікати та помилки, формати наводяться до єдиного стандарту, дані збагачуються із суміжних джерел та перетворюються на структури, зручні для аналізу.

Зберігання даних (Data Storage). Оброблені дані розміщуються у сховищах, оптимізованих під конкретні завдання: озера даних (data lakes) підходять для великих обсягів сирих та напівструктурованих даних, сховища даних – для структурованих даних та аналітичних запитів. Data Engineer проектує схеми зберігання з урахуванням швидкості доступу, вартості та масштабованості.

Доставка даних (Data Delivery). Фінальний етап – привести дані до формату, придатного конкретного споживача. Data Engineer формує готові набори даних, налаштовує доступ до API і стежить за тим, щоб дані залишалися актуальними.

Ключові завдання Data Engineer

Ось що входить до зони відповідальності Data Engineer на проекті.

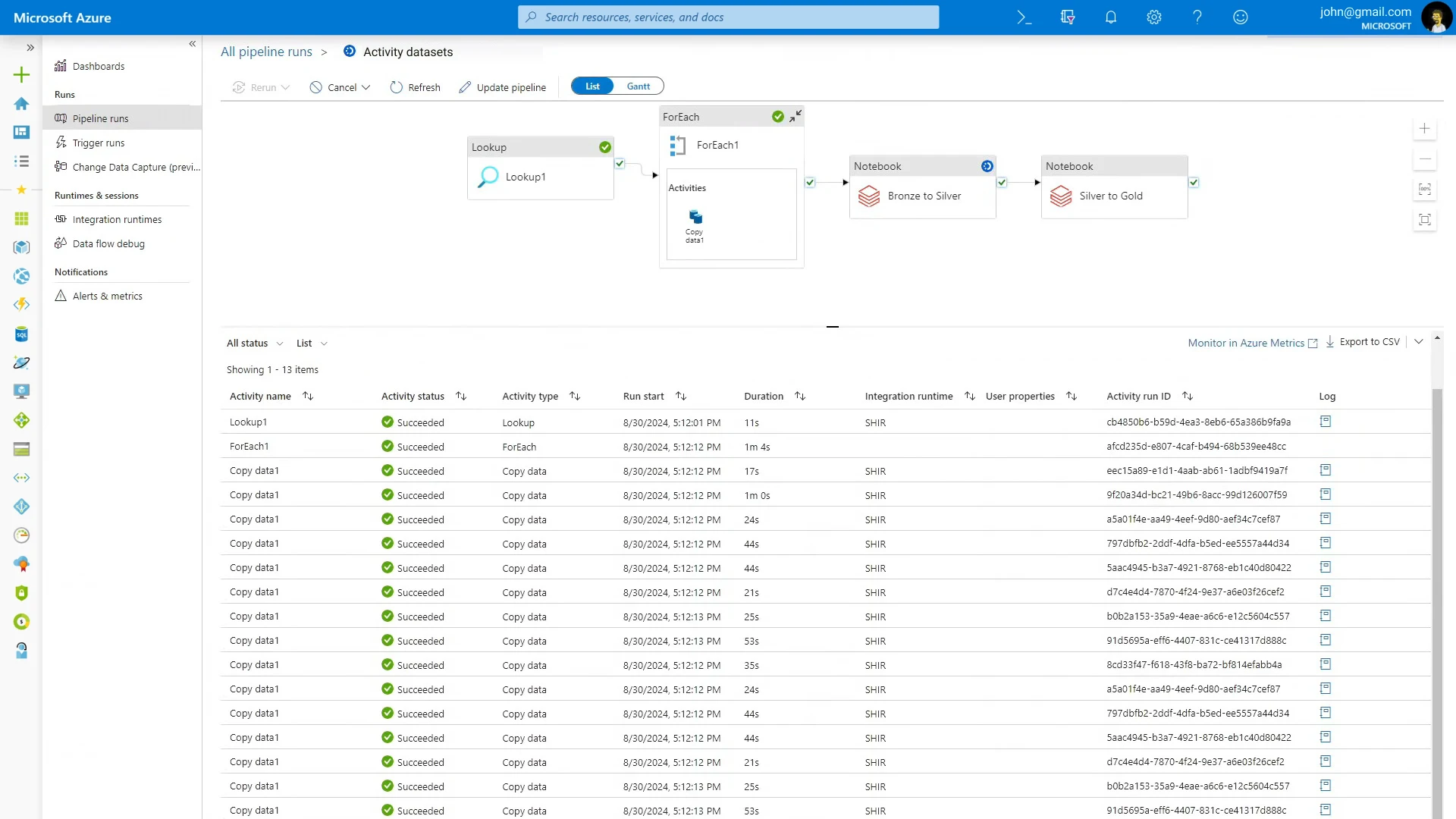

Розробка ETL-конвеєрів.

Data Engineer налаштовує автоматичне вилучення даних із джерел, їх трансформацію за заданими правилами та завантаження в цільові сховища за розкладом або в режимі реального часу.

Обробка big data.

Коли мова йде про терабайт і петабайт, Data Engineer проектує розподілені обчислення на Apache Spark і PySpark, оптимізує запити і управляє ресурсами кластерів так, щоб система справлялася з навантаженням без втрати продуктивності.

Інтеграція джерел.

Data Engineer підключає до єдиного потоку реляційні бази (PostgreSQL, MySQL), нереляційні сховища (NoSQL: MongoDB, Cassandra), зовнішні API, черги повідомлень та агрегатори логів.

Підготовка training datasets.

Data Engineer формує навчальні вибірки потрібного обсягу та якості, працює у зв'язці з Data Annotator і забезпечує їх регулярне оновлення у міру накопичення нових даних.

Проектування data lakes та data warehouses.

Data Engineer проектує схему зберігання, керує розбивкою даних на розділи, контролює їх якість та налаштовує права доступу.

Оптимізація обробки даних.

Data Engineer аналізує вузькі місця, перепроектує схеми та впроваджує кешування та інкрементальну обробку там, де це скорочує час доставки даних та знижує обчислювальні витрати.

Технології, з якими працює Data Engineer

Стек Data Engineer – один із найширших серед технічних фахівців. Ось що зазвичай входить до арсеналу інженера даних:

Мови програмування:

- Python – основна мова для роботи з даними;

- SQL – до роботи з реляційними сховищами та аналітичними запитами;

- Java та Scala – для високонавантажених компонентів на Apache Spark.

Інструменти обробки даних:

- Apache Spark та PySpark забезпечують розподілену обробку великих обсягів даних;

- Pandas – гнучкий інструмент для перетворення даних у аналітичних завданнях.

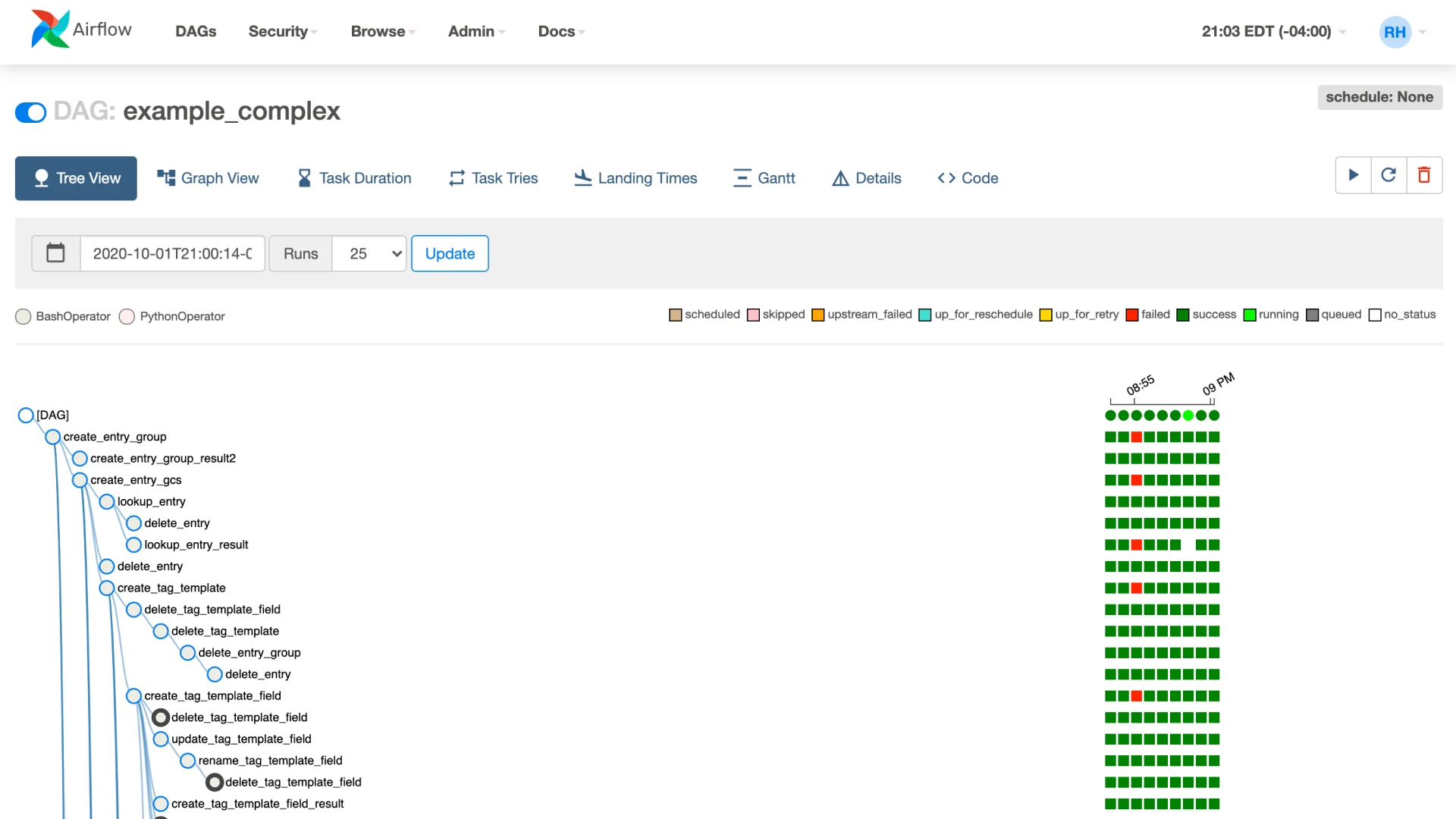

Оркестрація конвеєрів (pipeline orchestration):

Apache Airflow і Prefect дозволяють описувати залежності між завданнями, керувати розкладом та моніторити виконання складних багатокрокових процесів – так, щоб збій в одному місці не упускав всю систему.

Потокова передача даних (data streaming):

Apache Kafka забезпечує надійну передачу подій у реальному часі між компонентами системи з високою пропускною здатністю та мінімальними затримками.

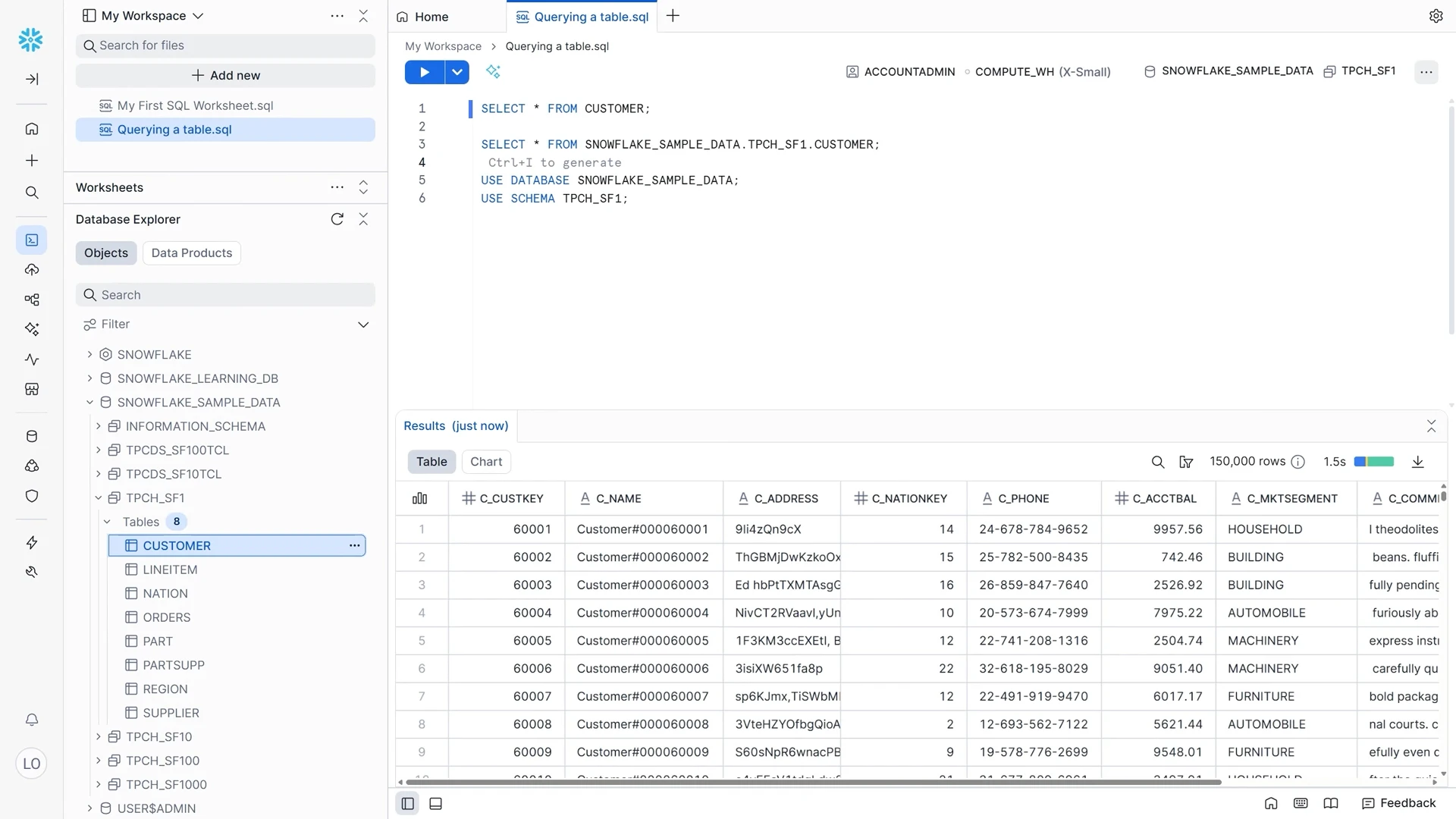

Зберігання даних (data storage):

- Snowflake , BigQuery та Amazon Redshift – хмарні сховища даних для аналітичних запитів, що масштабуються.

- Data lakes використовуються для зберігання сирих даних у вихідному форматі – до їх обробки та структурування.

Де застосовується data engineering

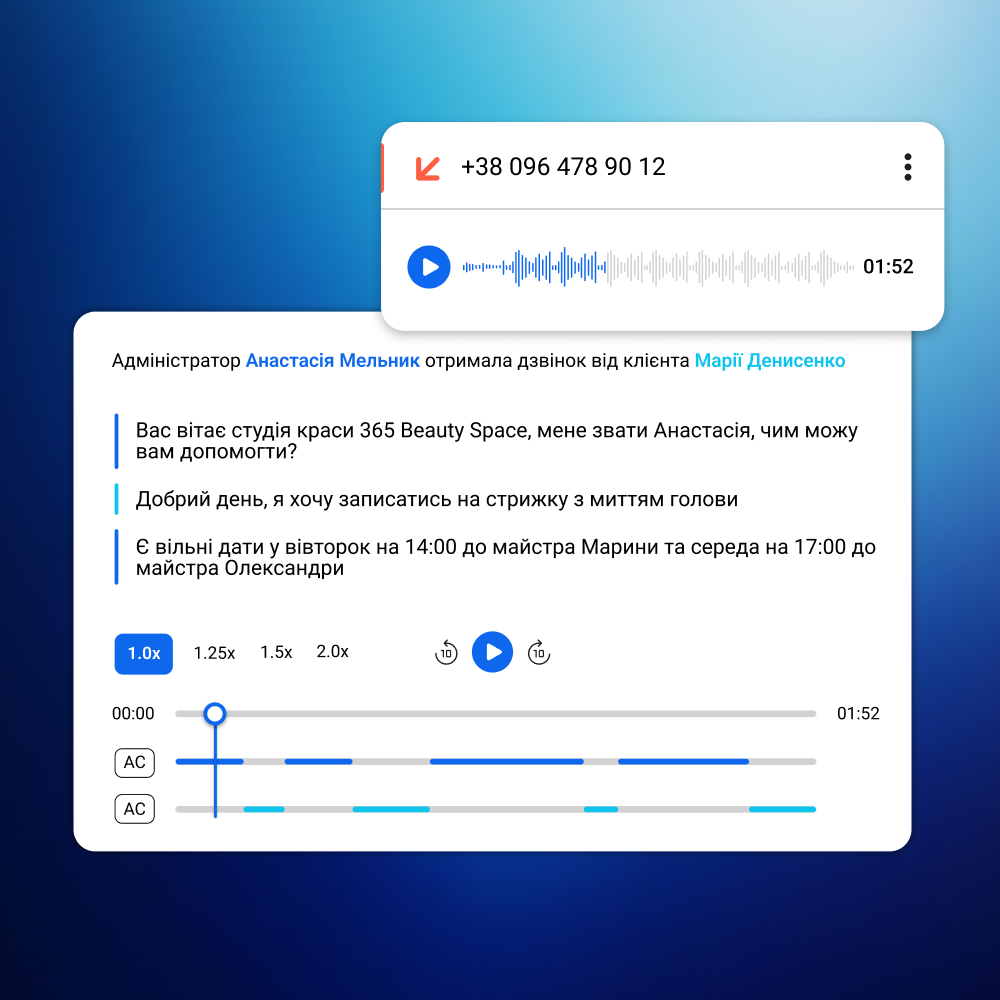

Data engineering є основою більшості продуктів, які працюють із даними у промислових масштабах. Ось кілька прикладів того, як це виглядає практично.

Аналітичні платформи. Такі компанії, як Uber чи Airbnb, обробляють мільярди подій на день – сесії, дії, конверсії, геолокації. Data Engineer будує pipeline, який агрегує ці дані з безлічі точок торкання та постачає їх у дашборди в актуальному стані, без ручного експорту та затримок.

Машинне навчання. Коли Spotify навчає моделі для персональних плейлистів або Tesla для автопілота, в основі лежать терабайти підготовлених даних. Data Engineer формує training datasets потрібного об'єму, очищає їх від шуму та вибудовує процес регулярного оновлення вибірок у міру надходження нових даних.

Рекомендаційні системи. Netflix і Amazon будують свої рекомендації на потоковій обробці дій користувача в реальному часі. Data Engineer створює streaming pipelines, які захоплюють події – перегляди, кліки, покупки – і передають їх у рекомендаційний двигун із мінімальною затримкою.

Маркетингова аналітика. Великі рітейлери на кшталт Zalando чи ASOS керують десятками рекламних каналів одночасно. Data Engineer зводить дані з платного трафіку, соціальних мереж, email та партнерських програм у єдину модель атрибуції та забезпечує єдину точку доступу до всієї маркетингової статистики.

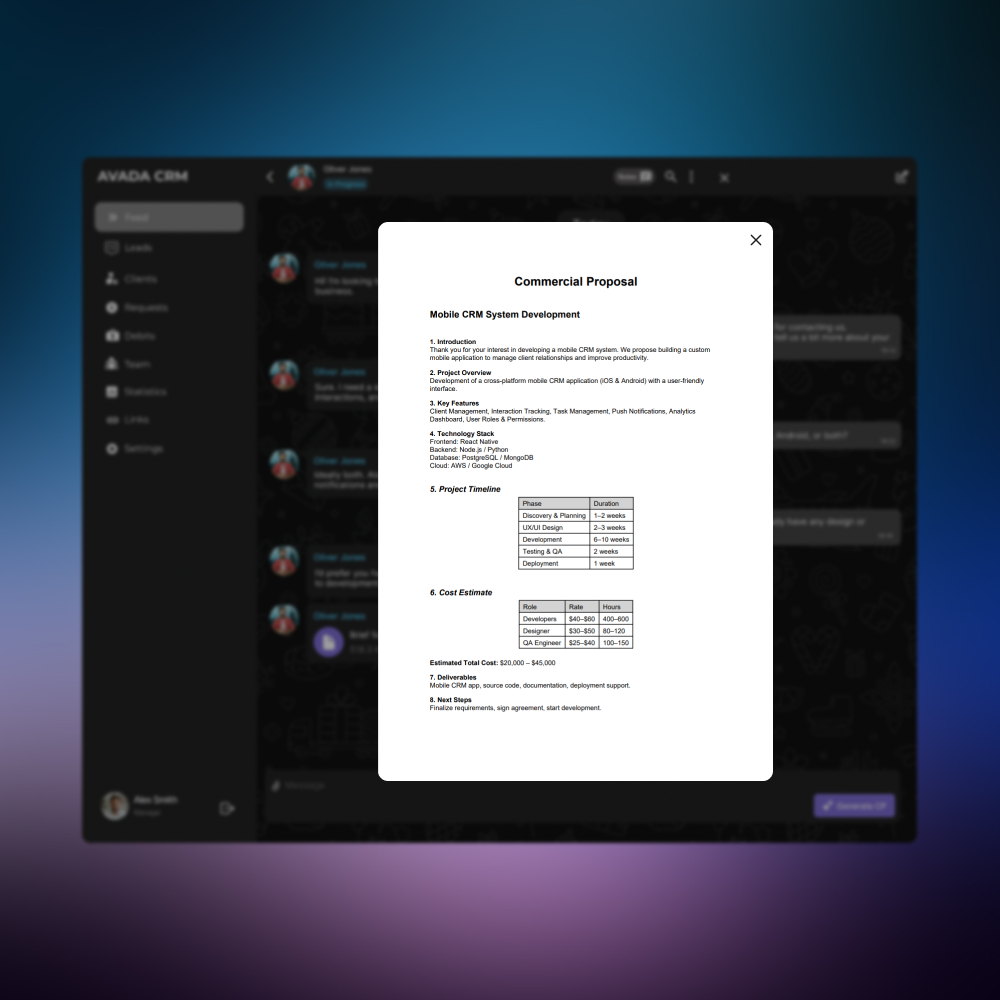

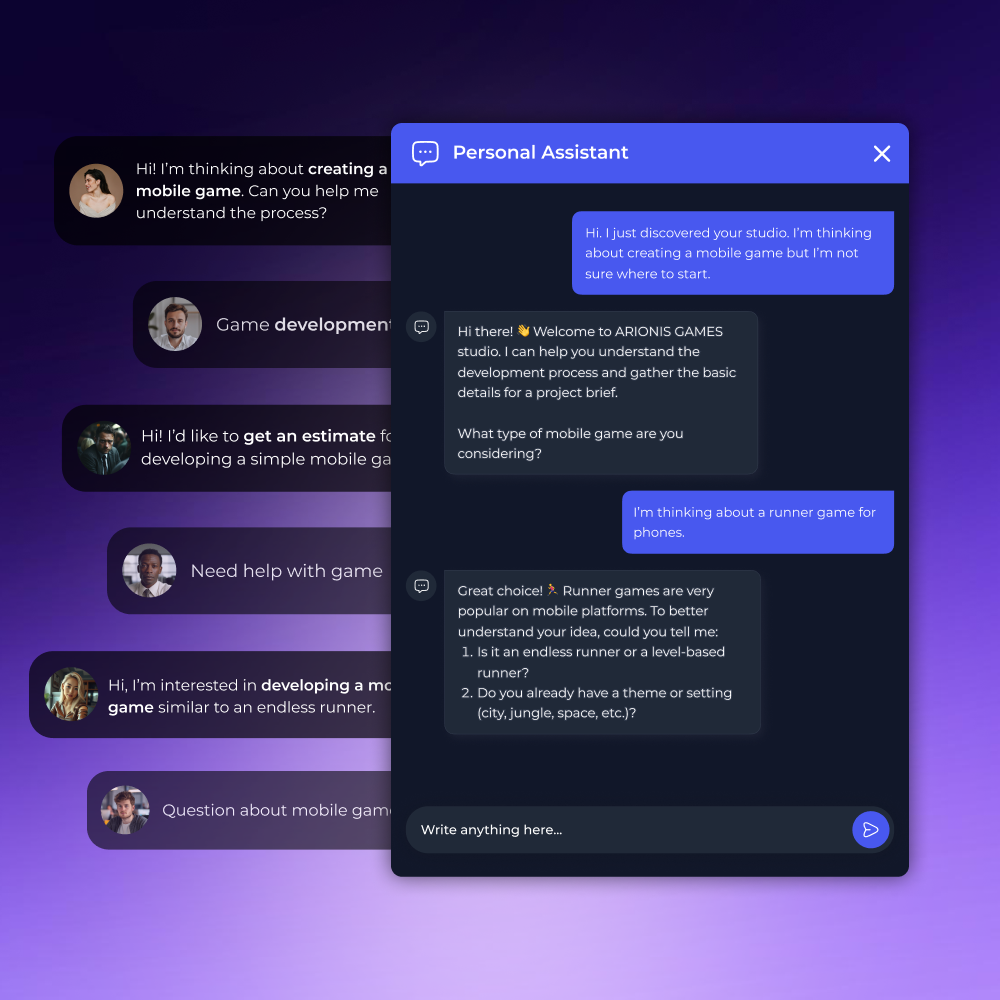

Чому варто найняти Data Engineers у CortexIntellect

Досвід розробки data pipelines. Ми проектуємо як batch-, так і streaming-конвеєри та вибираємо архітектуру під конкретні вимоги до навантаження та затримок.

Експертиза в AI та ML-проектах. Наші фахівці розуміють, які дані потрібні моделі та в якому форматі, і готують їх без ітераційних погоджень із командою.

Сучасний технологічний стек. Apache Spark, Airflow, Kafka, Snowflake, BigQuery, AWS, GCP, Azure – ми працюємо з інструментами, які використовують технологічні компанії рівня enterprise.

Досвід роботи із великими даними. Ми успішно реалізовували проекти, де обсяг даних вимірюється терабайтами, а pipeline має справлятися з піковим навантаженням без втрати продуктивності.

Гнучка модель співробітництва. Фахівця можна підключити на одноразове завдання, конкретний етап проекту або довгостроковий супровід інфраструктури даних.

Найміть Data Engineer для вашого проекту

Зв'яжіться з нами – обговоримо архітектуру даних, підберемо спеціаліста під завдання та запустимо роботу за короткий термін.

Найчастіші запитання

-

Скільки часу займає підключення Data Engineer до проекту?

Фахівця можна підключити за короткий термін: після первинної консультації ми підбираємо інженера під завдання та узгоджуємо старт. Найчастіше робота починається протягом кількох днів із моменту звернення.

-

На якому етапі розвитку продукту потрібний Data Engineer?

Що раніше, то краще. Якщо у продукті вже накопичуються дані з кількох джерел, але єдиної системи їх збору та обробки немає – це сигнал, що Data Engineer потрібний зараз. Відкладати наймання до появи ML-команди або аналітики не варто: без готової інфраструктури їхня робота просто не запуститься.

-

У чому різниця між разовим завданням та довгостроковою співпрацею?

Разовий формат підходить для конкретного результату: налаштувати pipeline, спроектувати datawarehouse, провести аудит існуючої інфраструктури. Довгостроковий супровід – для компаній, яким важливо, щоб інфраструктура даних розвивалася разом із продуктом та не вимагала окремого пошуку фахівця при кожному новому запиті.

-

Чи впорається фахівець із нашим обсягом даних?

Наші інженери працюють з обсягами на рівні терабайтів та проектують системи, розраховані на пікове навантаження. Архітектура підбирається під конкретні параметри проекту швидкість доставки даних, частота оновлень, вимоги до масштабованості.

-

Чи потрібно нам самим розумітися на стеку технологій, щоб поставити завдання?

Ні. Для старту достатньо описати бізнес-завдання: звідки беруться дані, хто і як їх використовує, який результат потрібний на виході. Вибір інструментів та архітектурні рішення – зона відповідальності інженера. Первинна консультація для цього і потрібна.