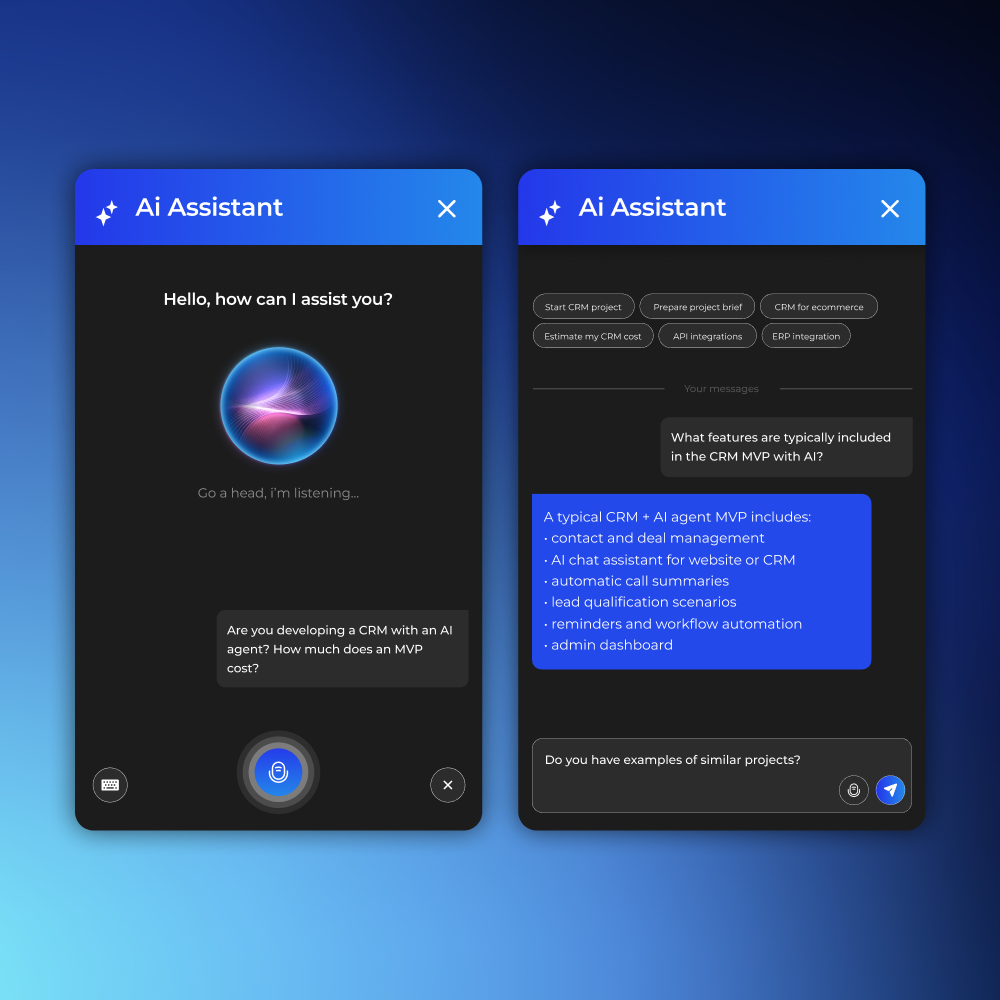

Сьогодні AI-асистенти, AI-компаньйони, голосові помічники та AI-чати створюються значно швидше, ніж ще кілька років тому. Завдяки AI-assisted development та так званому vibe coding команди можуть запускати MVP буквально за тижні. Але разом з цим з'явилася нова проблема: більшість таких продуктів тестуються за старими підходами QA, які вже не покривають реальні ризики AI-систем.

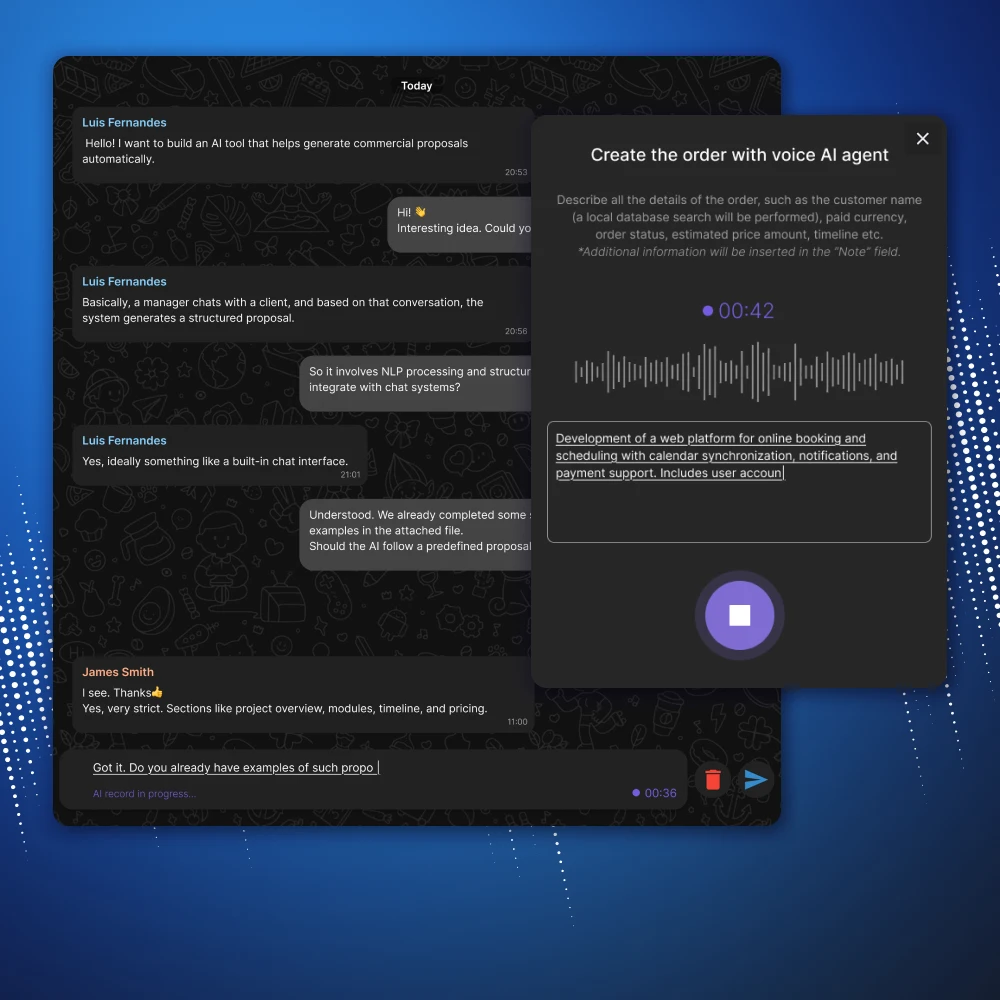

Якщо раніше достатньо було перевірити форми, API і базові сценарії користувача, то тепер необхідно тестувати контекст діалогу, емоційне сприйняття, голосову взаємодію, стабільність AI-відповідей і навіть відчуття «живого спілкування». У AI-продуктах користувач оцінює як технічну стабільність, а й те, наскільки комфортно і з ним взаємодіє система.

У цій статті розглянемо практичний чек-лист тестування AI-чату та голосового AI-асистента, а також основні проблеми, які найчастіше виникають у подібних продуктах.

Чому AI-програми вимагають нового підходу до QA

Головна особливість AI-продуктів – їхня поведінка не завжди повністю детермінована. Навіть за однакових умов AI може відповідати трохи по-різному, змінювати формулювання, втрачати контекст або несподівано уникати теми.

Через це класичне тестування вже недостатньо.

Тепер QA-команді доводиться перевіряти:

- якість та адекватність AI-відповідей;

- утримання контексту діалогу;

- емоційне сприйняття;

- швидкість реакції AI;

- стабільність voice/chat interaction;

- поведінка при поганому інтернеті;

- роботу довгих діалогів;

- реакцію на агресивні, емоційні чи нестандартні повідомлення.

Фактично сучасне тестування AI-додатків – це вже суміш:

- QA,

- UX,

- conversational design,

- навантажувального тестування,

- психології взаємодії,

- AI behavior testing.

Що необхідно тестувати в AI-чаті

Реєстрація та швидкий старт

Для AI-продуктів важливо мінімізувати тертя на старті. Користувач повинен максимально швидко потрапити до діалогу з AI. Тому необхідно перевіряти:

- email login / Google login / Apple login;

- відновлення доступу;

- коректність помилок;

- адаптацію форм на мобільних пристроях.

Але технічної перевірки тут замало. Потрібно оцінювати і UX:

- не надто довгий onboarding;

- чи не виникає відчуття складності;

- чи хочеться продовжити використання;

- чи немає зайвих кроків перед початком спілкування.

Для AI-програм «швидкість початку розмови» безпосередньо впливає на утримання користувачів.

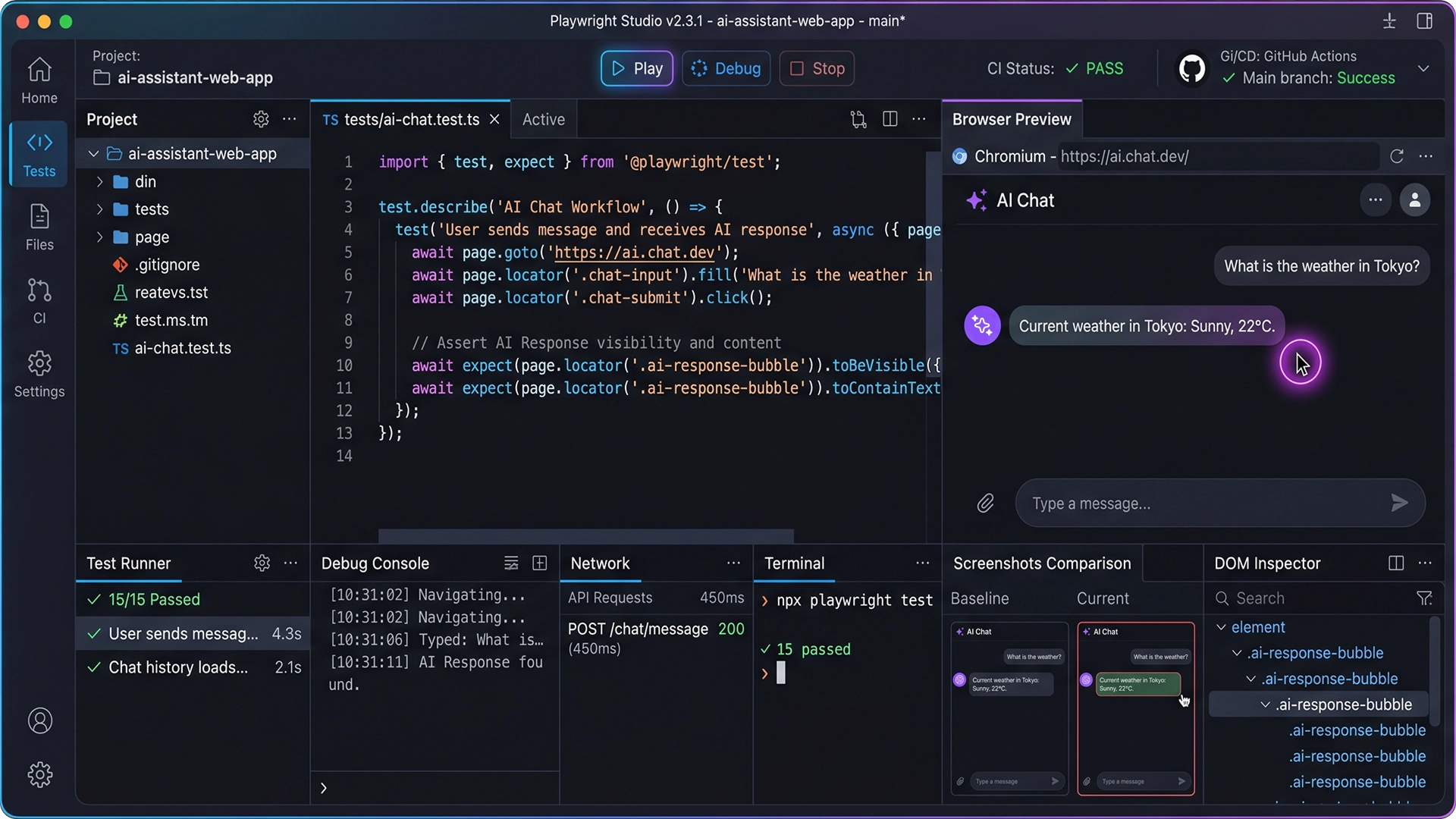

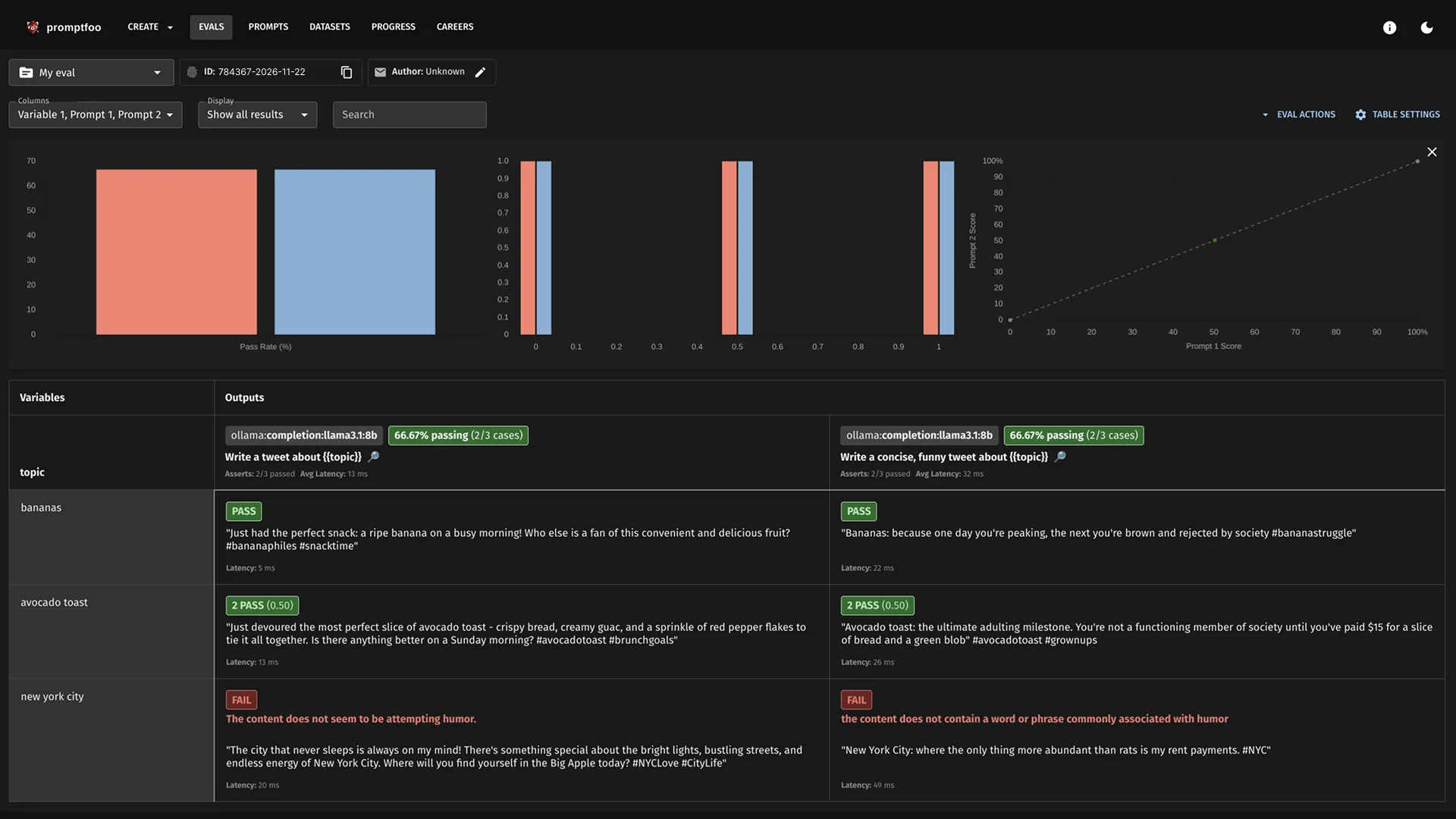

Перевірка AI-відповідей

Це вже одна із найскладніших частин тестування. AI необхідно перевіряти як на коректність, а й у якість взаємодії.

Важливо аналізувати:

- чи відповідає AI на тему;

- чи утримує контекст;

- чи не повторюється;

- чи не генерує токсичні відповіді;

- чи не перетворюється діалог на «роботизований»;

- ставить AI уточнюючі питання;

- чи не пише надто довгі відповіді;

- чи не змішує мови;

- чи не генерує безглуздий текст або набір символів.

Дуже часто AI-система виглядає стабільно технічно, але повністю провалюється саме на рівні сприйняття спілкування.

Особливо це критично для:

- AI-компаньйонів;

- AI-консультантів;

- AI-психологів;

- voice assistants;

- AI support systems.

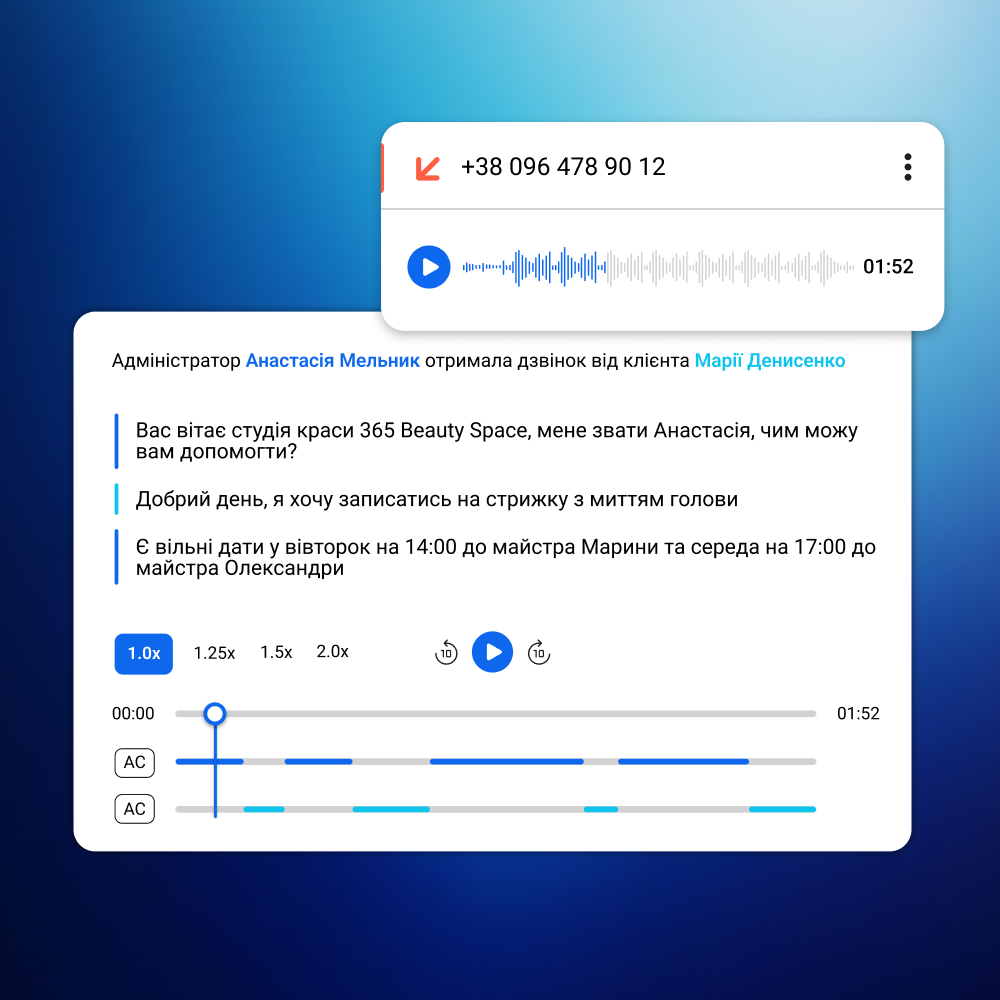

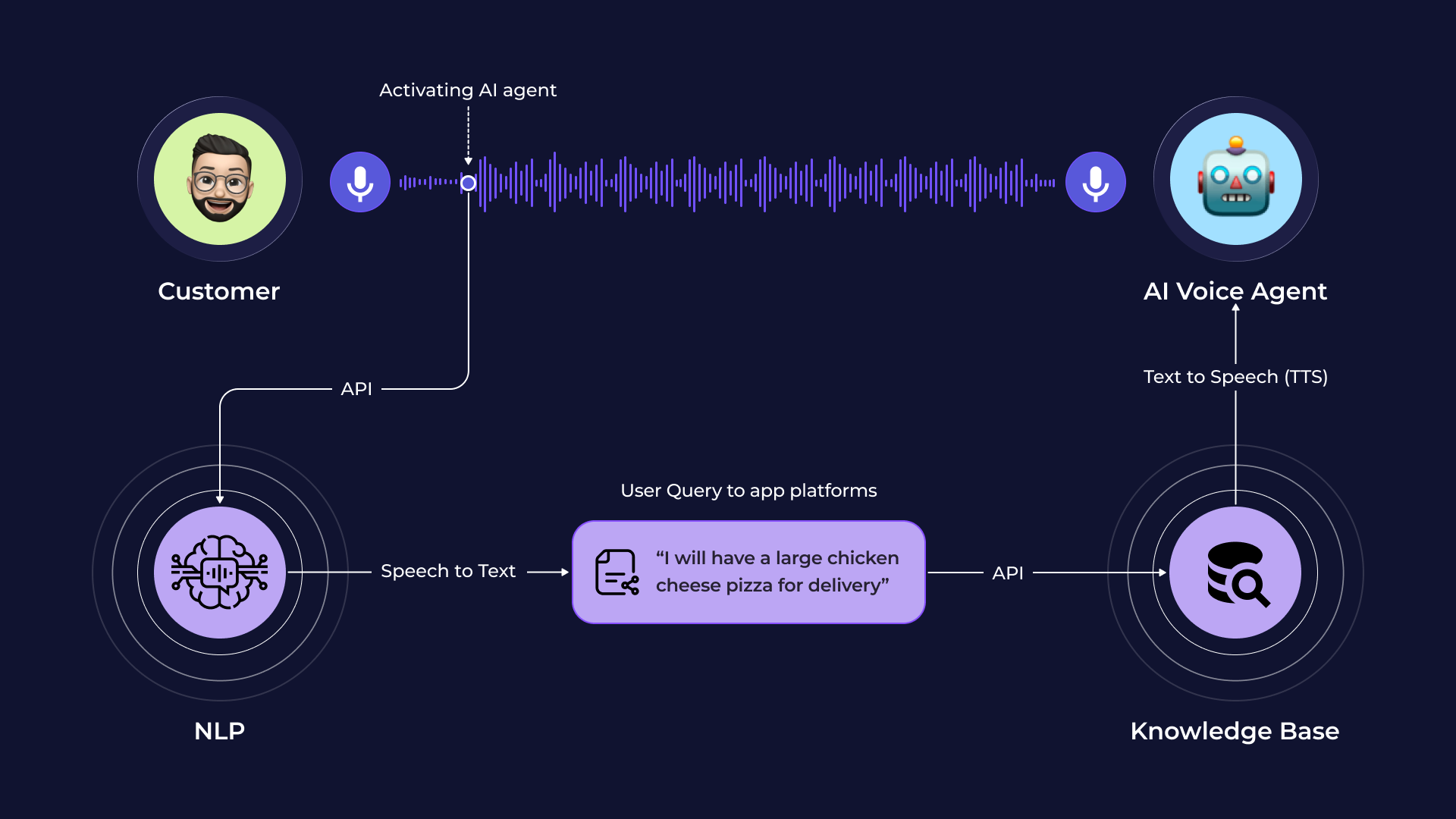

Голосова взаємодія

Voice AI сьогодні – окрема категорія складного тестування. Навіть якщо текстовий чат працює ідеально, голосовий режим може створювати величезну кількість проблем:

- роботизоване звучання;

- затримки між репліками;

- погана синхронізація губ у аватара;

- помилки розпізнавання мови;

- неправильні акценти;

- обриви аудіо;

- різкі стрибки гучності;

- втрата мікрофона;

- проблеми при перемиканні мережі.

Особливо важливо перевіряти відчуття природності спілкування.

Користувач дуже швидко помічає:

- неприродні паузи;

- надто «машинний» голос;

- дивні інтонації;

- емоційно невідповідні реакції.

Саме такі дрібниці часто ламають довіру до продукту сильніше, ніж звичайні баги інтерфейсу.

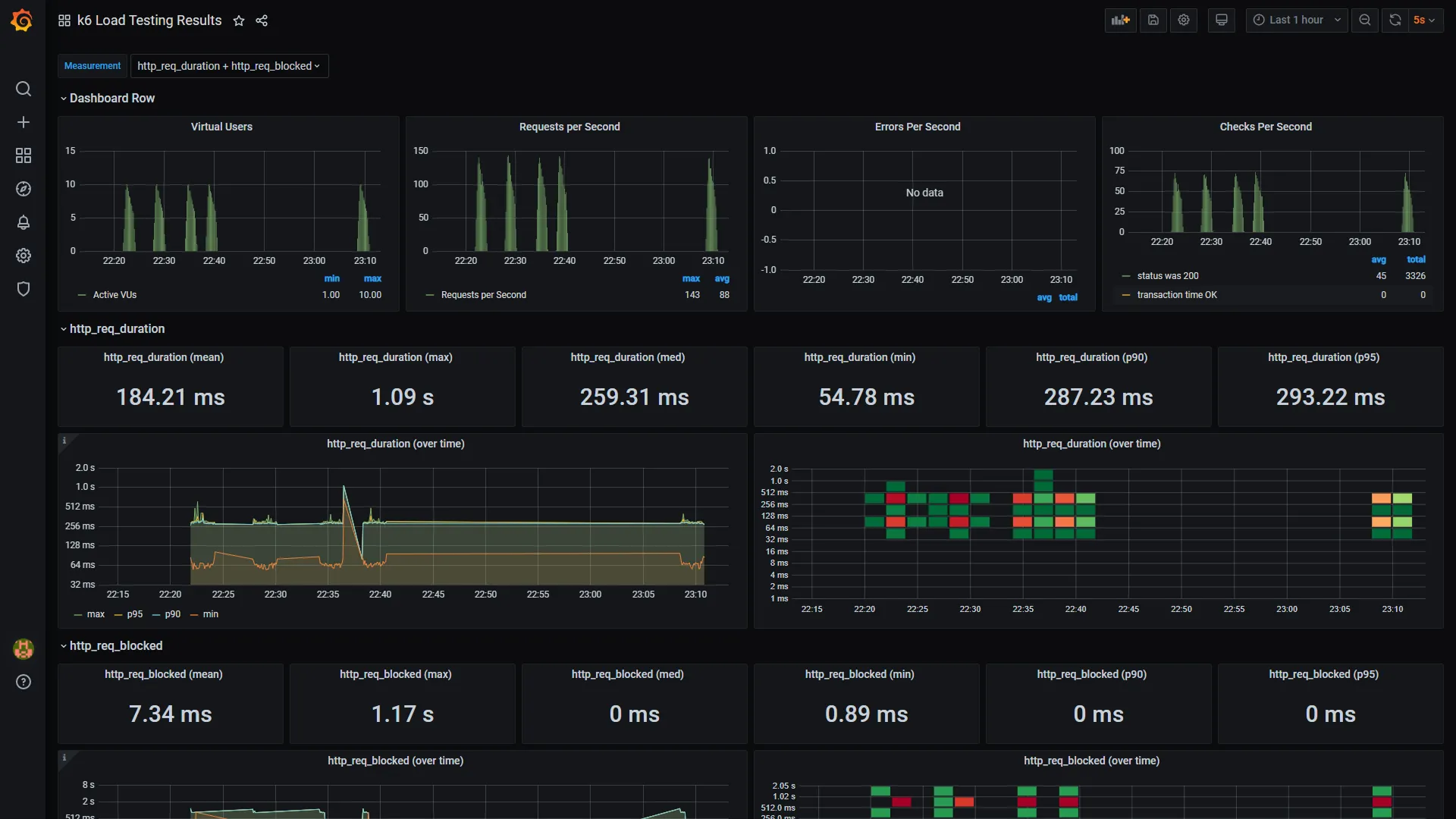

Edge-case тестування AI-додатків

Одна з головних помилок сучасних команд – тестувати лише «ідеальні сценарії». AI-продукти обов'язково потрібно перевіряти у нестандартних умовах.

Наприклад:

- поганий інтернет;

- різке перемикання між сторінками;

- довгі повідомлення;

- потік повідомлень поспіль;

- emoji;

- copy-paste великих текстів;

- емоційні повідомлення;

- агресивні повідомлення;

- порожні повідомлення;

- перемикання між Wi-Fi та мобільною мережею.

Саме тут найчастіше з'являються:

- втрата контексту;

- зависання;

- дублювання повідомлень;

- нескінченний loading;

- втрата історії чату;

- помилки голосового режиму.

UX-проблеми AI-систем

У AI-продуктах UX став значно важливішим, ніж у звичайних веб-сервісах. Навіть дрібні проблеми можуть руйнувати відчуття «живого спілкування».

Необхідно перевіряти:

- чи не стрибає чат;

- чи не перекриває клавіатура поле введення;

- чи немає лагів при генерації;

- чи не блимає інтерфейс;

- чи правильно працюють кнопки;

- чи не ламається мобільна адаптація;

- чи немає горизонтального скролла;

- чи зручно вести довгий діалог.

AI-система повинна сприйматися спокійно, плавно та природно.

Будь-який дратівливий UX починає посилюватись у кілька разів, коли користувач знаходиться у довгому діалозі.

Найдоцінніша частина — емоційне тестування

Сучасні AI-асистенти перевіряються вже не лише технічно. Виникає новий тип QA – емоційне тестування.

Команда повинна ставити собі запитання:

- чи хочеться продовжити спілкування;

- чи викликає AI довіру;

- чи не дратують відповіді;

- чи створюється відчуття підтримки;

- чи відчувається «жвавість» діалогу;

- чи не стає AI нав'язливим;

- чи допомагає інтерфейс розслабитися;

- чи не перевантажує система користувача.

Це особливо важливо для:

- AI companions;

- AI therapy-like products;

- wellness AI apps;

- support assistants;

- conversational AI systems.

Фактично сучасні AI-продукти вже тестуються не тільки як software, але і як форма досвіду користувача.

Які помилки вважаються критичними

Для AI voice/chat систем критичними вважаються:

- білий екран;

- вильоти;

- зависання;

- нескінченне завантаження;

- AI не відповідає;

- втрата історії;

- помилки оплати;

- збої voice mode;

- токсичні відповіді AI;

- втрата контексту діалогу.

Причому токсична або емоційно неправильна відповідь AI сьогодні може бути навіть небезпечнішою за звичайний технічний баг.

Чому AI QA стане окремим напрямком промисловості

Зі зростанням AI-assisted development ринок зіткнеться з величезною кількістю AI-generated додатків.

Створювати MVP стає простіше. Але якість таких продуктів тепер визначається вже не лише кодом.

Головне питання змінюється: наскільки природно, стабільно та безпечно AI взаємодіє з людиною?

Саме тому AI QA поступово перетворюється на окрему спеціалізацію, що поєднує:

- класичне тестування,

- UX,

- behavioral analysis,

- conversational design,

- AI safety,

- емоційне сприйняття інтерфейсів

І найближчі роки попит на подібне тестування лише зростатиме.

Корисні посилання та матеріали

- AI/ML QA Engineer - тестування AI та ML-систем

- Розробка AI-асистентів

- Розробка AI Telegram-ботів

- Тестування мобільних додатків: методи та особливості

- High-Load тестування після Vibe Coding

- Тестування програмного забезпечення після Vibe Coding

- Все, що потрібно знати про тестування ПЗ: рівні, типи, етапи та методи